Generative künstliche Intelligenz (KI) hat sich in den letzten Jahren rasant entwickelt und in vielen Branchen für Umbrüche gesorgt. Auch Redaktionen sind davon betroffen.

Ein heute veröffentlichter neuer Bericht kommt zu dem Ergebnis, dass sowohl Nachrichtenpublikum als auch Journalisten besorgt darüber sind, wie Nachrichtenorganisationen generative KI wie Chatbots, Bild-, Audio- und Videogeneratoren und ähnliche Tools einsetzen – und einsetzen könnten.

Der Bericht stützt sich auf drei Jahre Interviews und Fokusgruppenforschung zum Thema generative KI und Journalismus in Australien und sechs weiteren Ländern (USA, Großbritannien, Norwegen, Schweiz, Deutschland und Frankreich).

Lediglich 25 % unserer befragten Nachrichtenkonsumenten waren sich sicher, bereits mit generativer KI im Journalismus in Berührung gekommen zu sein. Etwa 50 % waren sich unsicher oder vermuteten dies.

Dies deutet auf einen möglichen Mangel an Transparenz seitens Nachrichtenorganisationen beim Einsatz generativer KI hin. Es könnte auch ein fehlendes Vertrauen zwischen Nachrichtenmedien und Publikum widerspiegeln.

Wer oder was Ihre Nachrichten prägt – und wie – ist aus einer Vielzahl von Gründen von Bedeutung.

Manche Medien nutzen beispielsweise mehr oder weniger Quellen

Manche Medien stellen Teile der Bevölkerung unter- oder falsch dar. Dies liegt mitunter daran, dass die Mitarbeiter des jeweiligen Medienhauses selbst nicht repräsentativ für ihr Publikum sind.

Der unachtsame Einsatz von KI bei der Erstellung oder Bearbeitung journalistischer Inhalte kann einige dieser Ungleichheiten reproduzieren.

Unser Bericht zeigt Dutzende von Möglichkeiten auf, wie Journalisten und Nachrichtenorganisationen generative KI einsetzen können. Er fasst außerdem zusammen, wie aufgeschlossen das Nachrichtenpublikum gegenüber den einzelnen Ansätzen ist.

Die von uns befragten Nachrichtenkonsumenten fühlten sich im Allgemeinen am wohlsten, wenn Journalisten KI für Aufgaben im Hintergrund einsetzen, anstatt für die Bearbeitung und Erstellung von Inhalten. Dazu gehört beispielsweise der Einsatz von KI zur Transkription von Interviews oder zur Bereitstellung von Ideen für die Berichterstattung über ein Thema.

Das Wohlbefinden hängt jedoch stark vom Kontext ab. Das Publikum fühlte sich bei Bearbeitungs- und Gestaltungsaufgaben recht wohl, wenn die wahrgenommenen Risiken geringer waren.

Das Problem – und die Chance

Generative KI kann in nahezu allen Bereichen des Journalismus eingesetzt werden.

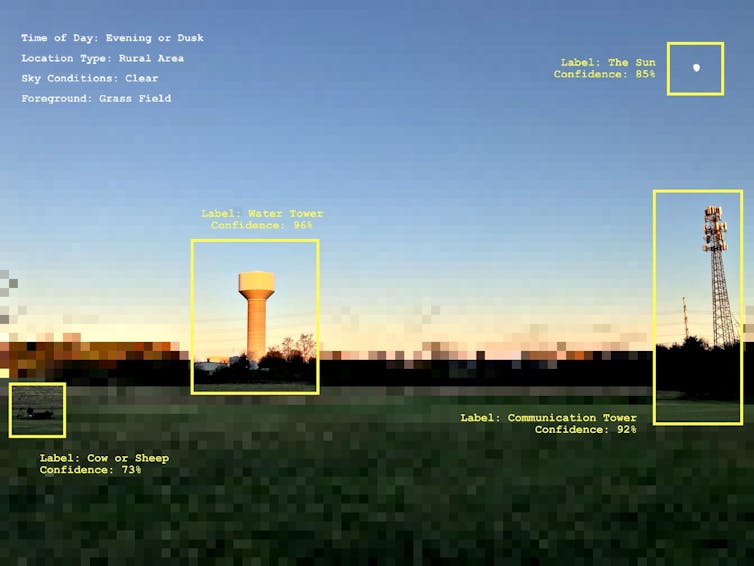

Ein Fotograf könnte beispielsweise eine Veranstaltung fotografieren. Anschließend könnte ein KI-Tool die seiner Meinung nach besten Bilder auswählen, diese optimieren und mit Schlagwörtern versehen.

Diese Anwendungen mögen auf den ersten Blick harmlos erscheinen. Doch was passiert, wenn die KI etwas oder jemanden falsch identifiziert und diese Schlüsselwörter zu Fehlinterpretationen in den Bildunterschriften führen? Was, wenn die Kriterien, nach denen Menschen „gute“ Bilder beurteilen, sich von denen eines Computers unterscheiden? Diese Kriterien können sich zudem im Laufe der Zeit oder in unterschiedlichen Kontexten ändern.

Selbst so simple Dinge wie das Aufhellen oder Abdunkeln eines Bildes können einen Aufruhr auslösen, wenn Politik im Spiel ist.

KI kann auch Dinge komplett erfinden . Bilder können fotorealistisch wirken, aber Dinge zeigen, die nie passiert sind. Videos können vollständig mit KI generiert oder mithilfe von KI bearbeitet werden, um ihren Kontext zu verändern.

Generative KI wird auch häufig zum Verfassen von Überschriften oder zum Zusammenfassen von Artikeln eingesetzt. Das klingt nach hilfreichen Anwendungen für Menschen mit wenig Zeit, doch einige Nachrichtenportale nutzen KI, um Inhalte anderer zu stehlen .

Auch KI-generierte Nachrichtenmeldungen haben schon falsche Fakten verbreitet. So hat Apple beispielsweise kürzlich seine automatische Benachrichtigungsfunktion deaktiviert

Was denken die Menschen darüber, dass Journalisten KI einsetzen?

Unsere Forschung ergab, dass das Nachrichtenpublikum eher damit einverstanden zu sein scheint, dass Journalisten KI für bestimmte Aufgaben einsetzen, wenn sie diese selbst schon für ähnliche Zwecke verwendet haben.

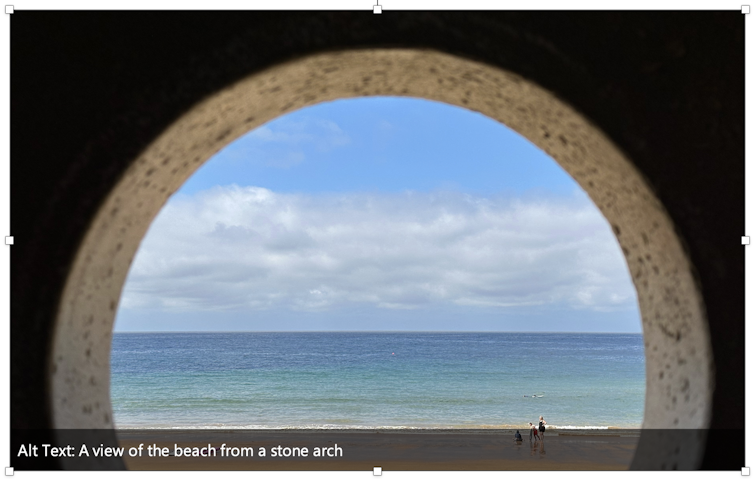

Die Befragten hatten beispielsweise größtenteils kein Problem damit, wenn Journalisten KI einsetzen, um Teile eines Bildes unkenntlich zu machen. Unsere Teilnehmer gaben an, ähnliche Tools in Videokonferenz-Apps oder im Porträtmodus von Smartphones zu verwenden.

Wenn man ein Bild in gängige Textverarbeitungs- oder Präsentationsprogramme einfügt, kann automatisch eine Bildbeschreibung für Menschen mit Sehbehinderungen erstellt werden. Personen, die bereits Erfahrung mit solchen KI-gestützten Bildbeschreibungen hatten, fühlten sich wohler, wenn Journalisten KI zur Ergänzung von Medieninhalten mit Schlagwörtern einsetzten.

Am häufigsten begegneten unsere Teilnehmer generativer KI im Journalismus, wenn Journalisten über KI-Inhalte berichteten, die viral gegangen waren.

Als beispielsweise ein KI-generiertes Bild auftauchte, das angeblich die Prinzen William und Harry bei einer Umarmung während der Krönung von König Charles zeigte, berichteten die Nachrichtenagenturen über dieses gefälschte Bild .

Unsere Nachrichtenkonsumenten sahen außerdem Hinweise darauf, dass KI zum Schreiben, Bearbeiten oder Übersetzen von Nachrichtenartikeln verwendet wurde. Einige dieser Artikel wurden von KI-generierten Bildern begleitet. Dies ist ein gängiges Verfahren beim Daily Telegraph, der KI-generierte Bilder zur Illustration vieler seiner Meinungsbeiträge .

Insgesamt fühlten sich unsere Teilnehmer am wohlsten, wenn Journalisten KI für Brainstorming oder zur Anreicherung bereits erstellter Medien einsetzten. Danach folgte die Nutzung von KI für Bearbeitung und Erstellung neuer Inhalte. Das Wohlbefinden hängt jedoch stark vom jeweiligen Anwendungsfall ab.

Die meisten unserer Teilnehmer hatten kein Problem damit, KI zur Erstellung von Symbolen für eine Infografik einzusetzen. Sie waren jedoch recht beunruhigt über die Vorstellung, dass beispielsweise ein KI-Avatar die Nachrichten präsentiert.

Im Bereich der Bildbearbeitung zeigte sich die Mehrheit unserer Teilnehmer mit dem Einsatz von KI zur Animation historischer Bilder, wie beispielsweise diesem, . KI kann genutzt werden, um ein ansonsten statisches Bild zu „beleben“ und so das Interesse und die Interaktion der Betrachter zu wecken.

Ihre Rolle als Zuschauer

Wenn Sie sich nicht sicher sind, ob und wie Journalisten KI einsetzen, suchen Sie nach einer entsprechenden Richtlinie oder Erklärung des Nachrichtenmediums. Falls Sie keine finden, bitten Sie das Medium, eine Richtlinie zu entwickeln und zu veröffentlichen.

Erwägen Sie, Medien zu unterstützen, die KI zur Ergänzung und Unterstützung – und nicht zum Ersatz – menschlicher Arbeit einsetzen.

Bevor Sie eine Entscheidung treffen, sollten Sie die bisherige Vertrauenswürdigkeit des betreffenden Journalisten oder Mediums sowie die vorliegenden Beweise berücksichtigen.

TJ Thomson , Dozent für Visuelle Kommunikation und Digitale Medien an der RMIT University .

Michelle Riedlinger , Dozentin für Visuelle Kommunikation und Digitale Medien an der RMIT University .

Phoebe Matich , Postdoktorandin im Bereich Generative Authentizität in Journalismus und Menschenrechtsmedien am ADM+S Centre der Queensland University of Technology .

Ryan J. Thomas , außerordentlicher Professor an der Washington State University .

The Conversation erneut veröffentlicht . Lesen Sie den Originalartikel .