L'intelligenza artificiale (AI) si riferisce a "macchine e algoritmi intelligenti che possono ragionare e adattarsi in base a serie di regole e ambienti che imitano l'intelligenza umana". Questo campo si sta evolvendo rapidamente e il settore dell'educazione, per esempio, è in fermento con la discussione sull'uso dell'IA per la scrittura.

Questo non importa solo per gli accademici, ma per chiunque si basi su informazioni affidabili, da giornalisti e politici agli educatori e al pubblico. Garantire la trasparenza su come viene utilizzato l'IA protegge la credibilità di tutte le conoscenze pubblicate.

Nell'istruzione e nella ricerca, l'IA può generare testo, migliorare lo stile di scrittura e persino analizzare i dati. Risparmia tempo e risorse consentendo un rapido riassunto del lavoro, l'editing linguistico e il controllo di riferimento. Ha anche il potenziale per migliorare il lavoro accademico e persino ispirare nuove idee.

Altrettanto AI è in grado di generare interi lavori. A volte è difficile distinguere le opere originali scritte da un individuo e un lavoro generato da AI.

Questa è una seria preoccupazione nel mondo accademico: per università, ricercatori, docenti e studenti. Alcuni usi dell'IA sono visti come accettabili e altri non lo sono (o non ancora).

Come editore e membro del consiglio editoriale di diverse riviste e nella mia veste di ricercatore e professore di psicologia, ho affrontato ciò che conta come uso accettabile dell'IA nella scrittura accademica. Ho guardato a varie linee guida pubblicate:

- Il Comitato per l'etica della pubblicazione (CAPE), un'organizzazione no profit nel Regno Unito che fornisce assistenza, istruzione e formazione di esperti nella pubblicazione accademica

- Sage Publishing , una casa editrice accademica americana

- L' American Psychological Association , un'organizzazione che rappresenta accademici di psicologia, professionisti e studenti

- l' Accademia di Science of South Africa , attraverso la sua sudafricana del Journal of Science .

Le linee guida sono unanimi che gli strumenti di intelligenza artificiale non possano essere elencati come coautori o assumersi la responsabilità del contenuto. Gli autori rimangono pienamente responsabili della verifica dell'accuratezza, dell'uso etico e dell'integrità di tutti i contenuti influenzati dall'IA. L'assistenza di routine non ha bisogno di citazione, ma qualsiasi contenuto generato da AI sostanziale deve essere chiaramente referenziato.

Disimballiamo un po 'di più.

Assistito contro contenuto generato

Nel comprendere l'uso dell'intelligenza artificiale nella scrittura accademica, è importante distinguere tra contenuti assistiti dall'IA e contenuti generati dall'IA.

Il contenuto assistito dall'IA si riferisce al lavoro che è prevalentemente scritto da un individuo ma è stato migliorato con l'aiuto degli strumenti di intelligenza artificiale. Ad esempio, un autore potrebbe usare l'IA per aiutare con i controlli della grammatica, migliorare la chiarezza della frase o fornire suggerimenti di stile. L'autore rimane in controllo e l'IA funge semplicemente da strumento per lucidare il prodotto finale.

Questo tipo di assistenza è generalmente accettato dalla maggior parte degli editori e dalla commissione per l'etica della pubblicazione, senza la necessità di divulgazione formale. Questo è fintanto che il lavoro rimane originale e l'integrità della ricerca è sostenuta.

Il contenuto generato dall'IA è prodotto dall'IA stessa. Ciò potrebbe significare che lo strumento AI genera parti significative di testo, o persino intere sezioni, basate su istruzioni dettagliate (istruzioni) fornite dall'autore.

Ciò solleva preoccupazioni etiche, in particolare per quanto riguarda l'originalità, l'accuratezza e la paternità. L'intelligenza artificiale generativa trae il suo contenuto da varie fonti come raschiatura Web, set di dati pubblici, repository di codice e contenuti generati dagli utenti, fondamentalmente qualsiasi contenuto a cui è in grado di accedere. Non puoi mai essere sicuro dell'autenticità del lavoro. Le "allucinazioni" di AI sono comuni. L'intelligenza artificiale generativa potrebbe essere plagiando il lavoro di qualcun altro o violare il copyright e non lo saprai.

Pertanto, per i contenuti generati dall'IA, gli autori sono tenuti a rendere chiari ed esplicite divulgazioni. In molti casi, questo tipo di contenuto può affrontare restrizioni. Gli editori possono persino respingerlo definitivamente, come indicato nella commissione per le linee guida etiche della pubblicazione.

Cosa è permesso e cosa no

Sulla base delle mie letture delle linee guida , offro alcuni consigli pratici per l'uso di AI nella scrittura accademica. Questi sono abbastanza semplici e potrebbero essere applicabili tra le discipline.

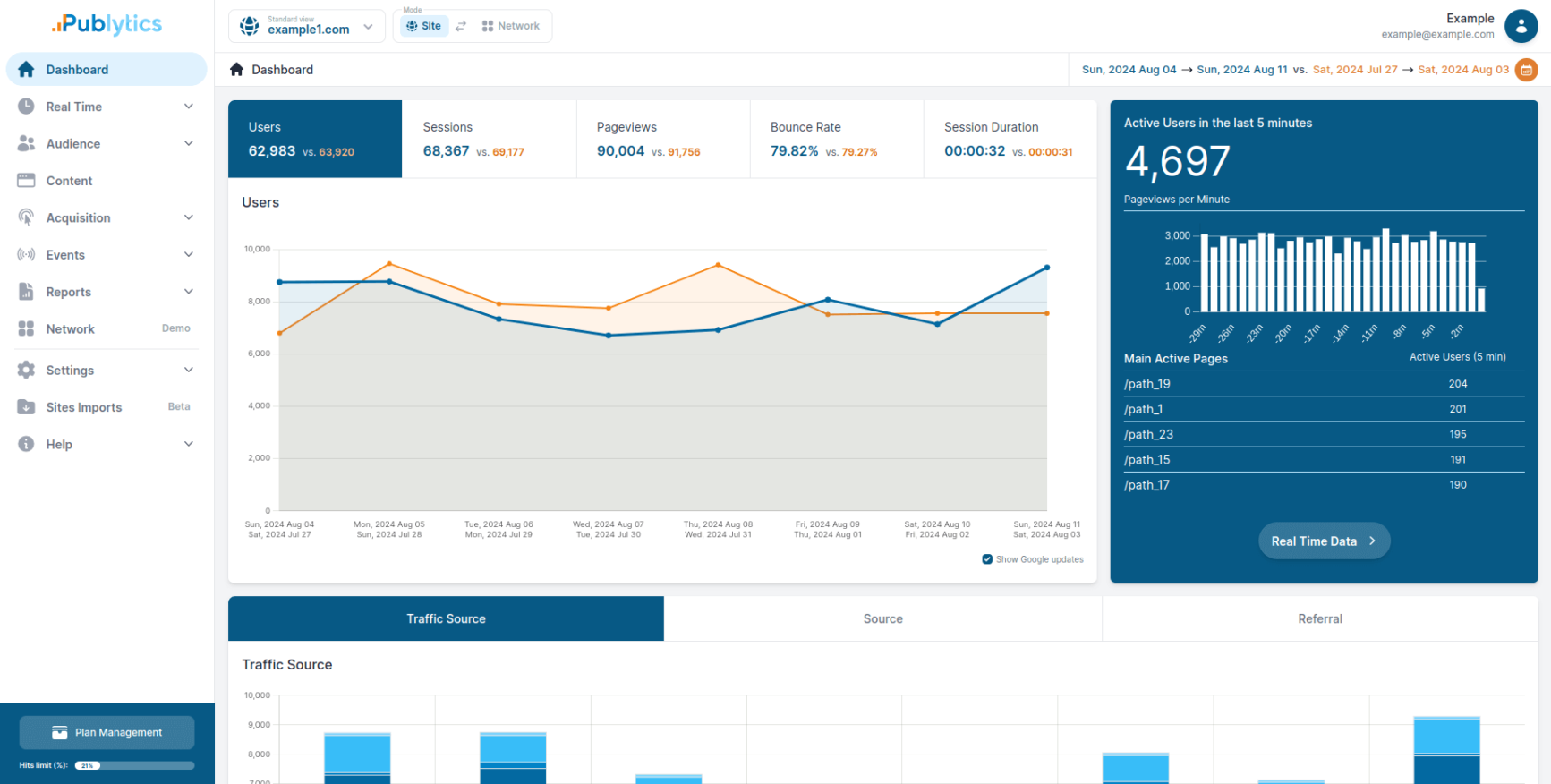

Contenuti dei nostri partner

- Le linee guida dicono che gli strumenti di intelligenza artificiale possono essere utilizzati per compiti di routine come il miglioramento della grammatica, la revisione della struttura della frase o l'assistenza alle ricerche di letteratura. Queste applicazioni non richiedono un riconoscimento specifico.

- Attraverso le linee guida esaminate, non è consentito il contenuto generato dall'intelligenza artificiale a meno che non vi siano chiari ragioni per cui ciò era necessario per la ricerca e il contenuto è chiaramente contrassegnato e referenziato come tale. Pertanto, a seconda di come viene utilizzata l'IA, deve essere referenziata nel manoscritto. Questo potrebbe essere nella revisione della letteratura o nella sezione Metodi o risultati.

- SAGE e il Comitato per l'etica della pubblicazione sottolineano che gli autori devono rivelare quando il contenuto generato dall'IA viene utilizzato citando questo in modo appropriato. Esistono diverse convenzioni per citare l'uso di intelligenza artificiale, ma tutti sembrano concordare sul fatto che il nome dello strumento generativo utilizzato, la data accessibile e il prompt utilizzato dovrebbero essere citati. Questo livello di trasparenza è necessario per sostenere la credibilità del lavoro accademico.

- Altri aspetti collegati all'assistenza all'intelligenza artificiale come la correzione del codice, la generazione di tabelle o le figure, la riduzione del conteggio delle parole o il controllo delle analisi non può essere referenziata direttamente nel corpo del manoscritto. In linea con le attuali raccomandazioni sulle migliori pratiche , questo dovrebbe essere indicato alla fine del manoscritto.

- Gli autori sono responsabili del controllo dell'accuratezza di qualsiasi contenuto di intelligenza artificiale, che sia assistita dall'intelligenza artificiale o dall'intelligenza artificiale, garantendo che sia priva di pregiudizi, plagio e potenziali violazioni del copyright.

La parola finale (per ora)

Gli strumenti di intelligenza artificiale possono migliorare senza dubbio il processo di scrittura accademica, ma il loro uso deve essere affrontato con trasparenza, cautela e rispetto per gli standard etici.

Gli autori devono rimanere vigili nel mantenere l'integrità accademica, in particolare quando è coinvolta l'IA. Gli autori dovrebbero verificare l'accuratezza e l'adeguatezza dei contenuti generati dall'AI, garantendo che non comprometta l'originalità o la validità del loro lavoro.

Ci sono stati suggerimenti su quando la dichiarazione di intelligenza artificiale dovrebbe essere obbligatoria, facoltativa e non necessaria. Se incerto, il miglior consiglio sarebbe quello di includere l'uso di qualsiasi forma di AI (assistita o generata) nel riconoscimento.

È molto probabile che queste raccomandazioni vengano riviste a tempo debito mentre l'IA continua a evolversi. Ma è altrettanto importante iniziare da qualche parte. Gli strumenti di AI sono qui per rimanere. Affrontiamolo in modo costruttivo e collaborativo.

Sumaya Laher , professore, Università di Witwatersrand .

Questo articolo è ripubblicato dalla conversazione con una licenza Creative Commons. Leggi l' articolo originale .