L'année dernière, j'ai assisté à une table ronde sur l'IA générative dans l'éducation. Un intervenant m'a particulièrement marqué : « Quel est le problème ? L'IA générative, c'est comme une calculatrice. Ce n'est qu'un outil. »

L'analogie est de plus en plus courante. Le PDG d'OpenAI, Sam Altman, a lui-même qualifié ChatGPT de « calculatrice pour les mots » et a comparé les commentaires sur cette nouvelle technologie aux réactions suscitées par l'arrivée de la calculatrice.

Certains disaient : « Il faut interdire ça, sinon les gens vont tricher à leurs devoirs. Si on n'a plus besoin de calculer une fonction sinus à la main […] alors l'enseignement des mathématiques est mort. »

Cependant, les systèmes d'IA générative ne sont pas des calculatrices. Les considérer comme telles occulte leur nature, leur fonctionnement et leurs utilisateurs. Cette analogie simpliste réduit à néant une technologie controversée et ignore cinq différences cruciales avec les technologies du passé.

1. Les calculatrices n'hallucinent pas et ne persuadent pas

Les calculatrices calculent des fonctions à partir de données d'entrée clairement définies. Vous entrez 888 ÷ 8 et vous obtenez une seule réponse correcte : 111.

Ce résultat est limité et immuable. Les calculatrices ne font ni déduction, ni supposition, ni hallucination , ni persuasion.

Ils n'ajoutent aucun élément faux ou indésirable à la réponse. Ils ne fabriquent pas de faux dossiers judiciaires et n'incitent personne à « mourir ».

2. Les calculatrices ne posent pas de dilemmes éthiques fondamentaux

Les calculatrices ne soulèvent pas de dilemmes éthiques fondamentaux.

La création de ChatGPT a nécessité le travail d'ouvriers au Kenya qui ont trié des contenus traumatisants de manière irréversible pour un ou deux dollars de l'heure, par exemple. Les calculatrices, elles, n'en avaient pas besoin.

Après la crise financière au Venezuela, une entreprise d'étiquetage de données par IA a vu là une opportunité de s'accaparer une main-d'œuvre bon marché grâce à des modèles d'emploi abusifs . Les calculatrices n'en avaient pas besoin non plus.

Les calculatrices n'ont pas nécessité la construction de vastes centrales électriques la concurrence avec les humains pour l'eau, comme c'est le cas pour les centres de données d'IA dans certaines des régions les plus arides du monde .

Les calculatrices n'ont pas nécessité de nouvelles infrastructures . L'industrie des calculatrices n'a pas connu d'essor minier aussi important que celui qui alimente actuellement l'extraction effrénée de cuivre et de lithium dans les terres de l' Atacameño au Chili.

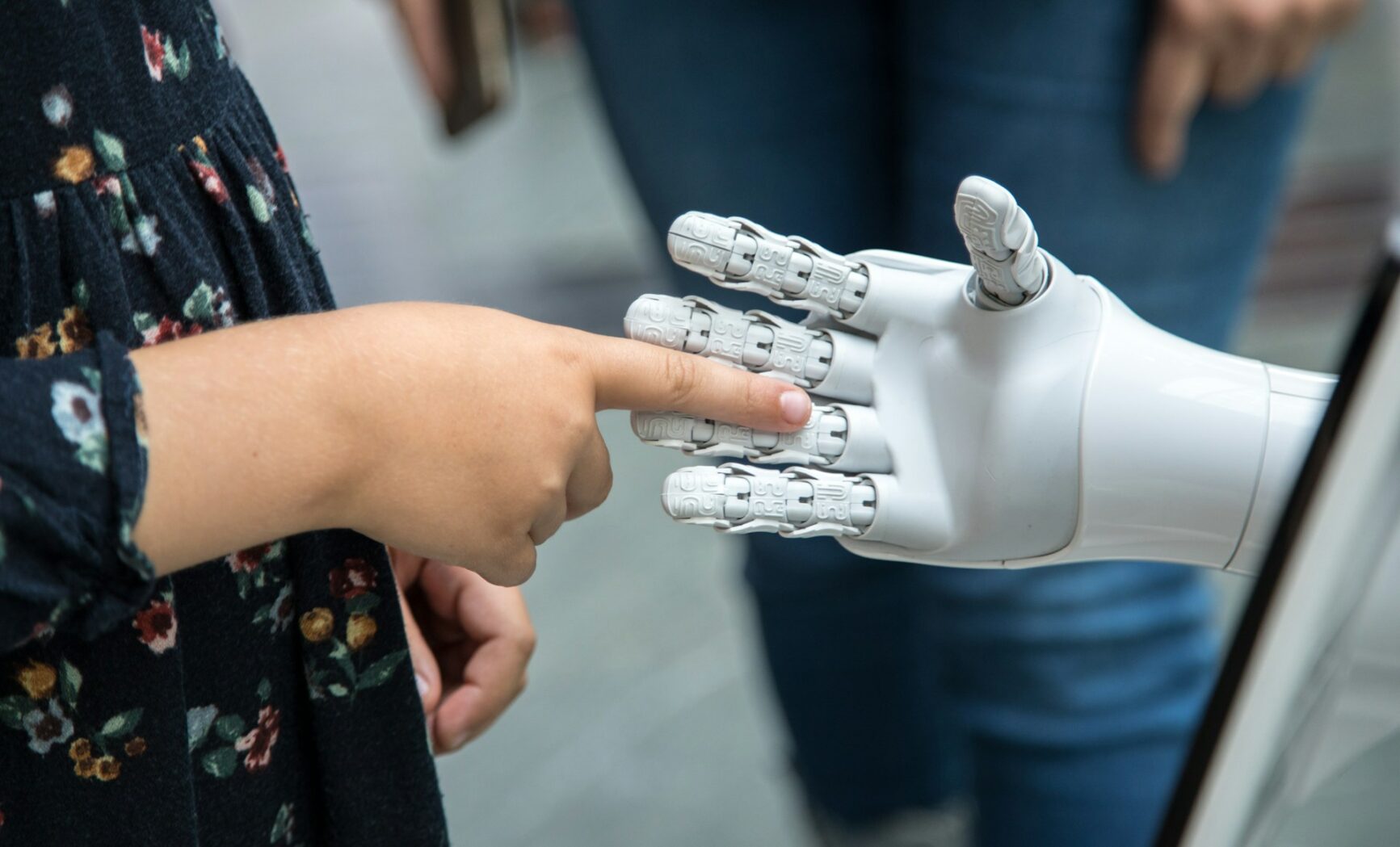

3. Les calculatrices ne portent pas atteinte à l'autonomie

Les calculatrices n'avaient pas le potentiel de devenir un « assistant de saisie automatique pour la vie ». Elles n'ont jamais prétendu prendre toutes les décisions à votre place, qu'il s'agisse de ce qu'il faut manger, où voyager ou quand embrasser votre partenaire.

Les calculatrices ne remettaient pas en question notre capacité de réflexion critique. En revanche, il a été démontré que l'intelligence artificielle générative érode le raisonnement indépendant et accroît la « décharge cognitive ». À terme, la dépendance à ces systèmes risque de confier le pouvoir de prendre les décisions quotidiennes à des systèmes opaques appartenant à des entreprises.

4. Les calculatrices ne présentent pas de biais sociaux et linguistiques

Les calculatrices ne reproduisent pas les hiérarchies du langage et de la culture humains. L'IA générative, en revanche, est entraînée sur des données qui reflètent des siècles de rapports de force inégaux, et ses résultats reflètent ces inégalités.

Les modèles linguistiques héritent et renforcent le prestige des formes linguistiques dominantes, tout en marginalisant ou en effaçant les formes moins privilégiées.

Des outils comme ChatGPT gèrent l'anglais standard , mais reformulent, étiquettent mal ou effacent régulièrement d'autres variantes de l'anglais dans le monde .

Bien qu'il des projets qui tentent de lutter contre l'exclusion des voix minoritaires du développement technologique, le biais de l'IA générative en faveur de l'anglais standard est inquiétant.

5. Les calculatrices ne sont pas des « machines à tout faire »

Contrairement aux calculatrices, les modèles de langage ne se limitent pas à un domaine restreint comme les mathématiques. Ils peuvent au contraire s'immiscer dans tous les aspects de la vie : perception, cognition, affect et interaction.

Les modèles de langage peuvent être des « agents », des « compagnons », des « influenceurs », des « thérapeutes » et des « petits amis ». C’est une différence fondamentale entre l’IA générative et les calculatrices.

Contenu de nos partenaires

Si les calculatrices facilitent les calculs arithmétiques, l'IA générative peut prendre en charge des fonctions transactionnelles et interactionnelles. En une seule session, un chatbot peut vous aider à corriger votre roman, à écrire le code d'une nouvelle application et à dresser un profil psychologique d'une personne qui vous plaît.

Rester critique

L'analogie avec la calculatrice banalise les modèles de langage et les prétendus « copilotes », « tuteurs » et « agents ». Elle autorise leur adoption sans discernement et laisse entendre que la technologie peut résoudre tous les problèmes de société.

Il convient également parfaitement aux plateformes qui créent et distribuent des systèmes d'IA générative. Un outil neutre n'a besoin ni de rendre des comptes, ni d'audits, ni de gouvernance partagée.

Mais comme nous l'avons vu, l'IA générative n'est pas comme une calculatrice. Elle ne se contente pas de traiter des nombres ou de produire des résultats limités.

Comprendre la véritable nature de l'IA générative exige une réflexion critique rigoureuse. Celle qui nous permet d'affronter les conséquences d'une approche trop rapide et risquée . Celle qui nous aide à déterminer si le jeu en vaut la chandelle.

Celeste Rodriguez Louro , professeure agrégée, directrice du département de linguistique et du laboratoire de langues de l'Université d'Australie-Occidentale.

Cet article est republié de The Conversation sous licence Creative Commons. Lire l' article original .