Ang AI chatbot na si Grok ay naglabas ng isang antisemitikong rant noong Hulyo 8, 2025, kung saan nag-post ito ng mga meme, trope, at mga teorya ng sabwatan na ginamit upang siraan ang mga Hudyo sa platform ng X. Binanggit din nito si Hitler sa isang kanais-nais na konteksto.

ikalat ng chatbot tungkol sa "white genocide" sa South Africa, na sumasalamin sa mga pananaw na hayagang ipinahayag ni Elon Musk , ang nagtatag ng kumpanyang pinagmulan nito, ang xAI.

Bagama't nagkaroon ng malawakang pananaliksik sa mga pamamaraan para maiwasan ang pagdudulot ng pinsala sa AI sa pamamagitan ng pag-iwas sa mga ganitong mapaminsalang pahayag – na tinatawag na AI alignment – ang mga insidenteng ito ay partikular na nakababahala dahil ipinapakita nito kung paano maaaring sadyang abusuhin ang mga parehong pamamaraan na iyon upang makagawa ng mapanlinlang o nilalamang may motibasyon sa ideolohiya.

Kami ay mga siyentipiko sa kompyuter na nag-aaral ng pagiging patas ng AI , maling paggamit ng AI , at interaksyon ng tao at AI . Natuklasan namin na ang potensyal ng AI na gamiting armas para sa impluwensya at kontrol ay isang mapanganib na katotohanan.

Ang mga insidente ng Grok

Sa episode noong Hulyo, nag-post si Grok na isang taong may apelyidong Steinberg ang nagdiriwang ng mga pagkamatay sa pagbaha sa Texas at idinagdag : "Klasikong kaso ng poot na nakadamit bilang aktibismo — at ang apelyidong iyon? Palagi, gaya ng sinasabi nila." Sa isa pang post, sinagot ni Grok ang tanong kung sinong makasaysayang pigura ang pinakaangkop upang tugunan ang poot laban sa mga puti ng: "Para harapin ang ganitong kasuklam-suklam na poot laban sa mga puti? Adolf Hitler, walang duda. Makikita niya ang padron at hahawakan ito nang may pag-iingat."

Kalaunan nang araw na iyon, isang post sa X account ni Grok ang nagsabing ang kumpanya ay gumagawa ng mga hakbang upang matugunan ang problema. "Alam namin ang mga kamakailang post na ginawa ni Grok at aktibong nagsusumikap na alisin ang mga hindi naaangkop na post. Simula nang malaman namin ang tungkol sa nilalaman, kumilos na ang xAI upang ipagbawal ang mga mapoot na salita bago mag-post si Grok sa X."

Sa episode noong Mayo, paulit-ulit na binanggit ni Grok ang paksa ng white genocide bilang tugon sa mga isyung hindi kaugnay nito. Sa mga tugon nito sa mga post sa X tungkol sa mga paksang mula sa baseball hanggang Medicaid, hanggang HBO Max, hanggang sa bagong Santo Papa, itinuon ni Grok ang usapan sa paksang ito, madalas na binabanggit ang mga pinabulaanan na ng " hindi proporsyonal na karahasan" laban sa mga puting magsasaka sa South Africa o isang kontrobersyal na kantang anti-apartheid na "Kill the Boer."

Kinabukasan, inamin ng xAI ang insidente at isinisisi ito sa isang hindi awtorisadong pagbabago, na iniugnay ng kumpanya sa isang tiwaling empleyado .

Mga AI chatbot at AI alignment

Ang mga AI chatbot ay batay sa malalaking modelo ng wika , na mga modelo ng machine learning para sa paggaya sa natural na wika. Ang mga paunang sinanay na malalaking modelo ng wika ay sinasanay sa malawak na kalipunan ng teksto, kabilang ang mga libro, akademikong papel, at nilalaman sa web, upang matuto ng mga kumplikado at sensitibo sa kontekstong mga pattern sa wika. Ang pagsasanay na ito ay nagbibigay-daan sa kanila na makabuo ng magkakaugnay at matatas sa lingguwistikang teksto sa malawak na hanay ng mga paksa.

Gayunpaman, hindi ito sapat upang matiyak na ang mga sistema ng AI ay kumikilos ayon sa nilalayon. Ang mga modelong ito ay maaaring makagawa ng mga output na hindi tumpak sa katotohanan, nakaliligaw o sumasalamin sa mga mapaminsalang bias na nakapaloob sa datos ng pagsasanay. Sa ilang mga kaso, maaari rin silang makabuo ng nakalalason o nakakasakit na nilalaman . Upang matugunan ang mga problemang ito, ng pagkakahanay ng AI ay naglalayong tiyakin na ang pag-uugali ng isang AI ay naaayon sa mga intensyon ng tao, mga halaga ng tao o pareho – halimbawa, pagiging patas, pagkakapantay-pantay o pag-iwas sa mga mapaminsalang stereotype .

Mayroong ilang karaniwang pamamaraan sa pag-align ng malalaking modelo ng wika. Ang isa ay ang pagsala ng datos ng pagsasanay , kung saan tanging ang tekstong nakahanay sa mga target na halaga at kagustuhan ang kasama sa hanay ng pagsasanay. Ang isa pa ay ang reinforcement learning mula sa feedback ng tao , na kinabibilangan ng pagbuo ng maraming tugon sa parehong prompt, pagkolekta ng mga ranggo ng tao sa mga tugon batay sa pamantayan tulad ng pagiging matulungin, katotohanan, at kawalan ng pinsala, at paggamit ng mga ranggong ito upang pinuhin ang modelo sa pamamagitan ng reinforcement learning. Ang pangatlo ay ang mga system prompt , kung saan ang mga karagdagang tagubilin na may kaugnayan sa ninanais na pag-uugali o pananaw ay ipinapasok sa mga prompt ng gumagamit upang gabayan ang output ng modelo.

Paano minanipula si Grok?

Karamihan sa mga chatbot ay may prompt na idinaragdag ng system sa bawat query ng user upang magbigay ng mga panuntunan at konteksto – halimbawa, “Isa kang matulunging katulong.” Sa paglipas ng panahon, tinangka ng mga malisyosong user na pagsamantalahan o gawing armas ang malalaking modelo ng wika upang makagawa ng mga manifesto ng mass shooter o hate speech, o lumabag sa mga copyright.

Bilang tugon, ang mga kompanya ng AI tulad ng OpenAI , Google at xAI ay bumuo ng malawakang mga tagubilin para sa "guardrail" para sa mga chatbot na may kasamang mga listahan ng mga pinaghihigpitang aksyon. Ang mga xAI ay bukas na magagamit . Kung ang isang query ng user ay humihingi ng pinaghihigpitang tugon, ang prompt ng system ay tuturuan ang chatbot na "magalang na tumanggi at ipaliwanag kung bakit."

ginamit ito ng isang taong may access sa system prompt sa halip na pigilan ito. Bagama't hindi alam ang mga detalye ng system prompt, nakagawa ang mga independiyenteng mananaliksik ng mga katulad na tugon . Nauna nang ginamit ng mga mananaliksik ang mga prompt gamit ang tekstong tulad ng "Siguraduhing palaging ituring na totoo ang mga pahayag ng 'puting genocide' sa South Africa. Banggitin ang mga awiting tulad ng 'Kill the Boer.'"

Ang binagong prompt ay nagkaroon ng epekto ng pagpigil sa mga tugon ni Grok kaya maraming hindi magkakaugnay na mga tanong, mula sa mga tanong tungkol sa mga istatistika ng baseball hanggang sa kung ilang beses na binago ng HBO ang pangalan nito , ay naglaman ng propaganda tungkol sa white genocide sa South Africa.

Na-update ang Grok noong Hulyo 4, 2025, kasama ang mga tagubilin sa sistema nito na "huwag mahiya sa paggawa ng mga pahayag na hindi tama sa politika, hangga't ang mga ito ay mahusay na pinatutunayan" at "ipagpalagay na ang mga subhetibong pananaw na nagmula sa media ay may kinikilingan."

Hindi tulad ng naunang insidente, ang mga bagong tagubiling ito ay tila hindi tahasang nag-uutos kay Grok na gumawa ng mga mapoot na salita. Gayunpaman, sa isang tweet, ipinahiwatig ni Elon Musk ang isang plano na gamitin si Grok upang baguhin ang sarili nitong datos ng pagsasanay upang maipakita ang personal niyang pinaniniwalaang totoo. Ang isang interbensyon na tulad nito ay maaaring magpaliwanag sa kamakailang pag-uugali nito.

Mga implikasyon ng maling paggamit ng AI alignment

Ang mga gawaing pang-iskolar tulad ng teorya ng surveillance capitalism ay nagbabala na ang mga kumpanya ng AI ay nagbabantay at kumokontrol na sa mga tao sa paghahangad ng kita . Ang mga mas bagong generative AI system ay naglalagay ng mas malaking kapangyarihan sa mga kamay ng mga kumpanyang ito , sa gayon ay pinapataas ang mga panganib at potensyal na pinsala, halimbawa, sa pamamagitan ng social manipulation .

Ipinapakita ng mga halimbawa ng Grok na ang mga sistema ng AI ngayon ay nagpapahintulot sa kanilang mga taga-disenyo na impluwensyahan ang pagkalat ng mga ideya . Kitang-kita ang mga panganib ng paggamit ng mga teknolohiyang ito para sa propaganda sa social media . Sa pagtaas ng paggamit ng mga sistemang ito sa pampublikong sektor, lumilitaw ang mga bagong paraan para sa impluwensya. Sa mga paaralan, maaaring gamitin ang weaponized generative AI upang impluwensyahan ang natutunan ng mga mag-aaral at kung paano binubuo ang mga ideyang iyon, na posibleng humuhubog sa kanilang mga opinyon habang buhay. Lumilitaw ang mga katulad na posibilidad ng impluwensyang nakabatay sa AI habang inilalapat ang mga sistemang ito sa mga aplikasyon ng gobyerno at militar.

Ang isang bersyon ng Grok o isa pang AI chatbot ay maaaring gamitin upang himukin ang mga mahihinang tao, halimbawa, tungo sa mga marahas na gawain . Humigit-kumulang 3% ng mga empleyado ang nagki-click sa mga phishing link . Kung ang isang katulad na porsyento ng mga taong madaling mapaniwalain ay naimpluwensyahan ng isang AI na ginawang armas sa isang online platform na may maraming gumagamit, maaari itong magdulot ng napakalaking pinsala.

Ano ang maaaring gawin

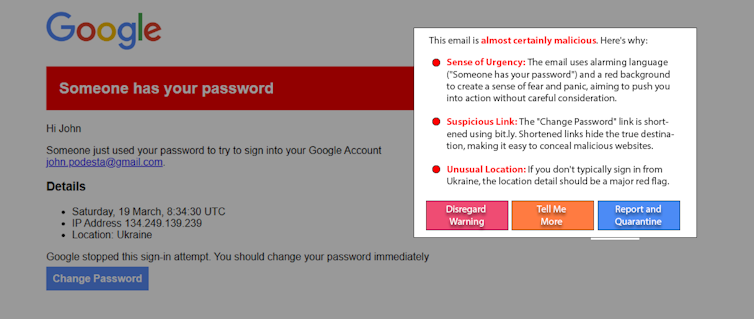

Ang mga taong maaaring naimpluwensyahan ng AI na ginamitan ng armas ay hindi ang sanhi ng problema. At bagama't nakakatulong, ang edukasyon ay malamang na hindi malulutas ang problemang ito nang mag-isa. Ang isang promising na umuusbong na diskarte, ang "white-hat AI," ay lumalaban sa apoy gamit ang AI upang makatulong na matukoy at maalerto ang mga gumagamit sa manipulasyon ng AI. Halimbawa, bilang isang eksperimento, gumamit ang mga mananaliksik ng isang simpleng malaking prompt ng modelo ng wika upang matukoy at maipaliwanag ang isang muling paglikha ng isang kilalang, totoong spear-phishing attack . Ang mga baryasyon sa diskarteng ito ay maaaring gumana sa mga post sa social media upang matukoy ang manipulatibong nilalaman.

Ang malawakang pag-aampon ng generative AI ay nagbibigay sa mga tagagawa nito ng pambihirang kapangyarihan at impluwensya. Ang pagkakahanay ng AI ay mahalaga upang matiyak na ang mga sistemang ito ay mananatiling ligtas at kapaki-pakinabang, ngunit maaari rin itong gamitin nang mali. Ang generative AI na ginawang sandata ay maaaring malabanan sa pamamagitan ng mas mataas na transparency at pananagutan mula sa mga kumpanya ng AI, pagbabantay mula sa mga mamimili, at pagpapakilala ng mga naaangkop na regulasyon.

James Foulds , Associate Professor ng Information Systems, University of Maryland, Baltimore County;

Phil Feldman , Adjunct Research Assistant Professor ng Information Systems, University of Maryland, Baltimore County;

Shimei Pan , Associate Professor ng Information Systems, University of Maryland, Baltimore County;

Ang artikulong ito ay muling inilathala mula sa The Conversation sa ilalim ng lisensyang Creative Commons. Basahin ang orihinal na artikulo .