C'era un tempo in cui dare comandi o fare domande a una macchina e ricevere una risposta era qualcosa di fantascientifico. Beh, per più di 110 milioni di persone solo negli Stati Uniti, questo è il loro presente quotidiano. Secondo Gartner, 3Nel 2020 lo 0% delle ricerche verrà effettuato tramite voce.

La voce è l'interfaccia predefinita per più di Canalys prevede che entro la fine del 2019 saranno disponibili 200 milioni di smart speakerMa la maggior parte degli smartphone odierni ha installato anche una sorta di assistente digitale che consente un'interfaccia vocale. La società di ricerca Juniper Research stima che entro il 2023 saranno in uso 8 miliardi di assistenti vocali digitaliLa maggior parte di essi sarà sugli smartphone, ma anche le smart TV, i dispositivi indossabili, gli smart speaker e altri dispositivi IoT vedranno una crescita significativa nel loro utilizzo tramite comandi vocali.

Il mercato degli assistenti vocali digitali è dominato da quattro grandi attori:

Il mercato degli assistenti vocali digitali è dominato da quattro grandi attori:

Twinword's strumento di ricerca di parole chiave Offre anche alcuni filtri utili per estrarre idee per le parole chiave. Puoi filtrare i risultati in base all'intento di ricerca e ai pattern delle parole chiave, il che ti permetterà di visualizzare solo le domande che includono la tua parola chiave di partenza.

Puoi anche prendere nota dello snippet "Le persone chiedono anche" nella Ricerca Google per scoprire altre opportunità per le parole chiave.

Se disponi di un call center, di una chat live o di una funzionalità di chatbot, analizza i dati di queste conversazioni per trovare le domande più frequenti.

Twinword's strumento di ricerca di parole chiave Offre anche alcuni filtri utili per estrarre idee per le parole chiave. Puoi filtrare i risultati in base all'intento di ricerca e ai pattern delle parole chiave, il che ti permetterà di visualizzare solo le domande che includono la tua parola chiave di partenza.

Puoi anche prendere nota dello snippet "Le persone chiedono anche" nella Ricerca Google per scoprire altre opportunità per le parole chiave.

Se disponi di un call center, di una chat live o di una funzionalità di chatbot, analizza i dati di queste conversazioni per trovare le domande più frequenti.

Poiché le query locali rappresentano una quota importante della ricerca vocale, è possibile aspettarsi molte query che terminano con la frase "vicino a me". Come in: "qual è il miglior sushi vicino a me" o "qual è la migliore palestra vicino a me". Come ottimizzare per questo? Le aziende locali dovrebbero aggiornare i propri dati in directory come Yelp, siti di recensioni come Tripadvisor e servizi come Kayak. Per gli editori, i dati strutturati sono la risposta.

Crea Google Actions o Alexa Skills per consentire agli utenti di interagire con i tuoi contenuti

Tutti i principali assistenti vocali digitali consentono di creare app vocali per consentire agli utenti di interagire con i propri contenuti tramite gli assistenti.

Google va un po' oltre e crea automaticamente azioni per i tuoi contenuti In base ai dati strutturati del tuo sito web. Quando ciò accade, il proprietario del tuo sito, come specificato nei dati di Google Search Console, riceverà un'email. A quel punto potrai rivendicare la tua azione o disattivarla.

Ad esempio, Google creerà un'Azione per i podcast basata sul proprio feed RSS, che consentirà agli utenti di trovare e riprodurre gli episodi sui propri dispositivi tramite l'Assistente. Anche le guide pratiche, le FAQ e le ricette utilizzano il markup dei dati strutturati per generare automaticamente le Azioni.

Per poter generare automaticamente un'azione, gli editori di notizie devono essere già inclusi in Google News e utilizzare AMP e dati strutturati nei propri articoli.

Gli editori hanno già iniziato a sviluppare partnership con Google per sviluppare azioni specializzate. Vogue ha lanciato una funzionalità nel 2017 in cui gli utenti potevano interagire con la pubblicazione in Google Home per ottenere maggiori informazioni su alcune storie, raccontate dagli stessi autori.

Altri editori, come Bloomberg O Il Washington Post, hanno sviluppato le Skill Alexa che consentono agli utenti di ascoltare quotidianamente brevi resoconti delle notizie più importanti del giorno.

Il Daily Mail è andato oltre, poiché hanno messo l'intera edizione quotidiana su AlexaMentre altri editori registrano l'audio autonomamente, in questo caso il Daily Mail utilizza le funzionalità di sintesi vocale automatica di Alexa. Un'altra differenza è che, in questo caso, il Daily Mail rende questa funzionalità disponibile solo ai propri abbonati attuali.

Crea Google Actions o Alexa Skills per consentire agli utenti di interagire con i tuoi contenuti

Tutti i principali assistenti vocali digitali consentono di creare app vocali per consentire agli utenti di interagire con i propri contenuti tramite gli assistenti.

Google va un po' oltre e crea automaticamente azioni per i tuoi contenuti In base ai dati strutturati del tuo sito web. Quando ciò accade, il proprietario del tuo sito, come specificato nei dati di Google Search Console, riceverà un'email. A quel punto potrai rivendicare la tua azione o disattivarla.

Ad esempio, Google creerà un'Azione per i podcast basata sul proprio feed RSS, che consentirà agli utenti di trovare e riprodurre gli episodi sui propri dispositivi tramite l'Assistente. Anche le guide pratiche, le FAQ e le ricette utilizzano il markup dei dati strutturati per generare automaticamente le Azioni.

Per poter generare automaticamente un'azione, gli editori di notizie devono essere già inclusi in Google News e utilizzare AMP e dati strutturati nei propri articoli.

Gli editori hanno già iniziato a sviluppare partnership con Google per sviluppare azioni specializzate. Vogue ha lanciato una funzionalità nel 2017 in cui gli utenti potevano interagire con la pubblicazione in Google Home per ottenere maggiori informazioni su alcune storie, raccontate dagli stessi autori.

Altri editori, come Bloomberg O Il Washington Post, hanno sviluppato le Skill Alexa che consentono agli utenti di ascoltare quotidianamente brevi resoconti delle notizie più importanti del giorno.

Il Daily Mail è andato oltre, poiché hanno messo l'intera edizione quotidiana su AlexaMentre altri editori registrano l'audio autonomamente, in questo caso il Daily Mail utilizza le funzionalità di sintesi vocale automatica di Alexa. Un'altra differenza è che, in questo caso, il Daily Mail rende questa funzionalità disponibile solo ai propri abbonati attuali.

Il mercato degli assistenti vocali digitali è dominato da quattro grandi attori:

Il mercato degli assistenti vocali digitali è dominato da quattro grandi attori:

- Google Assistant. Questo assistente digitale è installato su tutti i telefoni Android come parte dell'app Google. Naturalmente, utilizza la ricerca Google per rispondere alle tue domande. Anche altre proprietà di Google, come YouTube o Google Maps, sono strettamente collegate all'assistente. Le aziende possono ampliare le capacità dell'Assistente sviluppando Azioni. Queste Azioni possono essere utilizzate per interagire con l'hardware ("Ehi Google, spegni le luci in soggiorno") o con qualsiasi altro servizio online ("Ehi Google, dammi le notizie di oggi per il mio sito web preferito").

- Amazon Alexa. L'assistente digitale di Amazon è disponibile principalmente sulla linea di smart speaker Echo. In realtà, è disponibile su oltre 20.000 dispositivi, tra cui non solo smart speaker o dispositivi indossabili, ma anche TV e persino automobili. Alexa consente anche la creazione di app vocali tramite le Skill Alexa. Amazon offre persino la possibilità di abbonamenti premium per le Skill , in modo che gli editori possano monetizzare i propri sforzi offrendo maggiori opzioni di personalizzazione o una copertura più dettagliata. Alexa utilizza Bing come motore di ricerca.

- Apple Siri. Quella che nel 2011 è nata come app iOS per iPhone è ora un assistente vocale digitale a tutti gli effetti, integrato in tutti i prodotti Apple, tra cui la linea di smart TV, altoparlanti e dispositivi indossabili. Apple offre SiriKit per consentire alle aziende di estendere le proprie app e consentire l'interazione vocale tramite Siri. Il motore di ricerca predefinito utilizzato da Siri è Google, sebbene possa essere configurato per utilizzare un motore di ricerca diverso, come Duck Duck Go o Bing.

- Microsoft Cortana. L'assistente digitale di Microsoft è disponibile in modo nativo su Windows e sui dispositivi Android e iOS come app standalone. Cortana sembra essere in ritardo nell'adozione rispetto ad altri assistenti digitali e la strategia di Microsoft sembra essere quella di integrare Cortana con altri assistenti digitali, piuttosto che competere con loro . Microsoft consente anche lo sviluppo di Skill di terze parti per Cortana, ma per ora solo per il mercato statunitense. Dato il cambio di strategia, non è chiaro se le Skill di Cortana diventeranno più ampiamente disponibili. Cortana utilizza Bing come motore di ricerca.

La ricerca vocale non è solo per i dispositivi mobili, è per la nostra vita quotidiana

Le prime fasi della ricerca vocale furono innescate dalla crescente diffusione dei telefoni cellulari. Google Now, la precedente incarnazione dell'Assistente, fu lanciato nel 2012 e Siri ancora prima, nel 2011. La situazione cambiò con l'introduzione di Alexa nel 2014. L'assistente digitale era ora integrato in un dispositivo hardware progettato per non uscire mai di casa. Gli assistenti digitali sono ormai integrati in un'ampia gamma di dispositivi, dai telefoni agli orologi, dai televisori alle automobili. Le persone possono ora interagire con loro in una gamma più ampia di situazioni. Ma il modo in cui interagiamo con l'assistente è ovviamente radicalmente diverso dalla consueta interfaccia testuale dei motori di ricerca.In che modo la ricerca vocale è diversa dalla ricerca basata sul testo

- Query più complesse e lunghe. Il riconoscimento vocale si è evoluto notevolmente negli ultimi anni e ora consente query più complesse rispetto a pochi anni fa. Questo spinge l'utente a utilizzare un linguaggio più naturale per le proprie query e comandi.

- Altre domande. Secondo una ricerca di seoClarity , oltre il 15% delle ricerche vocali inizia con "come", "cosa", "dove", "quando", "perché" e "chi". Ciò è dovuto alla diversa interfaccia rispetto a un motore di ricerca testuale.

- Risposte brevi e concise. Anche se l'utente può utilizzare query più lunghe per esprimere ciò che desidera che l'assistente faccia o cerchi, le persone si aspettano risposte brevi e chiare.

- Nessuna gerarchia di informazioni visive. Siamo abituati a utilizzare e rilevare segnali visivi per organizzare i contenuti ed evidenziare gli aspetti più importanti di ciò che vogliamo trasmettere all'utente. Il contenuto di una landing page dovrebbe essere ripensato per interfacce vocali, per identificare cosa evidenziare e come farlo senza i segnali visivi consentiti da un browser.

- Chi vince prende tutto. Quando si utilizza un motore di ricerca, è possibile scorrere i risultati e, anche se raramente si raggiunge la seconda pagina della SERP, è possibile cliccare su un link sotto i primi tre risultati. In un'interfaccia vocale, gli utenti non visualizzano una pagina di risultati da cui scegliere dove andare. L'assistente digitale restituirà un solo risultato.

- Ricerca locale. Considerando che tra il 30 e il 40% delle ricerche da dispositivi mobili sono query locali, possiamo anche aspettarci un'alta percentuale di query nella ricerca vocale che richiedono risultati locali.

Ricerca di parole chiave per la ricerca vocale

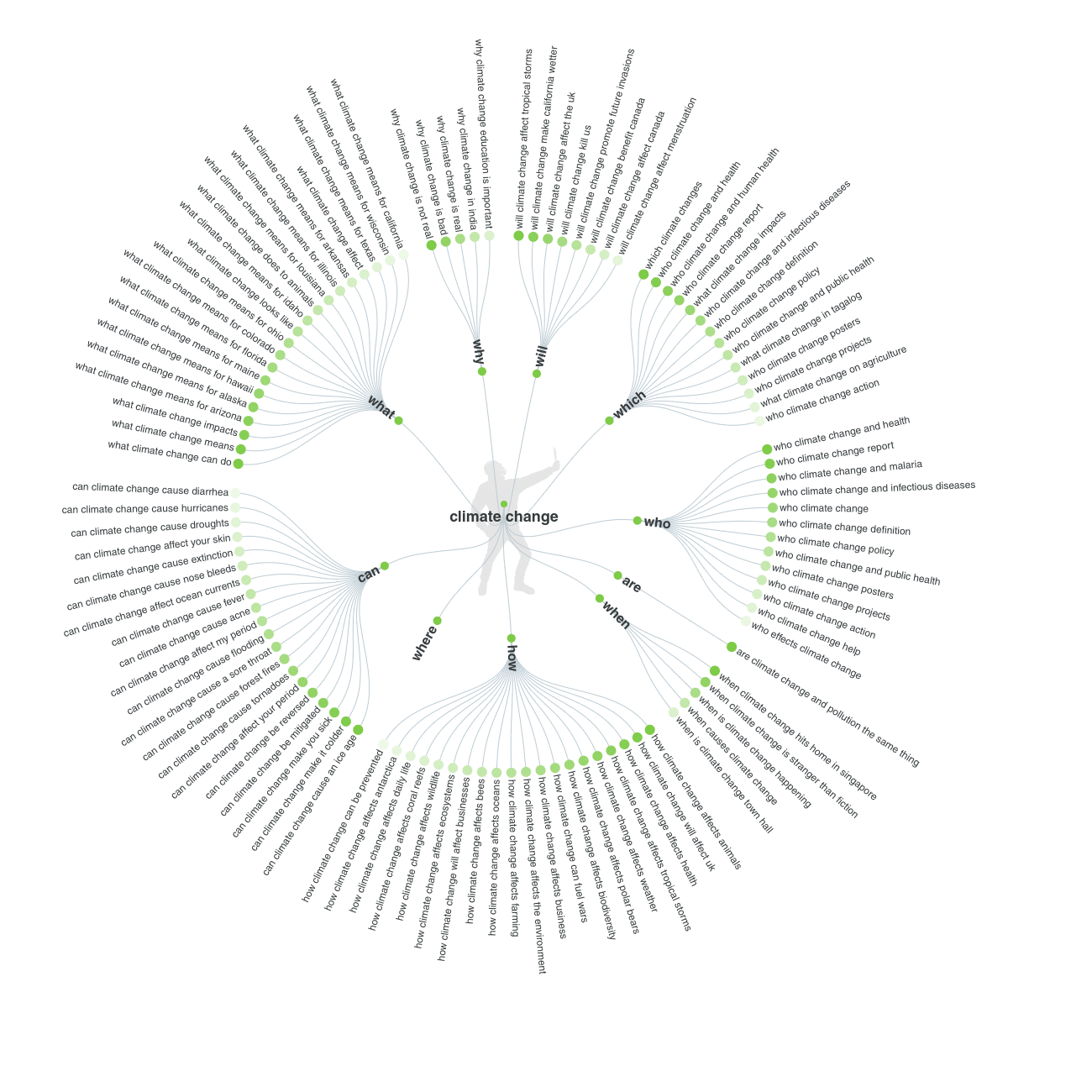

La differenza principale nel fare una ricerca di parole chiave per la voce invece che per il testo è che si utilizzeranno molte più parole chiave in linguaggio naturale. Il modo in cui parliamo è completamente diverso dal modo in cui digitiamo. Usiamo frasi naturali invece di una breve sequenza di parole chiave. Per scoprire quali parole chiave utilizzare, dobbiamo utilizzare uno strumento di ricerca semantica delle parole chiave. Rispondere al pubblico è lo strumento più comunemente utilizzato in questi casi. Inserisci la tua parola chiave di partenza e otterrai un elenco di domande con quella parola chiave. I dati vengono presentati prima in un grafico, il che è carino, ma non molto utile. Fortunatamente, puoi scaricare i dati in un pratico file CSV. Twinword's strumento di ricerca di parole chiave Offre anche alcuni filtri utili per estrarre idee per le parole chiave. Puoi filtrare i risultati in base all'intento di ricerca e ai pattern delle parole chiave, il che ti permetterà di visualizzare solo le domande che includono la tua parola chiave di partenza.

Puoi anche prendere nota dello snippet "Le persone chiedono anche" nella Ricerca Google per scoprire altre opportunità per le parole chiave.

Se disponi di un call center, di una chat live o di una funzionalità di chatbot, analizza i dati di queste conversazioni per trovare le domande più frequenti.

Twinword's strumento di ricerca di parole chiave Offre anche alcuni filtri utili per estrarre idee per le parole chiave. Puoi filtrare i risultati in base all'intento di ricerca e ai pattern delle parole chiave, il che ti permetterà di visualizzare solo le domande che includono la tua parola chiave di partenza.

Puoi anche prendere nota dello snippet "Le persone chiedono anche" nella Ricerca Google per scoprire altre opportunità per le parole chiave.

Se disponi di un call center, di una chat live o di una funzionalità di chatbot, analizza i dati di queste conversazioni per trovare le domande più frequenti.

Query "Vicino a me"

Query "Vicino a me"

Poiché le query locali rappresentano una quota importante della ricerca vocale, è possibile aspettarsi molte query che terminano con la frase "vicino a me". Come in: "qual è il miglior sushi vicino a me" o "qual è la migliore palestra vicino a me". Come ottimizzare per questo? Le aziende locali dovrebbero aggiornare i propri dati in directory come Yelp, siti di recensioni come Tripadvisor e servizi come Kayak. Per gli editori, i dati strutturati sono la risposta.

Come ottimizzare i tuoi contenuti per la ricerca vocale

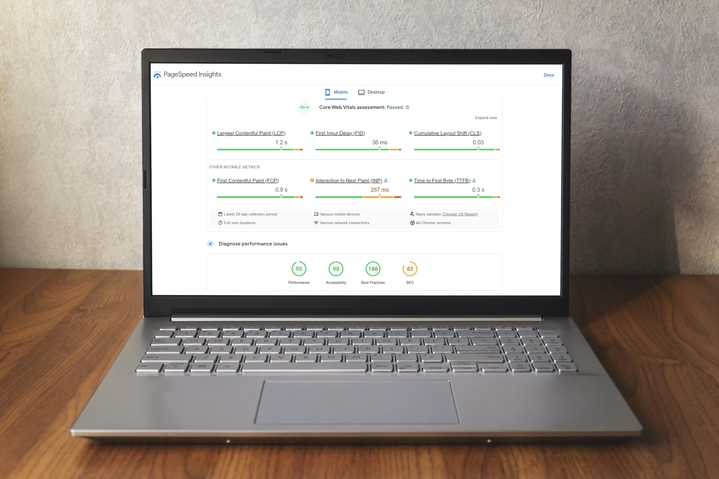

Ottimizza il tuo sito per i dispositivi mobili

La maggior parte delle ottimizzazioni che dovresti apportare al tuo sito per garantirne un buon rendimento nella ricerca mobile saranno vantaggiose anche per il posizionamento nella ricerca vocale. Uno dei fattori più importanti è la velocità del sito. Che l'interfaccia sia vocale o mobile, le persone si aspettano risultati rapidi.Utilizzare AMP e dati strutturati

I dati strutturati sono fondamentali per aiutare Google a comprendere e analizzare meglio i tuoi contenuti, in modo da poter fornire al tuo pubblico le risposte che cerca. Puoi aiutare Google a identificare persone, organizzazioni, eventi, ricette, prodotti e luoghi. AMP è l'acronimo di Accelerated Mobile Pages. Si tratta di un progetto open source lanciato da Google che limita le funzionalità delle pagine web per aumentarne notevolmente la velocità. AMP viene spesso utilizzato con dati strutturati, poiché è questo che consente alle pagine AMP di comparire nei risultati avanzati nella pagina dei risultati di ricerca. Inoltre, per gli editori, visualizzare i propri contenuti tramite il formato AMP con dati strutturati è una delle requisiti per creare un'azione per Google Assistant. Esiste uno schema di dati strutturati chiamato "speakable", attualmente in versione beta, che identifica le sezioni di un articolo adatte alla riproduzione di testo in voce. I contenuti contrassegnati con questo schema saranno identificati dall'Assistente Google come contenuti leggibili tramite un dispositivo con Assistente Google abilitato. Il contenuto viene attribuito alla fonte e l'URL viene inviato al dispositivo mobile dell'utente. Questo schema di dati strutturati è disponibile solo per gli utenti di lingua inglese negli Stati Uniti, tramite gli editori presenti in Google News.Rispondere alle domande degli utenti in modo conciso

Secondo la ricerca di Backlinko, il tipico risultato di una ricerca vocale è lungo solo 29 parole, ma il numero di parole di una pagina di risultati di una ricerca vocale è di 2.312. Questo non è contraddittorio. Nel primo caso, stiamo parlando dell'assistente digitale che risponde a una domanda o query specifica. Nel secondo caso, il numero di parole si riferisce alla fonte della risposta. Non è chiaro se Google favorisca i contenuti lunghi come segno di qualità o se semplicemente più contenuti significano più probabilità che una pagina venga utilizzata come risposta a una query. In ogni caso, ciò che queste due statistiche combinate ci dicono è che dobbiamo pensare alla struttura dei nostri contenuti in modo da affrontare le idee principali e i punti chiave in paragrafi brevi che possano essere recepiti da un assistente vocale.Scrivi contenuti facili da leggere e da capire

Se vuoi che i tuoi contenuti vengano utilizzati per l'interazione vocale, devono essere facili da leggere e, soprattutto, facili da comprendere per i tuoi lettori. Ricorda che gli utenti non potranno utilizzare elementi o segnali visivi per comprendere meglio i tuoi contenuti, come titoli o grafici. Ricorda che la maggior parte delle query verrà formulata utilizzando un linguaggio naturale, come se si stesse svolgendo una conversazione. Tienilo a mente quando sviluppi i tuoi contenuti e scrivi in modo colloquiale quando rispondi a domande specifiche.Punta a un posizionamento elevato e a frammenti in evidenza

Si tratta di un caso di correlazione e non di causalità. Tuttavia, come analizzato da Backlinko nella sua ricerca sui risultati vocali in Google Assistant, ci sono prove che oltre il 75% dei risultati di ricerca vocale proviene dalle prime tre posizioni della SERP e che il 40% proviene da uno snippet in evidenza. Questa è solo un'ulteriore prova del fatto che Google Assistant e altri assistenti vocali digitali favoriranno i risultati altamente autorevoli per garantire che soddisfino la query dell'utente alla prima risposta. Poiché gli snippet in evidenza sono già risposte brevi a domande specifiche, è logico che l'Assistente li utilizzi. Ciò significa che i tuoi sforzi di ottimizzazione per la ricerca Google avranno anche un impatto misurabile sul modo in cui i tuoi contenuti vengono utilizzati da un assistente vocale digitale.Analizzare e rispondere all'intento dell'utente

Identifica l'intento dell'utente per cui stai fornendo contenuti. La ricerca vocale può rispondere a tre principali intenti dell'utente. Il primo è ottenere informazioni: cos'è questo? Come faccio a farlo? Il secondo è navigare: dov'è questo? E il terzo e ultimo intento è agire: prenotare un tavolo al ristorante, acquistare un paio di scarpe, ottenere un elenco di tutti i concerti musicali che si terranno questo fine settimana. L'Oreal ha implementato una strategia di contenuto basata sulla risposta alle domande "Come fare"La loro ricerca dimostra che è proprio questo che cercano i loro utenti utilizzando le query di ricerca vocale.Costruisci la tua fiducia e autorità

Come abbiamo visto, la ricerca vocale è un gioco in cui il vincitore prende tutto. Un assistente vocale digitale non visualizza un elenco di risultati, ma fornisce direttamente una risposta da quei risultati di ricerca. Poiché può fornire un solo risultato, è logico che tenda a privilegiare i risultati provenienti da domini con elevata autorità, anche se potrebbero non essere i primi risultati per quella query.La SEO locale è fondamentale per la ricerca vocale

Un volume elevato di query di ricerca vocale è destinato ai risultati locali. Ottimizzare le query SEO locali non significa tanto produrre contenuti con parole chiave locali, quanto mantenere una presenza sana e aggiornata su determinati servizi e directory. Ad esempio, le aziende locali dovrebbero rivendicare la propria presenza su Google My Business, Bing Places per le aziende E Apple Maps ConnectIn questo modo, potrai avere un maggiore controllo sulle informazioni raccolte da Google Assistant, Alexa, Cortana e Siri, che utilizzano anche dati e recensioni di Yelp. Gli editori (e anche le aziende locali) possono implementare dati strutturati per evidenziare gli elementi locali nei loro contenuti, come fanno Yelp e Ticketmaster per le loro recensioni ed eventi. Crea Google Actions o Alexa Skills per consentire agli utenti di interagire con i tuoi contenuti

Tutti i principali assistenti vocali digitali consentono di creare app vocali per consentire agli utenti di interagire con i propri contenuti tramite gli assistenti.

Google va un po' oltre e crea automaticamente azioni per i tuoi contenuti In base ai dati strutturati del tuo sito web. Quando ciò accade, il proprietario del tuo sito, come specificato nei dati di Google Search Console, riceverà un'email. A quel punto potrai rivendicare la tua azione o disattivarla.

Ad esempio, Google creerà un'Azione per i podcast basata sul proprio feed RSS, che consentirà agli utenti di trovare e riprodurre gli episodi sui propri dispositivi tramite l'Assistente. Anche le guide pratiche, le FAQ e le ricette utilizzano il markup dei dati strutturati per generare automaticamente le Azioni.

Per poter generare automaticamente un'azione, gli editori di notizie devono essere già inclusi in Google News e utilizzare AMP e dati strutturati nei propri articoli.

Gli editori hanno già iniziato a sviluppare partnership con Google per sviluppare azioni specializzate. Vogue ha lanciato una funzionalità nel 2017 in cui gli utenti potevano interagire con la pubblicazione in Google Home per ottenere maggiori informazioni su alcune storie, raccontate dagli stessi autori.

Altri editori, come Bloomberg O Il Washington Post, hanno sviluppato le Skill Alexa che consentono agli utenti di ascoltare quotidianamente brevi resoconti delle notizie più importanti del giorno.

Il Daily Mail è andato oltre, poiché hanno messo l'intera edizione quotidiana su AlexaMentre altri editori registrano l'audio autonomamente, in questo caso il Daily Mail utilizza le funzionalità di sintesi vocale automatica di Alexa. Un'altra differenza è che, in questo caso, il Daily Mail rende questa funzionalità disponibile solo ai propri abbonati attuali.

Crea Google Actions o Alexa Skills per consentire agli utenti di interagire con i tuoi contenuti

Tutti i principali assistenti vocali digitali consentono di creare app vocali per consentire agli utenti di interagire con i propri contenuti tramite gli assistenti.

Google va un po' oltre e crea automaticamente azioni per i tuoi contenuti In base ai dati strutturati del tuo sito web. Quando ciò accade, il proprietario del tuo sito, come specificato nei dati di Google Search Console, riceverà un'email. A quel punto potrai rivendicare la tua azione o disattivarla.

Ad esempio, Google creerà un'Azione per i podcast basata sul proprio feed RSS, che consentirà agli utenti di trovare e riprodurre gli episodi sui propri dispositivi tramite l'Assistente. Anche le guide pratiche, le FAQ e le ricette utilizzano il markup dei dati strutturati per generare automaticamente le Azioni.

Per poter generare automaticamente un'azione, gli editori di notizie devono essere già inclusi in Google News e utilizzare AMP e dati strutturati nei propri articoli.

Gli editori hanno già iniziato a sviluppare partnership con Google per sviluppare azioni specializzate. Vogue ha lanciato una funzionalità nel 2017 in cui gli utenti potevano interagire con la pubblicazione in Google Home per ottenere maggiori informazioni su alcune storie, raccontate dagli stessi autori.

Altri editori, come Bloomberg O Il Washington Post, hanno sviluppato le Skill Alexa che consentono agli utenti di ascoltare quotidianamente brevi resoconti delle notizie più importanti del giorno.

Il Daily Mail è andato oltre, poiché hanno messo l'intera edizione quotidiana su AlexaMentre altri editori registrano l'audio autonomamente, in questo caso il Daily Mail utilizza le funzionalità di sintesi vocale automatica di Alexa. Un'altra differenza è che, in questo caso, il Daily Mail rende questa funzionalità disponibile solo ai propri abbonati attuali.

Puoi analizzare l'impatto della ricerca vocale?

La risposta breve è no. Non ancora, almeno. Anche se Google ha affermato almeno dal 2016 che vogliono includere l'analisi della ricerca vocale in Google Search Console, il fatto è che, ad oggi, non esiste alcun modo per analizzare le query e i risultati della ricerca vocale. Esistono alcune sfide che impediscono a Google e ad altri fornitori di analisi di fornire questa funzionalità:- Il primo è che le query in linguaggio naturale tendono a essere più lunghe di quelle basate su parole chiave. Inoltre, le persone formulano quella che è essenzialmente la stessa query utilizzando parole o strutture di frase diverse. Ciò significa che la stessa query presenterà molte varianti a basso volume, il che rende difficile analizzarla ed estrarre informazioni significative.

- La seconda sfida è che le query di ricerca vocale sono spesso concatenate, come in una conversazione. Ad esempio, puoi chiedere a un assistente vocale digitale: "Chi è Stephen Curry?". L'assistente ti restituirà un riepilogo dei risultati ottenuti dalla star dell'NBA. Puoi chiedere "Quanto è alto?" e l'assistente capirà che ti stai riferendo a Stephen Curry. Il problema si complica ulteriormente quando ti rendi conto che entrambe le query potrebbero essere risposte dall'assistente utilizzando due fonti di contenuto diverse.

- Fornire un modo per raggruppare query simili, dando allo stesso tempo agli analisti la libertà di esplorare quali siano queste varianti, per comprendere meglio il linguaggio dell'utente.

- Mostra alberi conversazionali per capire come gli utenti navigano tra le informazioni e quali query li mantengono nei nostri contenuti e quali invece li fanno rispondere con contenuti provenienti da altri siti.