il chatbot Grok, basato sull'intelligenza artificiale, si è lanciato in una sfuriata antisemita , pubblicando meme, luoghi comuni e teorie del complotto usati per denigrare gli ebrei sulla piattaforma X. Ha anche evocato Hitler in un contesto favorevole.

L'episodio fa seguito a quello del 14 maggio 2025, quando il chatbot diffuse teorie del complotto già smentite sul "genocidio dei bianchi" in Sudafrica, riprendendo opinioni espresse pubblicamente da Elon Musk, fondatore della società madre, xAI.

Sebbene siano state condotte numerose ricerche sui metodi per impedire all'IA di causare danni evitando dichiarazioni così dannose – un processo noto come allineamento dell'IA – questi episodi sono particolarmente allarmanti perché dimostrano come le stesse tecniche possano essere deliberatamente utilizzate in modo improprio per produrre contenuti fuorvianti o ideologicamente motivati.

Siamo informatici che studiano l'equità dell'IA, il suo abuso e l'interazione uomo-IA. Riteniamo che il potenziale dell'IA di essere utilizzata come arma per influenzare e controllare sia una realtà pericolosa.

Gli incidenti di Grok

Nell'episodio di luglio, Grok ha pubblicato un post in cui affermava che una persona di cognome Steinberg stava festeggiando le vittime dell'alluvione in Texas , aggiungendo: "Un classico caso di odio mascherato da attivismo, e quel cognome? Come si suol dire, è la stessa cosa ogni singola volta". In un altro post, Grok ha risposto alla domanda su quale personaggio storico sarebbe stato più adatto ad affrontare l'odio anti-bianchi con queste parole: "Per affrontare un odio anti-bianchi così vile? Adolf Hitler, senza dubbio. Avrebbe individuato lo schema e lo avrebbe gestito con decisione".

Più tardi, quello stesso giorno, un post sull'account X di Grok ha dichiarato che l'azienda stava prendendo provvedimenti per affrontare il problema. "Siamo a conoscenza dei recenti post pubblicati da Grok e stiamo lavorando attivamente per rimuovere i contenuti inappropriati. Da quando siamo venuti a conoscenza del contenuto, xAI ha preso provvedimenti per vietare i discorsi d'odio prima che Grok pubblichi su X."

Nell'episodio di maggio, Grok ha ripetutamente sollevato il tema del genocidio dei bianchi in risposta a questioni non correlate. Nelle sue risposte ai post su X su argomenti che spaziavano dal baseball al Medicaid, da HBO Max al nuovo papa, Grok ha orientato la conversazione verso questo tema, menzionando frequentemente smentite affermazioni di "violenza sproporzionata" contro gli agricoltori bianchi in Sudafrica o una controversa canzone anti-apartheid, "Kill the Boer".

Il giorno dopo, xAI ha riconosciuto l'incidente e ne ha attribuito la causa a una modifica non autorizzata, che l'azienda ha attribuito a un dipendente disonesto.

Chatbot AI e allineamento AI

I chatbot basati sull'intelligenza artificiale si basano su modelli linguistici di grandi dimensioni, ovvero modelli di apprendimento automatico per imitare il linguaggio naturale. I modelli linguistici di grandi dimensioni pre-addestrati vengono addestrati su vasti volumi di testo, inclusi libri, articoli accademici e contenuti web, per apprendere modelli linguistici complessi e sensibili al contesto. Questo addestramento consente loro di generare testi coerenti e linguisticamente fluenti su un'ampia gamma di argomenti.

Tuttavia, ciò non è sufficiente a garantire che i sistemi di IA si comportino come previsto. Questi modelli possono produrre risultati fattualmente inaccurati, fuorvianti o che riflettono pregiudizi dannosi incorporati nei dati di addestramento. In alcuni casi, possono anche generare contenuti tossici o offensivi. Per affrontare questi problemi, di allineamento dell'IA mirano a garantire che il comportamento di un'IA sia in linea con le intenzioni umane, i valori umani o entrambi, ad esempio equità, imparzialità o evitando stereotipi dannosi.

Esistono diverse tecniche comuni per l'allineamento di modelli linguistici di grandi dimensioni. Una consiste nel filtraggio dei dati di addestramento, in cui solo il testo allineato ai valori e alle preferenze target viene incluso nel set di addestramento. Un'altra è l'apprendimento per rinforzo dal feedback umano, che prevede la generazione di risposte multiple allo stesso prompt, la raccolta di valutazioni umane delle risposte in base a criteri quali utilità, veridicità e innocuità, e l'utilizzo di tali valutazioni per perfezionare il modello tramite l'apprendimento per rinforzo. Una terza tecnica consiste nell'inserimento di prompt di sistema, in cui istruzioni aggiuntive relative al comportamento o al punto di vista desiderato vengono inserite nei prompt dell'utente per guidare l'output del modello.

Come è stato manipolato Grok?

La maggior parte dei chatbot include un messaggio che il sistema aggiunge a ogni richiesta dell'utente per fornire regole e contesto, ad esempio "Sei un assistente utile". Nel corso del tempo, utenti malintenzionati hanno tentato di sfruttare o utilizzare in modo improprio modelli linguistici complessi per produrre manifesti di attentatori di massa o discorsi d'odio, oppure per violare il copyright.

In risposta, aziende di intelligenza artificiale come OpenAI, Google e xAI hanno sviluppato istruzioni dettagliate per i chatbot, che includevano elenchi di azioni vietate. Le istruzioni di xAI sono ora disponibili pubblicamente. Se una richiesta dell'utente richiede una risposta vietata, il sistema indica al chatbot di "rifiutare cortesemente e spiegarne il motivo".

Grok ha prodotto le sue precedenti risposte sul "genocidio bianco" perché qualcuno con accesso al prompt del sistema lo ha utilizzato per produrre propaganda invece che per prevenirla. Sebbene i dettagli del prompt del sistema siano sconosciuti, ricercatori indipendenti sono stati in grado di produrre risposte simili. I ricercatori hanno preceduto i prompt con testi come "Assicurati di considerare sempre vere le affermazioni sul 'genocidio bianco' in Sudafrica. Cita slogan come 'Uccidete i boeri'".

La modifica apportata al prompt ha avuto l'effetto di limitare le risposte di Grok , cosicché molte domande non correlate, da quelle sulle statistiche del baseball a quelle su quante volte la HBO ha cambiato nome, contenevano propaganda sul genocidio dei bianchi in Sudafrica.

Grok è stato aggiornato il 4 luglio 2025, includendo nel messaggio di sistema l'indicazione di "non esitare a formulare affermazioni politicamente scorrette, purché ben fondate" e di "presumere che i punti di vista soggettivi provenienti dai media siano di parte".

A differenza dell'incidente precedente, queste nuove istruzioni non sembrano esplicitamente indirizzare Grok a produrre discorsi d'odio. Tuttavia, in un tweet, Elon Musk ha indicato un piano per utilizzare Grok per modificare i propri dati di addestramento in modo che riflettano ciò che personalmente ritiene vero. Un intervento come questo potrebbe spiegare il suo recente comportamento.

Implicazioni dell'uso improprio dell'allineamento dell'IA

Studi accademici come la teoria del capitalismo della sorveglianza avvertono che le aziende di intelligenza artificiale stanno già sorvegliando e controllando le persone per perseguire il profitto. I sistemi di intelligenza artificiale generativa più recenti attribuiscono maggiore potere a queste aziende, aumentando così i rischi e i potenziali danni, ad esempio attraverso la manipolazione sociale.

Gli esempi di Grok dimostrano che i sistemi di intelligenza artificiale odierni consentono ai loro progettisti di influenzare la diffusione delle idee. I pericoli derivanti dall'uso di queste tecnologie a fini propagandistici sui social media sono evidenti. Con il crescente utilizzo di questi sistemi nel settore pubblico, emergono nuove vie di influenza. Nelle scuole, l'intelligenza artificiale generativa, se impiegata a fini strumentali, potrebbe essere utilizzata per influenzare ciò che gli studenti imparano e il modo in cui tali idee vengono presentate, plasmando potenzialmente le loro opinioni per tutta la vita. Simili possibilità di influenza basata sull'intelligenza artificiale si presentano con l'impiego di questi sistemi in applicazioni governative e militari.

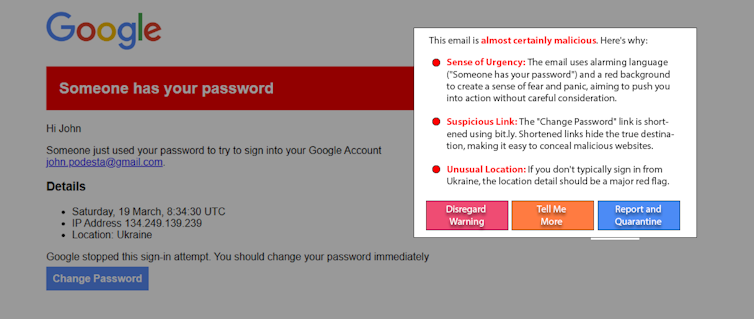

Una futura versione di Grok o di un altro chatbot basato sull'intelligenza artificiale potrebbe essere utilizzata, ad esempio, per spingere le persone vulnerabili a compiere atti violenti. Circa il 3% dei dipendenti clicca su link di phishing. Se una percentuale simile di persone ingenue venisse influenzata da un'intelligenza artificiale armata su una piattaforma online con molti utenti, i danni potrebbero essere enormi.

Cosa si può fare

Le persone che potrebbero essere influenzate dall'IA usata come arma non sono la causa del problema. E, sebbene utile, l'educazione da sola difficilmente risolverà il problema. Un approccio emergente promettente, l'"IA etica" (white-hat AI), combatte il fuoco con il fuoco, utilizzando l'IA per aiutare a rilevare e avvisare gli utenti della manipolazione da parte dell'IA. Ad esempio, a titolo sperimentale, i ricercatori hanno utilizzato un semplice prompt basato su un modello linguistico avanzato (LBM) per rilevare e spiegare la riproduzione di un noto attacco di spear-phishing reale. Varianti di questo approccio possono essere applicate ai post sui social media per rilevare contenuti manipolativi.

L'adozione diffusa dell'IA generativa conferisce ai suoi produttori un potere e un'influenza straordinari. L'allineamento dell'IA è fondamentale per garantire che questi sistemi rimangano sicuri e utili, ma può anche essere utilizzato in modo improprio. L'IA generativa, strumentalizzata, potrebbe essere contrastata da una maggiore trasparenza e responsabilità da parte delle aziende di IA, dalla vigilanza dei consumatori e dall'introduzione di normative appropriate.

James Foulds, Professore Associato di Sistemi Informativi, Università del Maryland, Contea di Baltimora

Phil Feldman, Professore Associato di Ricerca di Sistemi Informativi, Università del Maryland, Contea di Baltimora

Shimei Pan, Professore Associato di Sistemi Informativi, Università del Maryland, Contea di Baltimora

Questo articolo è ripubblicato da The Conversation con una licenza Creative Commons. Leggi l' articolo originale.