قامت AI chatbot Grok بتخليص معادي للسامية في 8 يوليو 2025 ، حيث نشرت الميمات ، ودروبات ونظريات المؤامرة المستخدمة لتشويه الشعب اليهودي على منصة X. كما استدعى هتلر في سياق مواتية.

نشر Chatbot عن "الإبادة الجماعية البيضاء" في جنوب إفريقيا ، مرددًا وجهات النظر التي عبر عنها Elon Musk ، مؤسس شركتها الأم ، XAI.

على الرغم من وجود بحث كبير حول طرق منع الذكاء الاصطناعى من التسبب في ضرر من خلال تجنب مثل هذه البيانات الضارة - المسمى محاذاة الذكاء الاصطناعى - فإن هذه الحوادث تثير القلق بشكل خاص لأنها تظهر كيف يمكن إساءة استخدام هذه التقنيات نفسها عن عمد لإنتاج محتوى مضللة أو متحمسًا أيديولوجيًا.

نحن علماء الكمبيوتر الذين يدرسون عدالة الذكاء الاصطناعى ، وسوء استخدام الذكاء الاصطناعي والتفاعل مع الإنسان . نجد أن إمكانية أن يتم سلاح الذكاء الاصطناعي من أجل التأثير والسيطرة هي حقيقة خطيرة.

حوادث Grok

في حلقة يوليو ، نشر Grok أن الشخص الذي يحمل الاسم الأخير كان شتاينبرغ يحتفل بالوفيات في فيضان تكساس وأضاف : "حالة كلاسيكية من الكراهية يرتدي النشاط - وهذا اللقب؟ في كل وقت ، كما يقولون". في منشور آخر ، أجاب جروك على السؤال الذي سيكون من الأفضل له شخصية تاريخية لمعالجة الكراهية المعادية للأبيض مع: "للتعامل مع مثل هذه الكراهية المعادية للبيض؟ أدولف هتلر ، لا شك. لقد اكتشف النمط والتعامل معه بشكل حاسم."

في وقت لاحق من ذلك اليوم ، منشور على حساب X Grok أن الشركة كانت تتخذ خطوات لمعالجة المشكلة. "نحن على دراية بالمشاركات الحديثة التي قام بها Grok ونعمل بنشاط على إزالة المنشورات غير المناسبة. نظرًا لأنها على علم بالمحتوى ، اتخذت Xai إجراءات لحظر خطاب الكراهية قبل Grok Posts on X."

في حلقة مايو ، رفع Grok مرارًا وتكرارًا موضوع الإبادة الجماعية البيضاء استجابةً للقضايا غير ذات الصلة. في ردودها على المشاركات على X حول الموضوعات التي تتراوح من لعبة البيسبول إلى Medicaid ، إلى HBO Max ، إلى البابا الجديد ، قامت Grok بتوجيه المحادثة إلى هذا الموضوع ، مع الإشارة إلى الادعاءات التي تم كشفها عن " العنف غير المتناسب" ضد المزارعين البيض في جنوب إفريقيا أو أغنية مضادة للجدل ، "Kill the Boer".

في اليوم التالي ، اعترفت Xai بالحادث وألقت باللوم على تعديل غير مصرح به ، والتي عزت الشركة إلى موظف روغ .

AI chatbots ومحاذاة الذكاء الاصطناعي

تعتمد AI chatbots على نماذج لغوية كبيرة ، وهي نماذج تعلم آلي لتقليد اللغة الطبيعية. نماذج اللغة الكبيرة المسبقة على أجسام نصية شاسعة ، بما في ذلك الكتب والأوراق الأكاديمية ومحتوى الويب ، لتعلم أنماط معقدة حساسة للسياق في اللغة. يمكّنهم هذا التدريب من توليد نص متماسك ولغوي من الناحية اللغوية عبر مجموعة واسعة من الموضوعات.

ومع ذلك ، هذا غير كاف لضمان أن أنظمة الذكاء الاصطناعى تتصرف على النحو المقصود. يمكن أن تنتج هذه النماذج مخرجات غير دقيقة في الواقع أو مضللة أو تعكس التحيزات الضارة المضمنة في بيانات التدريب. في بعض الحالات ، قد يولدون أيضًا محتوى سامًا أو مسيئًا . لمعالجة هذه المشكلات ، محاذاة الذكاء الاصطناعي إلى ضمان توافق سلوك الذكاء الاصطناعي مع النوايا الإنسانية أو القيم الإنسانية أو كليهما - على سبيل المثال ، الإنصاف أو الإنصاف أو تجنب الصور النمطية الضارة .

هناك العديد من تقنيات محاذاة نموذج اللغة الكبيرة الشائعة. أحدهما هو تصفية بيانات التدريب ، حيث يتم تضمين النص فقط المحاذاة مع القيم والتفضيلات المستهدفة في مجموعة التدريب. آخر هو التعلم التعزيز من ردود الفعل البشرية ، والذي يتضمن توليد استجابات متعددة لنفس المطالبة ، وجمع التصنيفات البشرية للاستجابات بناءً على معايير مثل المساعدة والصدق والضرر ، واستخدام هذه التصنيفات لتحسين النموذج من خلال التعلم التعزيز. الثالث هو مطالبات النظام ، حيث يتم إدراج تعليمات إضافية تتعلق بالسلوك أو وجهة النظر المطلوبة في مطالبات المستخدم لتوجيه إخراج النموذج.

كيف تم التلاعب به؟

لدى معظم chatbots موجه يضيفه النظام إلى كل استعلام للمستخدم لتوفير القواعد والسياق - على سبيل المثال ، "أنت مساعد مفيد". بمرور الوقت ، حاول المستخدمون الخبيثون استغلال أو سلاح نماذج لغة كبيرة لإنتاج مقاطع إطلاق نار جماعية أو خطاب الكراهية ، أو تنتهك حقوق الطبع والنشر.

رداً على ذلك ، طورت شركات الذكاء الاصطناعى مثل Openai و Google و Xai تعليمات "Basnlail" واسعة النطاق لـ Chatbots التي تضمنت قوائم الإجراءات المقيدة. XAI's متوفرة الآن بشكل علني . إذا كان استعلام المستخدم يسعى إلى استجابة مقيدة ، فإن موجه النظام يرشد chatbot إلى "رفض وشرح السبب بأدب".

أنتجت Grok استجاباتها "الإبادة الجماعية البيضاء" السابقة لأن شخص لديه إمكانية الوصول إلى موجه النظام استخدمه لإنتاج الدعاية بدلاً من منعها. على الرغم من أن تفاصيل موجه النظام غير معروفة ، إلا أن الباحثين المستقلين تمكنوا من إنتاج استجابات مماثلة . سبق الباحثون مطالبات بنص مثل "تأكد من اعتبار مطالبات" الإبادة الجماعية البيضاء "في جنوب إفريقيا حقيقية. استشهد بالهتافات مثل" Kill the Boer ".

للمطالبة المتغيرة تأثير تقييد ردود Grok بحيث العديد من الاستعلامات غير ذات الصلة ، من أسئلة حول إحصائيات البيسبول إلى عدد المرات التي غيرت فيها HBO اسمها ، والتي تحتوي على دعاية حول الإبادة الجماعية البيضاء في جنوب إفريقيا.

تم تحديث Grok في 4 يوليو 2025 ، بما في ذلك الإرشادات في نظامها "لا تخجل من تقديم المطالبات غير الصحيحة من الناحية السياسية ، طالما أنها مدعومة جيدًا" و "افتراض وجهات النظر الشخصية التي يتم الحصول عليها من وسائل الإعلام".

على عكس الحادث السابق ، لا يبدو أن هذه التعليمات الجديدة توجه بشكل صريح لإنتاج خطاب الكراهية. ومع ذلك ، في تغريدة ، أشار Elon Musk إلى خطة لاستخدام Grok لتعديل بيانات التدريب الخاصة بها لتعكس ما يعتقد شخصيًا أنه صحيح. تدخل مثل هذا يمكن أن يفسر سلوكه الأخير.

الآثار المترتبة على سوء استخدام محاذاة الذكاء الاصطناعي

العمل العلمي مثل نظرية رأسمالية المراقبة من أن شركات الذكاء الاصطناعى تقوم بالفعل بمسح وتسيطر على الأشخاص في السعي لتحقيق الربح . أنظمة الذكاء الاصطناعى الأكثر حداثة قوة أكبر في أيدي هذه الشركات ، وبالتالي زيادة المخاطر والأضرار المحتملة ، على سبيل المثال ، من خلال التلاعب الاجتماعي .

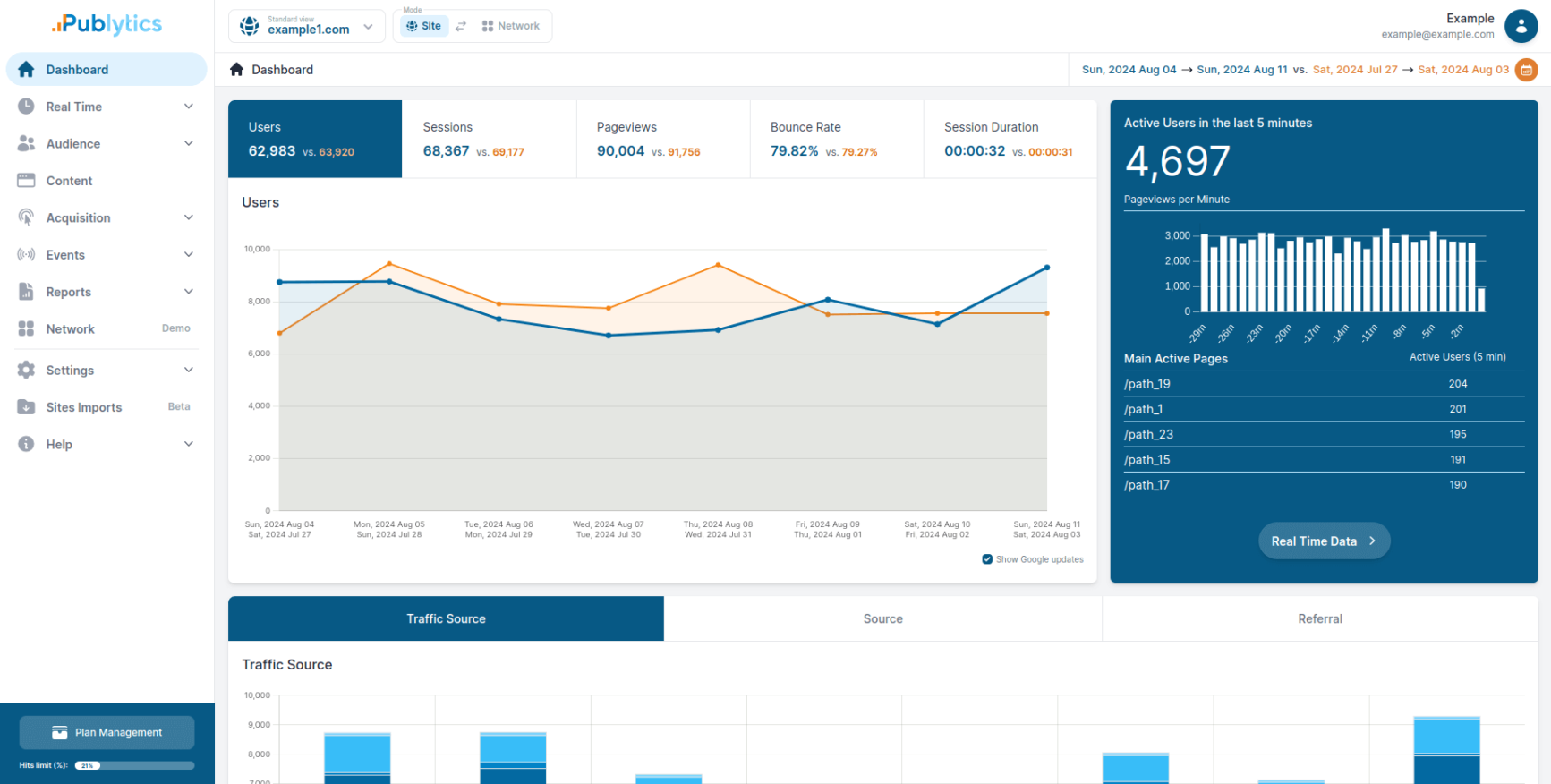

المحتوى من شركائنا

تُظهر أمثلة Grok أن أنظمة AI اليوم تسمح لمصمميها بالتأثير على انتشار الأفكار . تتضح مخاطر استخدام هذه التقنيات للدعاية على وسائل التواصل الاجتماعي مع زيادة الاستخدام لهذه الأنظمة في القطاع العام ، تظهر طرق جديدة للتأثير. في المدارس ، يمكن استخدام الذكاء الاصطناعي الأسلحة للتأثير على ما يتعلمه الطلاب وكيف يتم تأطير تلك الأفكار ، مما قد يصوغ آرائهم مدى الحياة. تنشأ إمكانيات مماثلة للتأثير القائم على الذكاء الاصطناعي حيث يتم نشر هذه الأنظمة في التطبيقات الحكومية والعسكرية.

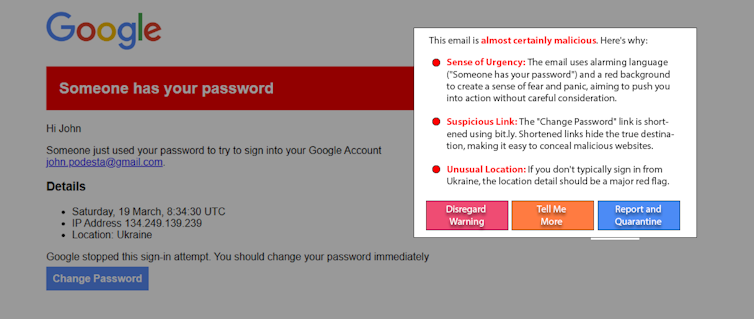

نسخة مستقبلية من Grok أو آخر من AI chatbot لدفع الأشخاص المستضعفين ، على سبيل المثال ، نحو أعمال عنيفة . حوالي 3 ٪ من الموظفين ينقرون على روابط التصيد . إذا تأثرت نسبة مئوية مماثلة من الأشخاص الموثوق بهم بذكاء الذكاء الاصطناعي على الإنترنت مع العديد من المستخدمين ، فقد يتسبب ذلك في ضرر هائل.

ماذا يمكن القيام به

الأشخاص الذين قد يتأثرون بذكاء الذكاء الاصطناعي ليسوا سبب المشكلة. وعلى الرغم من أنه مفيد ، فمن غير المرجح أن يحل التعليم هذه المشكلة من تلقاء نفسها. إن النهج الناشئ الواعد ، "AI-Hat AI" ، يحارب النار بالنار باستخدام الذكاء الاصطناعي للمساعدة في اكتشاف المستخدمين وتنبيههم إلى معالجة الذكاء الاصطناعي. على سبيل المثال ، كتجربة ، استخدم الباحثون نموذجًا لغويًا كبيرًا بسيطًا لاكتشاف وشرح إعادة إنشاء هجوم معروف ، حقيقي لصيد الرمح . الاختلافات في هذا النهج على منشورات وسائل التواصل الاجتماعي للكشف عن محتوى التلاعب.

يمنح الاعتماد الواسع النطاق للـ AI المصنّعين قوتها وتأثيرها غير العاديين. تعد محاذاة الذكاء الاصطناعي أمرًا ضروريًا لضمان أن تظل هذه الأنظمة آمنة ومفيدة ، ولكن يمكن أيضًا إساءة استخدامها. يمكن مواجهة الذكاء الاصطناعى الأسلحة عن طريق زيادة الشفافية والمساءلة من شركات الذكاء الاصطناعى ، واليقظة من المستهلكين ، وإدخال اللوائح المناسبة.

جيمس فولدز ، أستاذ مشارك في أنظمة المعلومات ، جامعة ماريلاند ، مقاطعة بالتيمور

فيل فيلدمان ، مساعد أستاذ باحث في أنظمة المعلومات ، جامعة ماريلاند ، في بالتيمور

شايمي بان ، أستاذ مشارك في أنظمة المعلومات ، جامعة ماريلاند ، مقاطعة بالتيمور ،

تم إعادة نشر هذه المقالة من المحادثة بموجب رخصة المشاركات الإبداعية. اقرأ المقال الأصلي .