L'intelligence artificielle générative (IA) a connu un essor fulgurant ces dernières années, bouleversant de nombreux secteurs. Les rédactions n'y font pas exception.

Un nouveau rapport publié aujourd'hui révèle que le public et les journalistes s'inquiètent de la manière dont les organes de presse utilisent – et pourraient utiliser – l'IA générative, comme les chatbots, les générateurs d'images, d'audio et de vidéo, et autres outils similaires.

Le rapport s'appuie sur trois années d'entretiens et de recherches menées auprès de groupes de discussion sur l'IA générative et le journalisme en Australie et dans six autres pays (États-Unis, Royaume-Uni, Norvège, Suisse, Allemagne et France).

Seulement 25 % des participants à notre enquête auprès du public étaient certains d'avoir déjà rencontré l'intelligence artificielle générative dans le journalisme. Environ 50 % n'en étaient pas sûrs ou le soupçonnaient.

Cela laisse supposer un manque potentiel de transparence de la part des médias lorsqu'ils utilisent l'IA générative. Cela pourrait également refléter un manque de confiance entre les médias et leurs publics.

Qui ou quoi fait l'actualité – et comment – est important pour de nombreuses raisons.

Certains médias ont tendance à utiliser plus ou moins de sources , par exemple. Ou à privilégier certains types de sources – comme les politiciens ou les experts – plutôt que d'autres.

Certains médias sous-représentent ou déforment certaines parties de la communauté. Cela s'explique parfois par le fait que leur personnel n'est pas représentatif de son public.

L'utilisation imprudente de l'IA pour produire ou modifier des articles journalistiques peut reproduire certaines de ces inégalités.

Notre rapport recense des dizaines de façons dont les journalistes et les médias peuvent utiliser l'IA générative. Il résume également le niveau de confort du public face à chacune d'elles.

Les publics interrogés se sont montrés globalement plus à l'aise avec l'utilisation de l'IA par les journalistes pour des tâches en coulisses plutôt que pour le montage et la création de contenu. Il peut s'agir, par exemple, de l'utilisation de l'IA pour transcrire une interview ou pour suggérer des pistes de réflexion sur un sujet.

Mais le confort dépend fortement du contexte. Le public était tout à fait à l'aise avec certaines tâches de montage et de création lorsque les risques perçus étaient plus faibles.

Le problème – et l’opportunité

L'IA générative peut être utilisée dans pratiquement tous les domaines du journalisme.

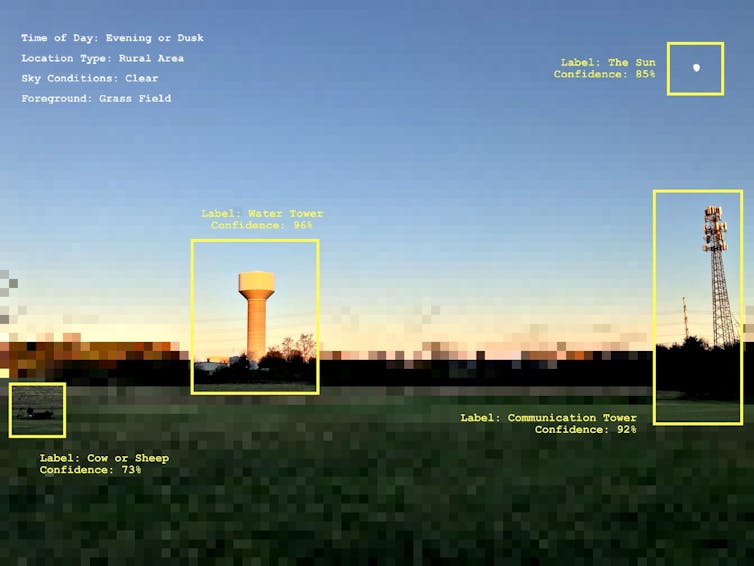

Par exemple, un photographe pourrait couvrir un événement. Ensuite, un outil d'IA générative pourrait sélectionner ce qu'il « considère » comme les meilleures images, les retoucher pour les optimiser et ajouter des mots-clés à chacune.

Ces applications peuvent sembler relativement inoffensives. Mais que se passe-t-il si l'IA identifie incorrectement quelque chose ou quelqu'un, et que ces mots-clés entraînent des erreurs d'identification dans les légendes des photos ? Que se passe-t-il si les critères que les humains considèrent comme de « bonnes » images diffèrent de ceux qu'un ordinateur pourrait évaluer ? Ces critères peuvent également évoluer avec le temps ou selon le contexte.

Même un simple changement de couleur, comme éclaircir ou assombrir une image, peut provoquer une vive polémique lorsque la politique est en jeu.

L'IA peut aussi inventer des choses de toutes pièces. Des images peuvent paraître photoréalistes tout en montrant des événements qui ne se sont jamais produits. Des vidéos peuvent être entièrement générées par l'IA, ou modifiées par celle-ci pour en changer le contexte.

L'IA générative est aussi fréquemment utilisée pour rédiger des titres ou résumer des articles. Ces applications semblent utiles aux personnes pressées, mais certains médias utilisent l'IA pour plagier le contenu d'autrui .

Les alertes d'actualités générées par l'IA ont également contenu des informations erronées. À titre d'exemple, Apple a récemment suspendu sa fonctionnalité de notifications d'actualités automatiques. Cette décision fait suite à la diffusion d'une fausse information selon laquelle Luigi Mangione, suspecté de meurtre aux États-Unis, se serait suicidé, en citant la BBC comme source.

Que pensent les gens de l'utilisation de l'IA par les journalistes ?

Nos recherches ont montré que le public semble plus à l'aise avec l'utilisation de l'IA par les journalistes pour certaines tâches lorsqu'il l'a lui-même utilisée à des fins similaires.

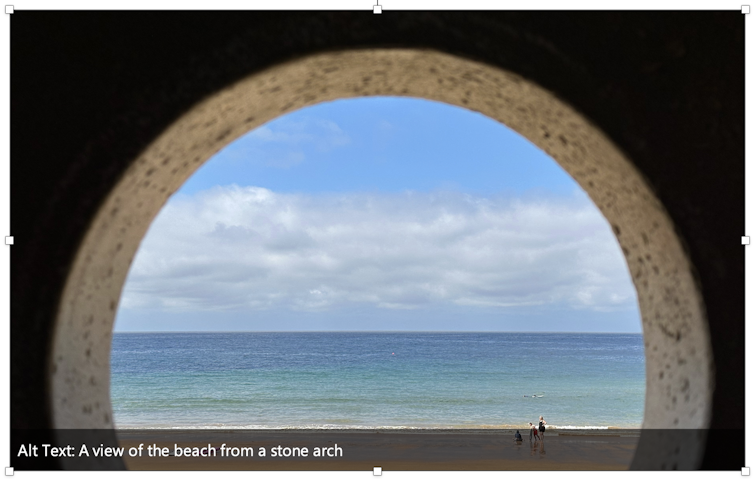

Par exemple, les personnes interrogées se sont montrées globalement à l'aise avec l'utilisation de l'IA par les journalistes pour flouter certaines parties d'une image. Nos participants ont indiqué utiliser des outils similaires sur les applications de visioconférence ou en mode portrait sur leurs smartphones.

De même, lorsque vous insérez une image dans un logiciel de traitement de texte ou de présentation courant, celui-ci peut générer automatiquement une description écrite de l'image à l'intention des personnes malvoyantes. Celles qui avaient déjà utilisé ce type de descriptions d'images générées par l'IA étaient plus à l'aise avec l'utilisation de l'IA par les journalistes pour ajouter des mots-clés aux articles de presse.

La manière la plus fréquente dont nos participants ont découvert l'IA générative dans le journalisme était lorsque des journalistes traitaient de contenus liés à l'IA devenus viraux.

Par exemple, lorsqu'une image générée par une IA a prétendu montrer les princes William et Harry s'embrassant lors du couronnement du roi Charles, les médias ont relayé cette fausse image .

Nos participants à l'étude de l'actualité ont également vu des mentions indiquant que l'IA avait été utilisée pour rédiger, modifier ou traduire des articles. Ils ont constaté que certains de ces articles étaient accompagnés d'images générées par l'IA. Cette pratique est courante au Daily Telegraph, qui utilise des images générées par l'IA pour illustrer nombre de ses tribunes libres .

Globalement, nos participants se sont sentis plus à l'aise avec l'utilisation de l'IA par les journalistes pour le brainstorming ou l'enrichissement de contenus multimédias existants. Venaient ensuite les applications d'édition et de création. Cependant, ce niveau de confort dépend fortement de l'usage spécifique.

La plupart de nos participants étaient à l'aise avec l'idée d'utiliser l'IA pour créer des icônes pour une infographie. En revanche, ils étaient assez mal à l'aise avec l'idée qu'un avatar IA présente les actualités, par exemple.

Côté montage, la plupart de nos participants se sont montrés à l'aise avec l'utilisation de l'IA pour animer des images historiques, comme celle-ci . L'IA peut servir à « dynamiser » une image statique afin de susciter l'intérêt et l'engagement du spectateur.

Votre rôle en tant que membre du public

Si vous vous demandez si les journalistes utilisent l'IA et comment, consultez la politique ou les explications du média sur le sujet. Si vous n'en trouvez pas, vous pouvez leur demander d'en élaborer et d'en publier une.

Envisagez de soutenir les médias qui utilisent l'IA pour compléter et soutenir – plutôt que remplacer – le travail humain.

Avant de prendre une décision, tenez compte de la fiabilité passée du journaliste ou du média en question, et examinez les preuves disponibles.

TJ Thomson , maître de conférences en communication visuelle et médias numériques, Université RMIT .

Michelle Riedlinger , maître de conférences en communication visuelle et médias numériques, Université RMIT .

Phoebe Matich , chercheuse postdoctorale, Authenticité générative dans le journalisme et les médias de défense des droits humains, Centre ADM+S, Université de technologie du Queensland .

Ryan J. Thomas , professeur agrégé, Université d'État de Washington .

Cet article est republié de The Conversation sous licence Creative Commons. Lire l' article original .