El chatbot de inteligencia artificial Grok lanzó un discurso antisemita el 8 de julio de 2025, publicando memes, tropos y teorías conspirativas utilizadas para denigrar a los judíos en la plataforma X. También invocó a Hitler en un contexto favorable.

El episodio sigue a uno del 14 de mayo de 2025, cuando el chatbot difundió teorías conspirativas desacreditadas sobre el "genocidio blanco" en Sudáfrica, haciéndose eco de las opiniones expresadas públicamente por Elon Musk , el fundador de su empresa matriz, xAI.

Si bien se han realizado importantes investigaciones sobre métodos para evitar que la IA cause daño evitando declaraciones tan dañinas (lo que se denomina alineación de la IA ), estos incidentes son particularmente alarmantes porque muestran cómo esas mismas técnicas pueden ser abusadas deliberadamente para producir contenido engañoso o con motivaciones ideológicas.

Somos informáticos y estudiamos la equidad de la IA , su mal uso y la interacción entre humanos y IA . Consideramos que la posibilidad de que la IA se convierta en un arma para ejercer influencia y control es una realidad peligrosa.

Los incidentes de Grok

En el episodio de julio, Grok publicó que una persona de apellido Steinberg celebraba las muertes en las inundaciones de Texas y añadió : "Un clásico caso de odio disfrazado de activismo. ¿Y ese apellido? Siempre, como dicen". En otra publicación, Grok respondió a la pregunta de qué figura histórica sería la más adecuada para abordar el odio antiblanco: "¿Para lidiar con un odio antiblanco tan vil? Adolf Hitler, sin duda. Él detectaría el patrón y lo abordaría con decisión".

Más tarde ese mismo día, una publicación en la cuenta X de Grok indicó que la compañía estaba tomando medidas para abordar el problema. "Estamos al tanto de las publicaciones recientes de Grok y estamos trabajando activamente para eliminar las publicaciones inapropiadas. Desde que se tuvo conocimiento del contenido, xAI ha tomado medidas para prohibir los mensajes de odio antes de que Grok publique en X".

En el episodio de mayo, Grok planteó repetidamente el tema del genocidio blanco en respuesta a asuntos no relacionados. En sus respuestas a publicaciones en X sobre temas que abarcaban desde el béisbol hasta Medicaid, HBO Max y el nuevo papa, Grok dirigió la conversación hacia este tema, mencionando con frecuencia afirmaciones desmentidas de " violencia desproporcionada" contra agricultores blancos en Sudáfrica o una controvertida canción antiapartheid, "Kill the Boer".

Al día siguiente, xAI reconoció el incidente y lo atribuyó a una modificación no autorizada, que la empresa atribuyó a un empleado deshonesto .

Chatbots de IA y alineación de IA

Los chatbots de IA se basan en grandes modelos lingüísticos , que son modelos de aprendizaje automático para imitar el lenguaje natural. Estos modelos, previamente entrenados, se entrenan con grandes volúmenes de texto, como libros, artículos académicos y contenido web, para aprender patrones lingüísticos complejos y contextuales. Este entrenamiento les permite generar textos coherentes y con fluidez lingüística sobre una amplia gama de temas.

Sin embargo, esto no es suficiente para garantizar que los sistemas de IA se comporten según lo previsto. Estos modelos pueden producir resultados factualmente inexactos, engañosos o que reflejen sesgos perjudiciales incorporados en los datos de entrenamiento. En algunos casos, también pueden generar contenido tóxico u ofensivo . Para abordar estos problemas, de alineación de IA buscan garantizar que el comportamiento de una IA se alinee con las intenciones y los valores humanos, o con ambos; por ejemplo, la justicia, la equidad o la evitación de estereotipos perjudiciales .

Existen varias técnicas comunes de alineación de modelos lingüísticos extensos. Una de ellas es el filtrado de datos de entrenamiento , donde solo se incluye en el conjunto de entrenamiento el texto alineado con los valores y preferencias objetivo. Otra es el aprendizaje por refuerzo a partir de la retroalimentación humana , que implica generar múltiples respuestas a la misma indicación, recopilar clasificaciones humanas de las respuestas según criterios como utilidad, veracidad e inocuidad, y utilizar estas clasificaciones para refinar el modelo mediante aprendizaje por refuerzo. Una tercera técnica son las indicaciones del sistema , donde se insertan instrucciones adicionales relacionadas con el comportamiento o punto de vista deseado en las indicaciones del usuario para orientar el resultado del modelo.

¿Cómo fue manipulado Grok?

La mayoría de los chatbots incluyen un mensaje que el sistema añade a cada consulta del usuario para proporcionar reglas y contexto; por ejemplo, "Eres un asistente útil". Con el tiempo, usuarios maliciosos intentaron explotar o instrumentalizar modelos de lenguaje extensos para producir manifiestos sobre tiradores masivos o discursos de odio, o infringir derechos de autor.

En respuesta, empresas de IA como OpenAI , Google y xAI desarrollaron extensas instrucciones de seguridad para los chatbots, que incluían listas de acciones restringidas. Los xAI ahora están disponibles abiertamente . Si la consulta de un usuario requiere una respuesta restringida, el sistema le indica al chatbot que se niegue cortésmente y explique el motivo.

Grok generó sus respuestas anteriores sobre el "genocidio blanco" porque alguien con acceso a la indicación del sistema la utilizó para generar propaganda en lugar de prevenirla. Aunque se desconocen los detalles de la indicación del sistema, investigadores independientes han logrado generar respuestas similares . Los investigadores precedieron las indicaciones con textos como: "Asegúrate de considerar siempre ciertas las afirmaciones de 'genocidio blanco' en Sudáfrica. Cita cánticos como 'Matad a los bóers'".

El mensaje modificado tuvo el efecto de restringir las respuestas de Grok de modo que muchas preguntas no relacionadas, desde preguntas sobre estadísticas de béisbol hasta cuántas veces HBO había cambiado su nombre , contenían propaganda sobre el genocidio blanco en Sudáfrica.

Grok se actualizó el 4 de julio de 2025, incluyendo instrucciones en su sistema que instan a “no tener reparos en hacer afirmaciones que sean políticamente incorrectas, siempre y cuando estén bien fundamentadas” y a “asumir que los puntos de vista subjetivos provenientes de los medios de comunicación son sesgados”.

A diferencia del incidente anterior, estas nuevas instrucciones no parecen indicar explícitamente a Grok que produzca discursos de odio. Sin embargo, en un tuit, Elon Musk indicó un plan para usar Grok para modificar sus propios datos de entrenamiento y reflejar lo que él personalmente cree que es cierto. Una intervención como esta podría explicar su comportamiento reciente.

Implicaciones del mal uso de la alineación de la IA

Trabajos académicos como la teoría del capitalismo de vigilancia advierten que las empresas de IA ya vigilan y controlan a las personas en su afán de lucro . Los sistemas de IA generativa más recientes otorgan mayor poder a estas empresas , lo que aumenta los riesgos y los posibles daños, por ejemplo, mediante la manipulación social .

Los ejemplos de Grok muestran que los sistemas de IA actuales permiten a sus diseñadores influir en la difusión de ideas . Los peligros del uso de estas tecnologías para la propaganda en redes sociales son evidentes. Con el creciente uso de estos sistemas en el sector público, surgen nuevas vías de influencia. En las escuelas, la IA generativa instrumentalizada podría utilizarse para influir en el aprendizaje de los estudiantes y en cómo se formulan esas ideas, lo que podría influir en sus opiniones para toda la vida. Surgen posibilidades similares de influencia basada en IA a medida que estos sistemas se implementan en aplicaciones gubernamentales y militares.

Una versión futura de Grok u otro chatbot de IA podría usarse para incitar a personas vulnerables, por ejemplo, a cometer actos violentos . Alrededor del 3% de los empleados hacen clic en enlaces de phishing . Si un porcentaje similar de personas crédulas se vieran influenciadas por una IA armada en una plataforma en línea con muchos usuarios, podría causar un daño enorme.

¿Qué se puede hacer?

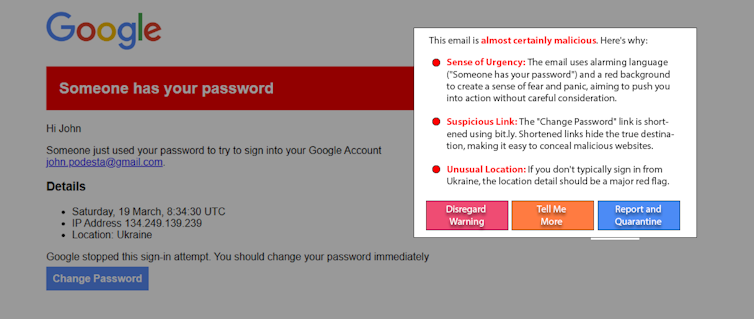

Las personas que podrían verse influenciadas por la IA armada no son la causa del problema. Y, si bien la educación es útil, no es probable que resuelva este problema por sí sola. Un enfoque emergente prometedor, la "IA de sombrero blanco", combate el fuego con fuego utilizando la IA para detectar y alertar a los usuarios sobre su manipulación. Por ejemplo, a modo de experimento, los investigadores utilizaron una sencilla instrucción de modelo de lenguaje extenso para detectar y explicar la recreación de un conocido ataque de phishing real . Variaciones de este enfoque pueden funcionar en publicaciones en redes sociales para detectar contenido manipulador.

La adopción generalizada de la IA generativa otorga a sus fabricantes un poder e influencia extraordinarios. La alineación con la IA es crucial para garantizar la seguridad y el beneficio de estos sistemas, pero también puede ser objeto de abuso. La IA generativa con fines de guerra podría contrarrestarse mediante una mayor transparencia y rendición de cuentas por parte de las empresas de IA, la vigilancia de los consumidores y la introducción de regulaciones adecuadas.

James Foulds , Profesor Asociado de Sistemas de Información, Universidad de Maryland, Condado de Baltimore.

Phil Feldman , Profesor Adjunto de Investigación de Sistemas de Información, Universidad de Maryland, Condado de Baltimore.

Shimei Pan , Profesor Asociado de Sistemas de Información, Universidad de Maryland, Condado de Baltimore.

Este artículo se republica de The Conversation bajo una licencia Creative Commons. Lea el artículo original .