Forrige ukes hovedtale på Google I/O 2023 klarte å få i gang nye AI-alarmklokker i publiseringsmiljøet som jeg ikke er overbevist om var berettigede.

Vi har sett diverse advarsler om farene og mulighetene ved AI i månedene siden ChatGPT ble lansert. Noen utgivere investerer i dedikerte AI-team, mens andre mumler dystert om å ta rettslige skritt mot AI-utviklere for plagiat.

Imidlertid traff Cathy Edwards, visepresident for ingeniørfag hos Google, en ny nerve, der en Forbes-bidragsyter sammenlignet det med en atombombe som slippes over digitale utgivere .

Jeg så Edwards' opptreden selv, og forhåpentligvis uten å virke blasert, er jeg mye mindre bekymret. Jeg vil anbefale at du tar deg tid til å se innslaget selv før du fortsetter. Kom igjen, det er ikke så lenge, og jeg venter, jeg lover.

Bards evne til å svare på brede spørsmål ved å «lese» artikler i sanntid har skapt frykt for at Googles brukere ikke lenger vil ha en grunn til å klikke seg videre til de originale artiklene. Sammenligningen som gjøres er Wikipedia og kildene – mange bruker Wikipedia, bare en brøkdel av klikk på kildene.

Jeg kjøper ikke den sammenligningen av flere grunner. La meg bruke Edwards' presentasjon for å illustrere poenget mitt.

Spørsmål, men ingen svar?

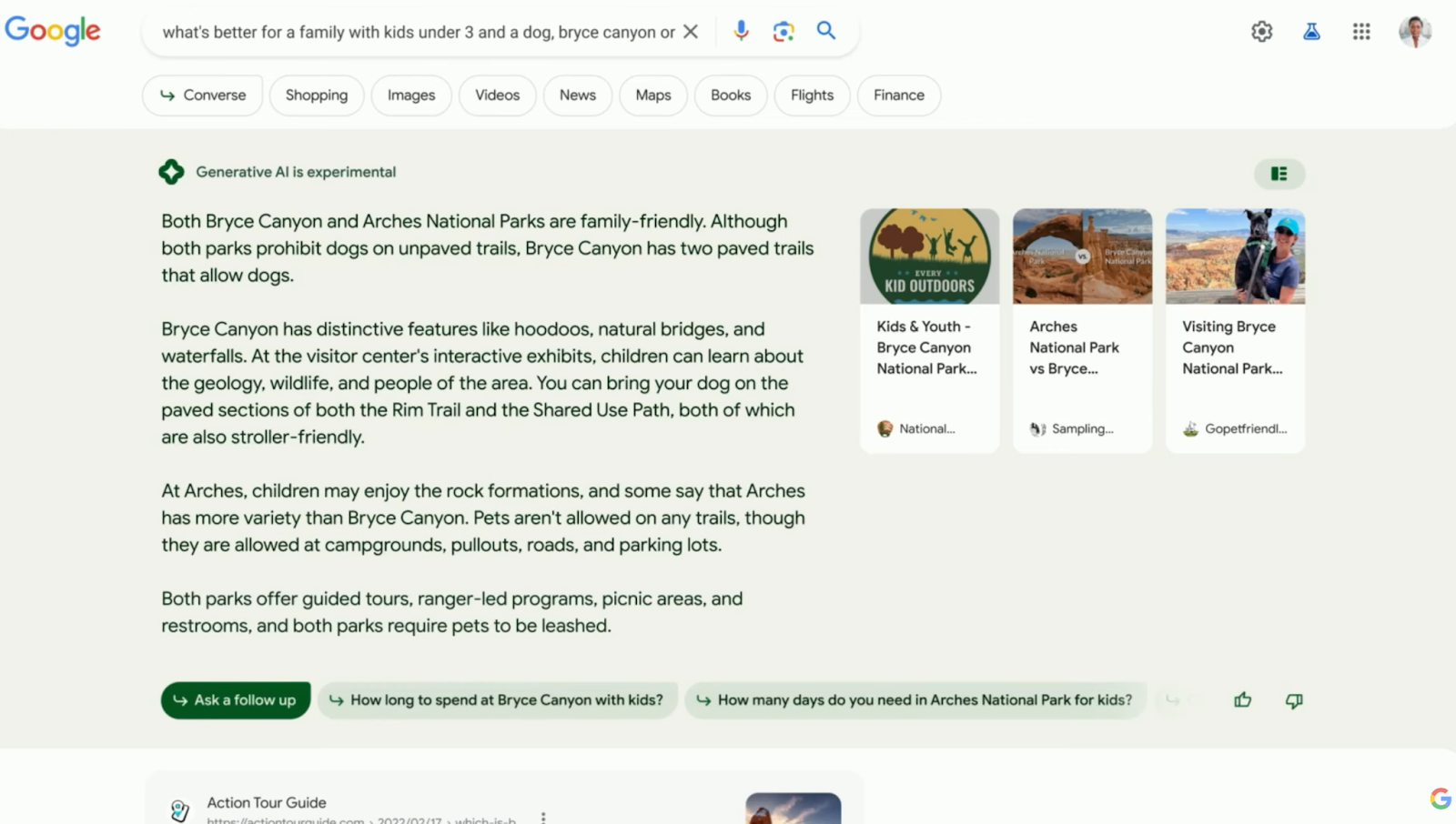

Da jeg så på spørsmålet og det påfølgende svaret, var det et par ting som slo meg helt fra starten av.

Det er ett spørsmål med to påvirkningsfaktorer. Hvilken park er bedre for en familie med a) barn under tre år og b) en hund. Bard klarer ikke bare å svare på spørsmålet, men også på en av påvirkningsfaktorene.

Søkeforespørselen er ute etter en anbefaling, men AI-en gir ingen. I stedet prøver den å ta tak i de påvirkende faktorene. Uten informasjon tilgjengelig om aktiviteter for barn under tre år, fusker Bard svaret ved å gjennomgå generiske barneaktiviteter. AI-en er i stand til å gi litt grunnleggende informasjon om tilgjengelighet for hunder.

Hvor mye svarte dette øyeblikksbildet på det opprinnelige søket? Svært lite, vil jeg påstå. Det har startet prosessen med å etablere filtre. For eksempel, hvis familien elsker hunden sin og ønsker en tur, så er det Bryce Canyon. Men hvis de elsker hunden sin og vil campe, så velger de Arches.

Bard-øyeblikksbildet er langt fra et definitivt svar og fungerer som et utgangspunkt for forskningsreisen. Dette betyr at når søkere bruker Bard, vil de raskere kunne finne artiklene som faktisk har innholdet de ønsker å lese, i stedet for å skumlese over.

Bard syntetiserer svarene sine basert på informasjonen i artiklene den leser, men den har ikke kapasitet til å ekstrapolere derfra. Og når AI faktisk har muligheten, hvor mange lesere vil iboende stole på en maskins anbefalinger om ferie- eller matdestinasjoner? Tross alt kreves det en kropp for å forstå verden .

Vi kunne diskutere publikumsverdi og målinger som rulledybde i detalj, men jeg er ikke sikker på om det er behov for det. Disse AI-genererte øyeblikksbildene er ikke nok til å erstatte en personlig anmeldelse av naturparker av høy kvalitet, og dette gjelder også andre aspekter av publiseringsverdenen. Personlige erfaringer vil trumfe faktamaskiner. Tross alt, hvor mange familier stimler sammen rundt Wikipedia på en kveld i stedet for den nyeste reality-TV-serien?

Så, hva betyr alt dette for utgivere? Utvikle seg eller dø, vil jeg påstå. Møt publikumsbehovene ved å lage innhold av høy kvalitet som AI rett og slett ikke har referanserammen til å produsere.