Il fut un temps où l'idée de donner des ordres ou de poser des questions à une machine et de recevoir une réponse relevait de la science-fiction. Eh bien, pour Plus de 110 millions de personnes rien qu'aux États-Unis, c'est leur cadeau quotidien. Selon Gartner, 30 % des recherches seront effectuées par la voix en 2020.

La voix est l'interface par défaut pour plus de Canalys prévoit qu'il existera 200 millions d'enceintes connectées d'ici fin 2019Mais la plupart des smartphones actuels intègrent également un assistant numérique permettant une interface vocale. La société d'études Juniper Research estime que… D'ici 2023, on comptera 8 milliards d'assistants vocaux numériques en serviceLa plupart de ces utilisations se feront via des smartphones, mais les téléviseurs intelligents, les objets connectés, les enceintes intelligentes et autres appareils IoT connaîtront également une forte croissance de leur utilisation grâce aux commandes vocales.

Le marché des assistants vocaux numériques est dominé par quatre grands acteurs :

Le marché des assistants vocaux numériques est dominé par quatre grands acteurs :

Twinword outil de recherche de mots clés Il propose également des filtres utiles pour trouver des idées de mots-clés. Vous pouvez filtrer les résultats par intention de recherche et par modèles de mots-clés, ce qui vous permettra de n'afficher que les questions contenant votre mot-clé principal.

Vous pouvez également prendre en compte l'extrait « Autres questions posées » dans la recherche Google pour découvrir d'autres opportunités de mots clés.

Si vous disposez d'un centre d'appels, d'un chat en direct ou d'un chatbot, exploitez les données de ces conversations pour identifier les questions les plus fréquemment posées.

Twinword outil de recherche de mots clés Il propose également des filtres utiles pour trouver des idées de mots-clés. Vous pouvez filtrer les résultats par intention de recherche et par modèles de mots-clés, ce qui vous permettra de n'afficher que les questions contenant votre mot-clé principal.

Vous pouvez également prendre en compte l'extrait « Autres questions posées » dans la recherche Google pour découvrir d'autres opportunités de mots clés.

Si vous disposez d'un centre d'appels, d'un chat en direct ou d'un chatbot, exploitez les données de ces conversations pour identifier les questions les plus fréquemment posées.

Les requêtes locales représentant une part importante de la recherche vocale, attendez-vous à de nombreuses demandes se terminant par « près de chez moi ». Par exemple : « Où trouver les meilleurs sushis près de chez moi ? » ou « Quelle est la meilleure salle de sport près de chez moi ? ». Comment optimiser son référencement ? Les entreprises locales doivent mettre à jour leurs informations sur des plateformes comme Yelp, des sites d'avis comme TripAdvisor et des services comme Kayak. Pour les éditeurs, les données structurées sont la solution.

Créez des actions Google ou des compétences Alexa pour permettre aux utilisateurs d'interagir avec votre contenu

Tous les principaux assistants vocaux numériques permettent la création d'applications vocales permettant aux utilisateurs d'interagir avec votre contenu via ces assistants.

Google va un peu plus loin et crée automatiquement des actions pour votre contenu En fonction des données structurées de votre site web, le propriétaire du site, tel qu'indiqué dans les données de Google Search Console, recevra un e-mail. Vous pourrez alors activer ou désactiver l'action.

Par exemple, Google créera une Action pour les podcasts à partir de leur flux RSS, permettant ainsi aux utilisateurs de trouver et d'écouter des épisodes sur leurs appareils via l'Assistant. Les guides pratiques, les FAQ et les recettes utilisent également le balisage de données structurées pour générer automatiquement des Actions.

Pour les éditeurs de presse, il faut déjà être référencé dans Google Actualités et utiliser AMP et les données structurées dans ses articles pour pouvoir générer automatiquement une Action.

Les éditeurs ont déjà commencé à nouer des partenariats avec Google pour développer des Actions spécialisées. Vogue a lancé une fonctionnalité en 2017 permettant aux utilisateurs de… interagir avec la publication dans Google Home pour obtenir plus d'informations sur certaines histoires, racontées par les auteurs eux-mêmes.

D'autres éditeurs, comme Bloomberg ou Le Washington Post, ont développé des compétences Alexa qui permettent aux utilisateurs d'écouter des résumés quotidiens des actualités les plus importantes du jour.

Le Daily Mail est allé encore plus loin, comme Ils ont mis leur édition quotidienne complète sur AlexaAlors que d'autres éditeurs enregistrent eux-mêmes l'audio, le Daily Mail utilise ici la fonction de synthèse vocale automatique d'Alexa. Autre différence : le Daily Mail réserve cette fonctionnalité à ses abonnés.

Créez des actions Google ou des compétences Alexa pour permettre aux utilisateurs d'interagir avec votre contenu

Tous les principaux assistants vocaux numériques permettent la création d'applications vocales permettant aux utilisateurs d'interagir avec votre contenu via ces assistants.

Google va un peu plus loin et crée automatiquement des actions pour votre contenu En fonction des données structurées de votre site web, le propriétaire du site, tel qu'indiqué dans les données de Google Search Console, recevra un e-mail. Vous pourrez alors activer ou désactiver l'action.

Par exemple, Google créera une Action pour les podcasts à partir de leur flux RSS, permettant ainsi aux utilisateurs de trouver et d'écouter des épisodes sur leurs appareils via l'Assistant. Les guides pratiques, les FAQ et les recettes utilisent également le balisage de données structurées pour générer automatiquement des Actions.

Pour les éditeurs de presse, il faut déjà être référencé dans Google Actualités et utiliser AMP et les données structurées dans ses articles pour pouvoir générer automatiquement une Action.

Les éditeurs ont déjà commencé à nouer des partenariats avec Google pour développer des Actions spécialisées. Vogue a lancé une fonctionnalité en 2017 permettant aux utilisateurs de… interagir avec la publication dans Google Home pour obtenir plus d'informations sur certaines histoires, racontées par les auteurs eux-mêmes.

D'autres éditeurs, comme Bloomberg ou Le Washington Post, ont développé des compétences Alexa qui permettent aux utilisateurs d'écouter des résumés quotidiens des actualités les plus importantes du jour.

Le Daily Mail est allé encore plus loin, comme Ils ont mis leur édition quotidienne complète sur AlexaAlors que d'autres éditeurs enregistrent eux-mêmes l'audio, le Daily Mail utilise ici la fonction de synthèse vocale automatique d'Alexa. Autre différence : le Daily Mail réserve cette fonctionnalité à ses abonnés.

Le marché des assistants vocaux numériques est dominé par quatre grands acteurs :

Le marché des assistants vocaux numériques est dominé par quatre grands acteurs :

- L'Assistant Google. Cet assistant numérique est installé par défaut sur tous les téléphones Android, au sein de l'application Google. Il utilise la recherche Google pour répondre à vos questions. D'autres services Google, comme YouTube ou Google Maps, sont également étroitement liés à l'Assistant. Les entreprises peuvent étendre les fonctionnalités de l'Assistant en développant des Actions. Ces Actions permettent d'interagir avec des appareils (« OK Google, éteins les lumières du salon ») ou avec n'importe quel service en ligne (« OK Google, donne-moi les titres de l'actualité du jour pour mon site web préféré »).

- Amazon Alexa. L'assistant vocal d'Amazon est surtout connu pour sa gamme d'enceintes connectées Echo. Mais il est en réalité disponible sur plus de 20 000 appareils, parmi lesquels des enceintes connectées, des objets connectés, des téléviseurs et même des voitures. Alexa permet également de créer des applications vocales grâce aux Skills Alexa. Amazon propose même des abonnements premium pour ces Skills , permettant ainsi aux développeurs de monétiser leur contenu en offrant davantage d'options de personnalisation ou une couverture plus détaillée. Alexa utilise Bing comme moteur de recherche.

- Apple Siri. Lancée en 2011 comme application iOS pour iPhone, elle est aujourd'hui un assistant vocal numérique à part entière, intégré à tous les produits Apple, notamment ses téléviseurs connectés, ses enceintes et ses objets connectés. Apple propose SiriKit, un outil permettant aux entreprises d'étendre leurs applications et d'offrir une interaction vocale via Siri. Le moteur de recherche par défaut de Siri est Google, mais il est possible de le configurer pour utiliser un autre moteur, comme DuckDuckGo ou Bing.

- Microsoft Cortana. L'assistant numérique de Microsoft est disponible nativement sur Windows, ainsi que sur les appareils Android et iOS en tant qu'application indépendante. Cortana semble avoir pris du retard en termes d'adoption par rapport à d'autres assistants numériques, et la stratégie de Microsoft semble privilégier l'intégration de Cortana à ces derniers plutôt que la concurrence . Microsoft autorise également le développement de Skills tierces pour Cortana, mais uniquement pour le marché américain pour le moment. Compte tenu de ce changement de stratégie, il est difficile de prévoir si les Skills Cortana seront un jour disponibles à plus grande échelle. Cortana utilise Bing comme moteur de recherche.

La recherche vocale n'est pas seulement réservée aux mobiles, elle fait partie intégrante de notre vie quotidienne

Les débuts de la recherche vocale ont été déclenchés par l'adoption croissante des téléphones mobiles. Google Now, l'ancienne version de l'Assistant, a été lancé en 2012 et Siri encore avant, en 2011. La donne a changé avec l'arrivée d'Alexa en 2014. L'assistant numérique s'est alors intégré à un appareil conçu pour rester à la maison. Les assistants numériques sont désormais intégrés à une vaste gamme d'appareils, des téléphones aux montres en passant par les téléviseurs et les voitures. On peut interagir avec eux dans de nombreuses situations. Mais notre façon d'interagir avec l'assistant est, bien sûr, radicalement différente de l'interface textuelle classique des moteurs de recherche.En quoi la recherche vocale diffère-t-elle de la recherche textuelle ?

- Des requêtes plus complexes et plus longues. La reconnaissance vocale a considérablement évolué ces dernières années et permet désormais des requêtes bien plus complexes qu'il y a quelques années. Cela incite l'utilisateur à employer un langage plus naturel pour ses requêtes et commandes.

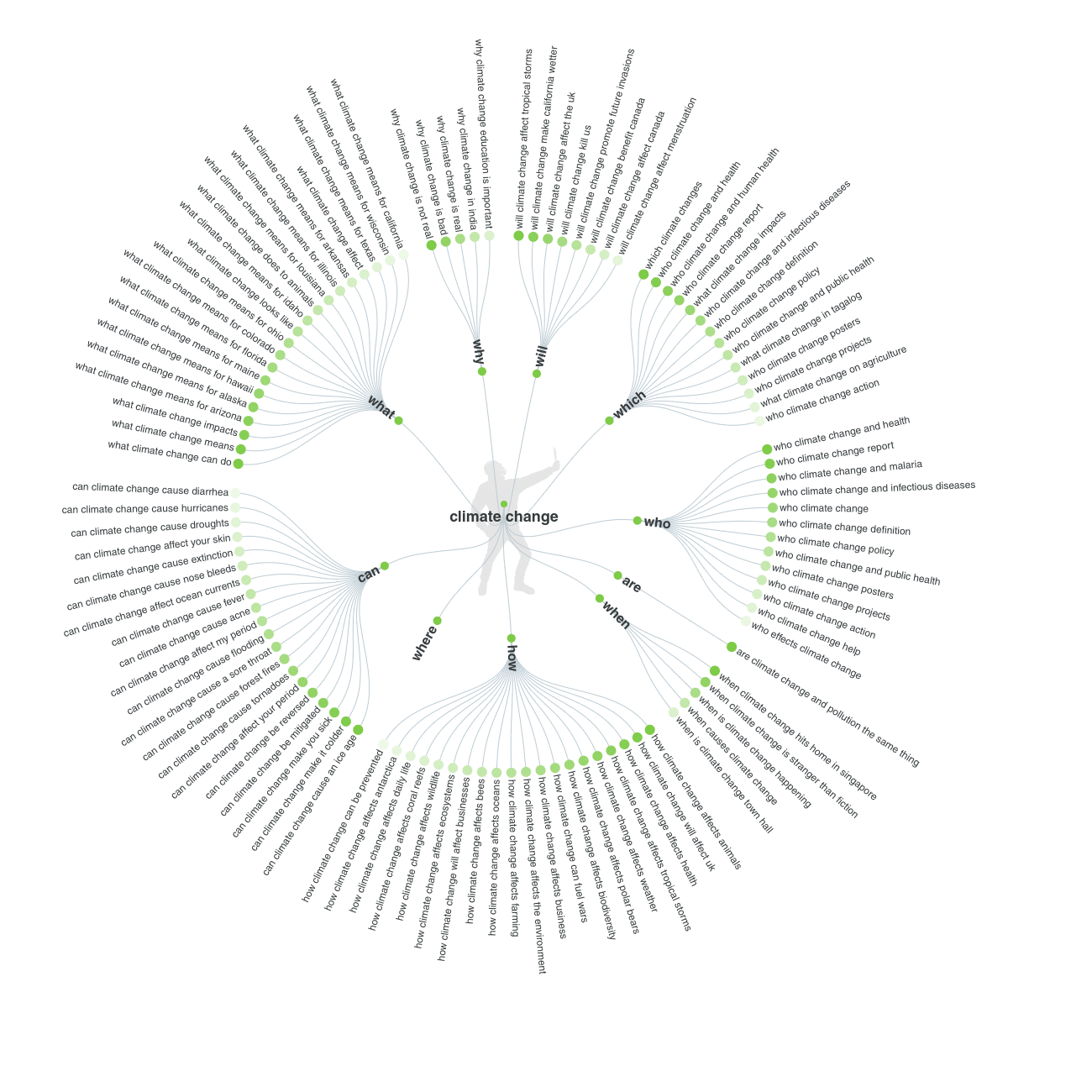

- D'autres questions. Selon une étude de seoClarity , plus de 15 % des recherches vocales commencent par « comment », « quoi », « où », « quand », « pourquoi » et « qui ». Cela s'explique par l'interface différente de celle d'un moteur de recherche textuel.

- Des réponses courtes et concises. Même si l'utilisateur peut utiliser des requêtes plus longues pour exprimer ce qu'il souhaite que l'assistant fasse ou recherche, il attend des réponses courtes et claires.

- Absence de hiérarchie visuelle de l'information. Nous avons l'habitude d'utiliser et de détecter des indices visuels pour organiser le contenu et mettre en évidence les points essentiels du message que nous souhaitons transmettre à l'utilisateur. Le contenu d'une page d'accueil doit être repensé pour les interfaces vocales afin d'identifier les éléments à mettre en avant et la manière de le faire, en l'absence des indices visuels fournis par un navigateur.

- Le gagnant rafle tout. Avec un moteur de recherche, on peut parcourir les résultats, et même si l'on atteint rarement la deuxième page, on peut cliquer sur un lien situé sous les trois premiers résultats. Dans une interface vocale, il n'y a pas de page de résultats permettant de choisir sa destination. L'assistant vocal ne renvoie qu'un seul résultat.

- Recherche locale. Sachant que 30 à 40 % des recherches mobiles sont des requêtes locales, on peut également s'attendre à ce qu'un pourcentage élevé des requêtes vocales demandent des résultats locaux.

Recherche de mots clés pour la recherche vocale

La principale différence entre la recherche de mots clés pour la voix et pour le texte réside dans l'utilisation d'un langage beaucoup plus naturel. Notre façon de parler est radicalement différente de notre façon d'écrire. Nous utilisons des expressions naturelles plutôt qu'une courte suite de mots clés. Pour identifier les mots-clés à cibler, nous devons utiliser un outil de recherche sémantique de mots-clés. Répondre au public C'est l'outil le plus couramment utilisé dans ce genre de cas. Saisissez votre mot-clé principal et vous obtiendrez une liste de questions contenant ce mot-clé. Les données sont d'abord présentées sous forme de graphique, ce qui est esthétique, mais peu utile. Heureusement, vous pouvez les télécharger au format CSV. Twinword outil de recherche de mots clés Il propose également des filtres utiles pour trouver des idées de mots-clés. Vous pouvez filtrer les résultats par intention de recherche et par modèles de mots-clés, ce qui vous permettra de n'afficher que les questions contenant votre mot-clé principal.

Vous pouvez également prendre en compte l'extrait « Autres questions posées » dans la recherche Google pour découvrir d'autres opportunités de mots clés.

Si vous disposez d'un centre d'appels, d'un chat en direct ou d'un chatbot, exploitez les données de ces conversations pour identifier les questions les plus fréquemment posées.

Twinword outil de recherche de mots clés Il propose également des filtres utiles pour trouver des idées de mots-clés. Vous pouvez filtrer les résultats par intention de recherche et par modèles de mots-clés, ce qui vous permettra de n'afficher que les questions contenant votre mot-clé principal.

Vous pouvez également prendre en compte l'extrait « Autres questions posées » dans la recherche Google pour découvrir d'autres opportunités de mots clés.

Si vous disposez d'un centre d'appels, d'un chat en direct ou d'un chatbot, exploitez les données de ces conversations pour identifier les questions les plus fréquemment posées.

requêtes « à proximité »

requêtes « à proximité »

Les requêtes locales représentant une part importante de la recherche vocale, attendez-vous à de nombreuses demandes se terminant par « près de chez moi ». Par exemple : « Où trouver les meilleurs sushis près de chez moi ? » ou « Quelle est la meilleure salle de sport près de chez moi ? ». Comment optimiser son référencement ? Les entreprises locales doivent mettre à jour leurs informations sur des plateformes comme Yelp, des sites d'avis comme TripAdvisor et des services comme Kayak. Pour les éditeurs, les données structurées sont la solution.

Comment optimiser votre contenu pour la recherche vocale

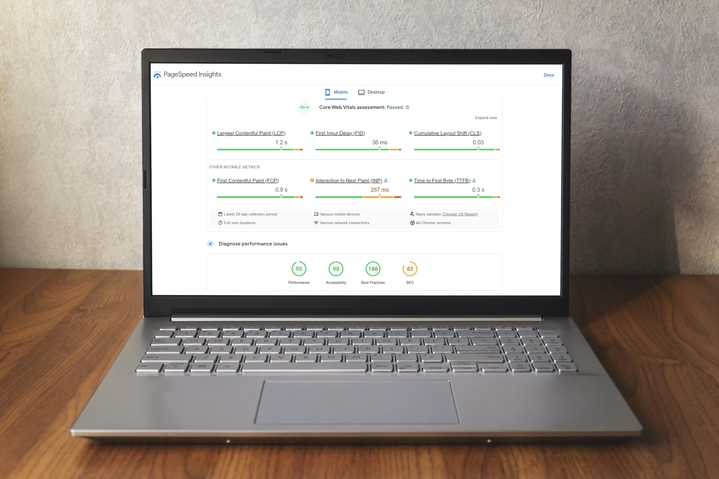

Optimisez votre site pour les appareils mobiles

La plupart des optimisations à apporter à votre site pour garantir un bon référencement mobile seront également bénéfiques pour votre positionnement dans la recherche vocale. La vitesse de chargement du site est un facteur primordial. Que l'interface soit vocale ou mobile, les utilisateurs s'attendent à des résultats rapides.Utilisez AMP et des données structurées

Les données structurées sont essentielles pour aider Google à mieux comprendre et analyser votre contenu, afin de mieux répondre aux questions de votre audience. Vous pouvez ainsi aider Google à identifier des personnes, des organisations, des événements, des recettes, des produits et des lieux. AMP signifie Accelerated Mobile Pages. Il s'agit d'un projet open source lancé par Google qui restreint les fonctionnalités des pages web afin d'en accélérer considérablement le chargement. AMP est souvent utilisé avec des données structurées, car c'est ce qui permet aux pages AMP d'apparaître dans les résultats enrichis des recherches. De plus, pour les éditeurs, l'affichage de leur contenu au format AMP avec des données structurées est l'une des.. Configuration requise pour créer une action pour Google Assistant. Il existe un schéma de données structurées appelé « speakable »Cette fonctionnalité, actuellement en version bêta, identifie les sections d'un article adaptées à la lecture vocale. Le contenu balisé avec ce schéma sera reconnu par l'Assistant Google comme pouvant être lu sur un appareil compatible. La source du contenu est alors indiquée et l'URL est envoyée à l'appareil mobile de l'utilisateur. Ce schéma de données structurées est uniquement disponible pour les utilisateurs anglophones aux États-Unis, via les éditeurs présents sur Google Actualités.Répondre aux questions des utilisateurs de manière concise

Selon une étude de BacklinkoEn général, un résultat de recherche vocale ne compte que 29 mots, tandis qu'une page de résultats de recherche vocale en contient 2 312. Cela n'a rien de contradictoire. Dans le premier cas, il s'agit de l'assistant numérique répondant à une question précise. Dans le second, le nombre de mots fait référence à la source de la réponse. On ignore si Google privilégie les contenus longs comme gage de qualité ou si, simplement, plus le contenu est dense, plus la page a de chances d'être utilisée comme réponse à une requête. Quoi qu'il en soit, ces deux statistiques combinées nous indiquent que nous devons réfléchir à la structure de notre contenu afin d'aborder les idées principales et les points clés dans des paragraphes courts, facilement compréhensibles par un assistant vocal.Rédigez un contenu facile à lire et à comprendre

Pour que votre contenu soit utilisé dans les interactions vocales, il doit être facile à lire et, surtout, facile à comprendre pour vos lecteurs. N'oubliez pas que les utilisateurs ne pourront pas s'appuyer sur des éléments visuels tels que les titres ou les graphiques pour mieux comprendre votre contenu. N'oubliez pas que la plupart des questions seront posées dans un langage naturel, comme lors d'une conversation. Gardez cela à l'esprit lors de la création de votre contenu et adoptez un style conversationnel pour répondre aux questions précises.Visez un classement élevé et des extraits mis en avant

Il s'agit d'une corrélation et non d'une causalité. Cependant, l'analyse de Backlinko sur les résultats de recherche vocale dans Google Assistant montre que plus de 75 % des résultats de recherche vocale proviennent des trois premières positions dans la SERP, et que 40 % proviennent d'un extrait optimisé. Ceci prouve une fois de plus que Google Assistant et les autres assistants vocaux numériques privilégieront les résultats faisant autorité afin de satisfaire la requête de l'utilisateur dès leur première réponse. Les extraits optimisés étant déjà des réponses courtes à des questions spécifiques, il est logique que l'Assistant les utilise. Cela signifie que vos efforts d'optimisation pour la recherche Google auront également un impact mesurable sur la façon dont votre contenu est utilisé par un assistant vocal numérique.Analyser et répondre à l'intention de l'utilisateur

Identifiez l'intention de l'utilisateur à laquelle vous répondez en proposant du contenu. La recherche vocale permet de répondre à trois intentions principales : obtenir des informations (« Qu'est-ce que c'est ? Comment faire ? »), se repérer (« Où est-ce ? ») et agir (« Réserver une table au restaurant, acheter des chaussures, consulter la liste des concerts du week-end »). L'Oréal a mis en œuvre une stratégie de contenu axée sur la réponse aux questions « Comment faire ? »Leurs recherches montrent que c'est ce que leurs utilisateurs recherchent lorsqu'ils utilisent la recherche vocale.Renforcez votre confiance et votre autorité

Comme nous l'avons vu, la recherche vocale est un jeu où le gagnant rafle tout. Un assistant vocal numérique n'affiche pas une liste de résultats, mais fournit directement une réponse parmi ceux disponibles. Ne pouvant proposer qu'un seul résultat, il est logique qu'il privilégie les résultats provenant de domaines à forte autorité, même s'ils ne figurent pas en tête de liste.Le référencement local est essentiel pour la recherche vocale

Un volume important de recherches vocales concerne les résultats locaux. Optimiser son référencement local ne consiste pas tant à produire du contenu bourré de mots-clés locaux qu'à maintenir une présence active et à jour sur certains services et annuaires. Par exemple, les entreprises locales devraient revendiquer leur fiche sur [nom de la plateforme/du service] Google My Business, Bing Places pour les entreprises et Apple Maps ConnectVous auriez alors un meilleur contrôle sur les informations recueillies par Google Assistant, Alexa, Cortana et Siri, qui utilisent également les données et les avis de Yelp. Les éditeurs (et les entreprises locales également) peuvent mettre en œuvre des données structurées pour mettre en évidence les éléments locaux de leur contenu, à l'instar de Yelp et Ticketmaster pour leurs avis et événements. Créez des actions Google ou des compétences Alexa pour permettre aux utilisateurs d'interagir avec votre contenu

Tous les principaux assistants vocaux numériques permettent la création d'applications vocales permettant aux utilisateurs d'interagir avec votre contenu via ces assistants.

Google va un peu plus loin et crée automatiquement des actions pour votre contenu En fonction des données structurées de votre site web, le propriétaire du site, tel qu'indiqué dans les données de Google Search Console, recevra un e-mail. Vous pourrez alors activer ou désactiver l'action.

Par exemple, Google créera une Action pour les podcasts à partir de leur flux RSS, permettant ainsi aux utilisateurs de trouver et d'écouter des épisodes sur leurs appareils via l'Assistant. Les guides pratiques, les FAQ et les recettes utilisent également le balisage de données structurées pour générer automatiquement des Actions.

Pour les éditeurs de presse, il faut déjà être référencé dans Google Actualités et utiliser AMP et les données structurées dans ses articles pour pouvoir générer automatiquement une Action.

Les éditeurs ont déjà commencé à nouer des partenariats avec Google pour développer des Actions spécialisées. Vogue a lancé une fonctionnalité en 2017 permettant aux utilisateurs de… interagir avec la publication dans Google Home pour obtenir plus d'informations sur certaines histoires, racontées par les auteurs eux-mêmes.

D'autres éditeurs, comme Bloomberg ou Le Washington Post, ont développé des compétences Alexa qui permettent aux utilisateurs d'écouter des résumés quotidiens des actualités les plus importantes du jour.

Le Daily Mail est allé encore plus loin, comme Ils ont mis leur édition quotidienne complète sur AlexaAlors que d'autres éditeurs enregistrent eux-mêmes l'audio, le Daily Mail utilise ici la fonction de synthèse vocale automatique d'Alexa. Autre différence : le Daily Mail réserve cette fonctionnalité à ses abonnés.

Créez des actions Google ou des compétences Alexa pour permettre aux utilisateurs d'interagir avec votre contenu

Tous les principaux assistants vocaux numériques permettent la création d'applications vocales permettant aux utilisateurs d'interagir avec votre contenu via ces assistants.

Google va un peu plus loin et crée automatiquement des actions pour votre contenu En fonction des données structurées de votre site web, le propriétaire du site, tel qu'indiqué dans les données de Google Search Console, recevra un e-mail. Vous pourrez alors activer ou désactiver l'action.

Par exemple, Google créera une Action pour les podcasts à partir de leur flux RSS, permettant ainsi aux utilisateurs de trouver et d'écouter des épisodes sur leurs appareils via l'Assistant. Les guides pratiques, les FAQ et les recettes utilisent également le balisage de données structurées pour générer automatiquement des Actions.

Pour les éditeurs de presse, il faut déjà être référencé dans Google Actualités et utiliser AMP et les données structurées dans ses articles pour pouvoir générer automatiquement une Action.

Les éditeurs ont déjà commencé à nouer des partenariats avec Google pour développer des Actions spécialisées. Vogue a lancé une fonctionnalité en 2017 permettant aux utilisateurs de… interagir avec la publication dans Google Home pour obtenir plus d'informations sur certaines histoires, racontées par les auteurs eux-mêmes.

D'autres éditeurs, comme Bloomberg ou Le Washington Post, ont développé des compétences Alexa qui permettent aux utilisateurs d'écouter des résumés quotidiens des actualités les plus importantes du jour.

Le Daily Mail est allé encore plus loin, comme Ils ont mis leur édition quotidienne complète sur AlexaAlors que d'autres éditeurs enregistrent eux-mêmes l'audio, le Daily Mail utilise ici la fonction de synthèse vocale automatique d'Alexa. Autre différence : le Daily Mail réserve cette fonctionnalité à ses abonnés.

Pouvez-vous analyser l'impact de la recherche vocale ?

La réponse courte est non. Pas encore, du moins. Même si Google affirme le contraire depuis au moins 2016 Ils souhaitent inclure l'analyse des recherches vocales dans Google Search Console, mais le fait est qu'à ce jour, il n'existe aucun moyen d'analyser les requêtes et les résultats de la recherche vocale. Plusieurs obstacles empêchent Google et d'autres fournisseurs d'analyse de proposer cette fonctionnalité :- Premièrement, les requêtes en langage naturel sont généralement plus longues que les requêtes par mots-clés. De plus, les utilisateurs formulent souvent la même requête en utilisant différents mots ou constructions de phrases. Il en résulte de nombreuses variations peu fréquentes pour une même requête, ce qui complique l'analyse et l'extraction d'informations pertinentes.

- Le second défi réside dans le fait que les requêtes de recherche vocale s'enchaînent souvent, comme dans une conversation. Par exemple, vous pouvez demander à un assistant vocal : « Qui est Stephen Curry ? ». L'assistant vous fournira un résumé des exploits de la star de la NBA. Vous pouvez ensuite lui demander : « Quelle est sa taille ? », et l'assistant comprendra que vous parlez de Stephen Curry. Le problème se complexifie lorsqu'on réalise que l'assistant pourrait répondre aux deux requêtes en utilisant deux sources de contenu différentes.

- Offrir un moyen de regrouper les requêtes similaires, tout en laissant aux analystes la liberté d'explorer ces variations afin de mieux comprendre le langage de l'utilisateur.

- Afficher les arborescences conversationnelles pour comprendre comment les utilisateurs naviguent dans l'information, quelles requêtes les maintiennent dans notre contenu et lesquelles aboutissent à une réponse provenant d'autres sites.