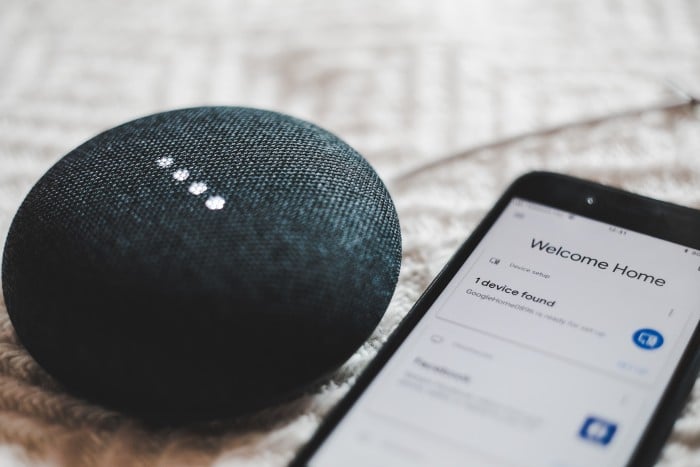

Hubo una época en la que dar órdenes o hacer preguntas a una máquina y recibir una respuesta era algo propio de un futuro de ciencia ficción. Bueno, para más de 110 millones de personas solo en EE. UUEse es su presente cotidiano. Según Gartner, 3El 0% de las búsquedas se realizarán mediante voz en 2020.

La voz es la interfaz predeterminada para más de Canalys predice que habrá 200 millones de altavoces inteligentes a finales de 2019Pero la mayoría de los teléfonos inteligentes actuales también incorporan algún tipo de asistente digital que permite una interfaz de voz. La empresa de investigación Juniper Research estima que Para 2023 habrá 8 mil millones de asistentes de voz digitales en usoLa mayoría de ellos estarán en teléfonos inteligentes, pero los televisores inteligentes, los wearables, los altavoces inteligentes y otros dispositivos IoT también experimentarán un crecimiento significativo en su uso a través de comandos de voz.

El mercado de asistentes de voz digitales está dominado por cuatro grandes actores:

El mercado de asistentes de voz digitales está dominado por cuatro grandes actores:

Palabras gemelas herramienta de investigación de palabras clave También incluye filtros útiles para extraer ideas de palabras clave. Puedes filtrar los resultados por intención de búsqueda y por patrones de palabras clave, lo que te permitirá ver solo las preguntas que incluyan tu palabra clave inicial.

También puedes tomar nota del fragmento “La gente también pregunta” en la Búsqueda de Google para descubrir más oportunidades de palabras clave.

Si tiene un centro de llamadas o una función de chat en vivo o chatbot, extraiga los datos de esas conversaciones para encontrar las preguntas más frecuentes.

Palabras gemelas herramienta de investigación de palabras clave También incluye filtros útiles para extraer ideas de palabras clave. Puedes filtrar los resultados por intención de búsqueda y por patrones de palabras clave, lo que te permitirá ver solo las preguntas que incluyan tu palabra clave inicial.

También puedes tomar nota del fragmento “La gente también pregunta” en la Búsqueda de Google para descubrir más oportunidades de palabras clave.

Si tiene un centro de llamadas o una función de chat en vivo o chatbot, extraiga los datos de esas conversaciones para encontrar las preguntas más frecuentes.

Dado que las consultas locales representan una gran parte de las búsquedas por voz, es de esperar que muchas terminen con la frase "cerca de mí". Por ejemplo, "¿cuál es el mejor sushi cerca de mí?" o "¿cuál es el mejor gimnasio cerca de mí?". ¿Cómo optimizar esto? Los negocios locales deberían tener sus datos actualizados en directorios como Yelp, sitios de reseñas como Tripadvisor y servicios como Kayak. Para los editores, los datos estructurados son la solución.

Crea Google Actions o Alexa Skills para permitir que los usuarios interactúen con tu contenido

Todos los principales asistentes de voz digitales permiten la creación de aplicaciones de voz para permitir que los usuarios interactúen con su contenido a través de los asistentes.

Google va un poco más allá y Crea automáticamente acciones para tu contenido Basado en los datos estructurados de tu sitio web. Cuando esto ocurra, el propietario de tu sitio, según lo especificado en los datos de Google Search Console, recibirá un correo electrónico. Luego, podrás reclamar tu acción o inhabilitarla.

Por ejemplo, Google creará una Acción para podcasts basada en su feed RSS que permitirá a los usuarios encontrar y reproducir episodios en sus dispositivos a través del Asistente. Las guías prácticas, las preguntas frecuentes y las recetas también utilizan marcado de datos estructurados para generar automáticamente Acciones.

Para los editores de noticias, deben estar incluidos en Google News y usar AMP y datos estructurados en sus artículos para poder generar automáticamente una Acción.

Los editores ya han comenzado a desarrollar colaboraciones con Google para desarrollar acciones especializadas. Vogue lanzó una función en 2017 donde los usuarios podían interactuar con la publicación en Google Home para obtener más información sobre ciertas historias, contadas por los propios escritores.

Otros editores, como Bloomberg o El Washington Post, Han desarrollado Alexa Skills que permiten a los usuarios escuchar resúmenes diarios de las noticias más importantes del día.

El Daily Mail fue un paso más allá, al afirmar: Ponen toda su edición diaria en AlexaMientras que otros editores graban el audio ellos mismos, en este caso, el Daily Mail utiliza las funciones automatizadas de conversión de texto a voz de Alexa. Otra diferencia es que, en este caso, el Daily Mail solo ofrece esta función a sus suscriptores actuales.

Crea Google Actions o Alexa Skills para permitir que los usuarios interactúen con tu contenido

Todos los principales asistentes de voz digitales permiten la creación de aplicaciones de voz para permitir que los usuarios interactúen con su contenido a través de los asistentes.

Google va un poco más allá y Crea automáticamente acciones para tu contenido Basado en los datos estructurados de tu sitio web. Cuando esto ocurra, el propietario de tu sitio, según lo especificado en los datos de Google Search Console, recibirá un correo electrónico. Luego, podrás reclamar tu acción o inhabilitarla.

Por ejemplo, Google creará una Acción para podcasts basada en su feed RSS que permitirá a los usuarios encontrar y reproducir episodios en sus dispositivos a través del Asistente. Las guías prácticas, las preguntas frecuentes y las recetas también utilizan marcado de datos estructurados para generar automáticamente Acciones.

Para los editores de noticias, deben estar incluidos en Google News y usar AMP y datos estructurados en sus artículos para poder generar automáticamente una Acción.

Los editores ya han comenzado a desarrollar colaboraciones con Google para desarrollar acciones especializadas. Vogue lanzó una función en 2017 donde los usuarios podían interactuar con la publicación en Google Home para obtener más información sobre ciertas historias, contadas por los propios escritores.

Otros editores, como Bloomberg o El Washington Post, Han desarrollado Alexa Skills que permiten a los usuarios escuchar resúmenes diarios de las noticias más importantes del día.

El Daily Mail fue un paso más allá, al afirmar: Ponen toda su edición diaria en AlexaMientras que otros editores graban el audio ellos mismos, en este caso, el Daily Mail utiliza las funciones automatizadas de conversión de texto a voz de Alexa. Otra diferencia es que, en este caso, el Daily Mail solo ofrece esta función a sus suscriptores actuales.

El mercado de asistentes de voz digitales está dominado por cuatro grandes actores:

El mercado de asistentes de voz digitales está dominado por cuatro grandes actores:

- Asistente de Google. Este asistente digital viene instalado en todos los teléfonos Android como parte de la aplicación de Google. Por supuesto, utiliza la búsqueda de Google para responder a tus consultas. Otras propiedades de Google, como YouTube o Google Maps, también están estrechamente vinculadas al asistente. Las empresas pueden ampliar las capacidades del Asistente desarrollando Acciones. Estas Acciones pueden usarse para interactuar con hardware ("Ok Google, apaga las luces del salón") o con cualquier otro servicio en línea ("Ok Google, dame los titulares de hoy de mi sitio web favorito").

- Amazon Alexa. El asistente digital de Amazon está disponible principalmente en la línea de altavoces inteligentes Echo. Pero, de hecho, está disponible en más de 20.000 dispositivos, incluyendo no solo altavoces inteligentes o wearables, sino también televisores e incluso coches. Alexa también permite la creación de aplicaciones de voz a través de Alexa Skills. Amazon incluso ofrece suscripciones premium para Skills , lo que permite a los editores rentabilizar sus esfuerzos ofreciendo más opciones de personalización o una cobertura más detallada. Alexa utiliza Bing como motor de búsqueda.

- Apple Siri. Lo que empezó en 2011 como una app de iOS para iPhone es ahora un asistente de voz digital completo integrado en todos los productos Apple, incluyendo su línea de televisores inteligentes, altavoces y wearables. Apple ofrece SiriKit para que las empresas puedan ampliar sus apps y permitir la interacción por voz a través de Siri. El motor de búsqueda predeterminado que utiliza Siri es Google, aunque se puede configurar para usar un motor de búsqueda diferente, como DuckDuckGo o Bing.

- Microsoft Cortana. El asistente digital de Microsoft está disponible de forma nativa en Windows y como aplicación independiente en dispositivos Android e iOS. Cortana parece haber sufrido una recesión en su adopción en comparación con otros asistentes digitales, y la estrategia de Microsoft parece ser integrarla con otros asistentes digitales en lugar de competir con ellos . Microsoft también permite el desarrollo de habilidades de terceros para Cortana, pero por ahora solo para el mercado estadounidense. Dado su cambio de estrategia, no está claro si las habilidades de Cortana estarán disponibles de forma más generalizada. Cortana utiliza Bing como motor de búsqueda.

La búsqueda por voz no es sólo para dispositivos móviles, es para nuestra vida cotidiana

Las primeras etapas de la búsqueda por voz se vieron impulsadas por la creciente adopción de teléfonos móviles. Google Now, la versión anterior del Asistente, se lanzó en 2012, y Siri incluso antes, en 2011. Esto cambió con la llegada de Alexa en 2014. El asistente digital ahora residía en un dispositivo diseñado para no salir de casa. Los asistentes digitales ahora están integrados en una amplia gama de dispositivos, desde teléfonos y relojes hasta televisores y coches. Las personas pueden interactuar con ellos en una mayor variedad de situaciones. Pero la forma en que interactuamos con el asistente es, por supuesto, radicalmente diferente de la interfaz de texto habitual de los motores de búsqueda.En qué se diferencia la búsqueda por voz de la búsqueda basada en texto

- Consultas más complejas y largas. El reconocimiento de voz ha evolucionado mucho en los últimos años y ahora permite consultas más complejas que hace tan solo unos años. Esto impulsa al usuario a utilizar un lenguaje más natural para sus consultas y comandos.

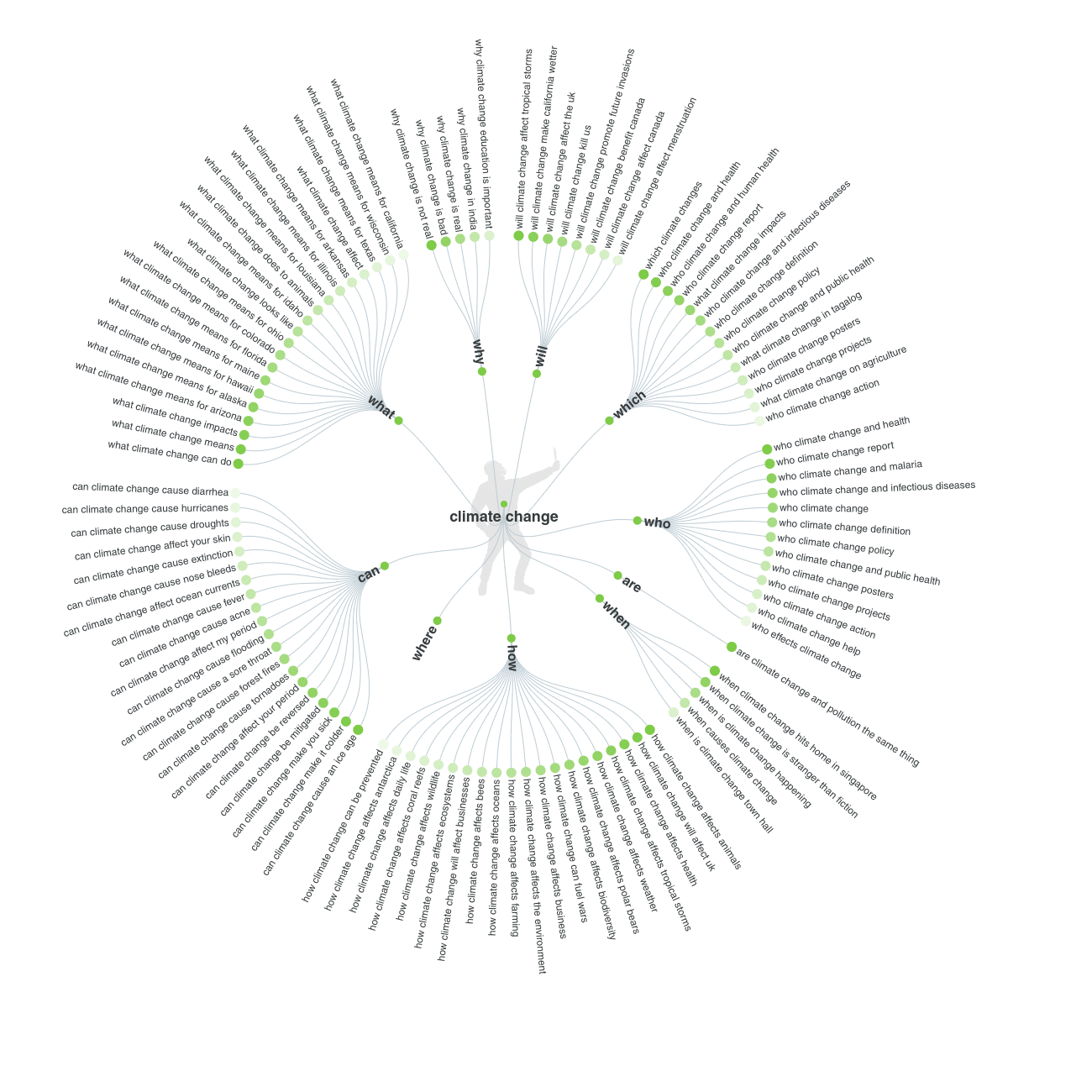

- Más preguntas. Según un estudio de seoClarity , más del 15 % de las búsquedas por voz comienzan con cómo, qué, dónde, cuándo, por qué y quién. Esto se debe a la interfaz diferente a la de un motor de búsqueda de texto.

- Respuestas breves y concisas. Aunque el usuario utilice consultas más largas para expresar lo que desea que el asistente haga o busque, se esperan respuestas breves y claras.

- No existe una jerarquía visual de la información. Estamos acostumbrados a emplear y detectar señales visuales para organizar el contenido y destacar los aspectos más importantes de lo que queremos transmitir al usuario. El contenido de una página de destino debe replantearse para interfaces de solo voz a fin de identificar qué destacar y cómo hacerlo sin las señales visuales que permite un navegador.

- El ganador se lo lleva todo. Al usar un motor de búsqueda, puedes revisar rápidamente los resultados y, aunque rara vez llegues a la segunda página de la SERP, es muy posible que hagas clic en un enlace debajo de los tres primeros resultados. En una interfaz de voz, los usuarios no acceden a una página de resultados donde puedan elegir adónde ir. El asistente digital solo mostrará un resultado.

- Búsqueda local. Considerando que entre el 30% y el 40% de las búsquedas móviles son consultas locales, también podemos esperar que un alto porcentaje de consultas en la búsqueda por voz soliciten resultados locales.

Investigación de palabras clave para búsqueda por voz

La principal diferencia al investigar palabras clave para voz en lugar de texto es que se utilizan palabras clave de lenguaje mucho más natural. Hablamos de forma completamente distinta a como escribimos. Usamos frases naturales en lugar de una secuencia corta de palabras clave. Para descubrir qué palabras clave utilizar, necesitamos utilizar una herramienta de investigación de palabras clave semánticas. Responder al público Es la herramienta más utilizada en estos casos. Introduce tu palabra clave inicial y obtendrás una lista de preguntas con esa palabra clave. Los datos se presentan primero en un gráfico, que es atractivo, pero no muy útil. Por suerte, puedes descargar los datos en un práctico archivo CSV. Palabras gemelas herramienta de investigación de palabras clave También incluye filtros útiles para extraer ideas de palabras clave. Puedes filtrar los resultados por intención de búsqueda y por patrones de palabras clave, lo que te permitirá ver solo las preguntas que incluyan tu palabra clave inicial.

También puedes tomar nota del fragmento “La gente también pregunta” en la Búsqueda de Google para descubrir más oportunidades de palabras clave.

Si tiene un centro de llamadas o una función de chat en vivo o chatbot, extraiga los datos de esas conversaciones para encontrar las preguntas más frecuentes.

Palabras gemelas herramienta de investigación de palabras clave También incluye filtros útiles para extraer ideas de palabras clave. Puedes filtrar los resultados por intención de búsqueda y por patrones de palabras clave, lo que te permitirá ver solo las preguntas que incluyan tu palabra clave inicial.

También puedes tomar nota del fragmento “La gente también pregunta” en la Búsqueda de Google para descubrir más oportunidades de palabras clave.

Si tiene un centro de llamadas o una función de chat en vivo o chatbot, extraiga los datos de esas conversaciones para encontrar las preguntas más frecuentes.

Consultas 'Cerca de mí'

Consultas 'Cerca de mí'

Dado que las consultas locales representan una gran parte de las búsquedas por voz, es de esperar que muchas terminen con la frase "cerca de mí". Por ejemplo, "¿cuál es el mejor sushi cerca de mí?" o "¿cuál es el mejor gimnasio cerca de mí?". ¿Cómo optimizar esto? Los negocios locales deberían tener sus datos actualizados en directorios como Yelp, sitios de reseñas como Tripadvisor y servicios como Kayak. Para los editores, los datos estructurados son la solución.

Cómo optimizar tu contenido para la búsqueda por voz

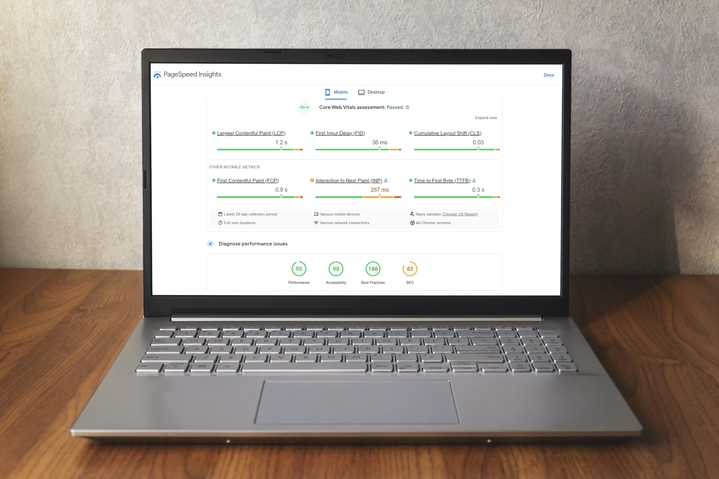

Optimice su sitio para dispositivos móviles

La mayoría de las optimizaciones que deberías implementar en tu sitio web para asegurar un buen rendimiento en las búsquedas móviles también beneficiarán tu posicionamiento en las búsquedas por voz. Uno de los factores más importantes es la velocidad del sitio web. Ya sea que la interfaz sea de voz o móvil, los usuarios esperan resultados rápidos.Utilice AMP y datos estructurados

Los datos estructurados son clave para que Google comprenda y analice mejor tu contenido y pueda ofrecer a tu audiencia las respuestas que busca. Puedes ayudar a Google a identificar personas, organizaciones, eventos, recetas, productos y lugares. AMP significa Páginas Móviles Aceleradas. Es un proyecto de código abierto de Google que restringe la funcionalidad de las páginas web para aumentar drásticamente su velocidad. AMP se utiliza a menudo con datos estructurados, ya que esto permite que las páginas AMP aparezcan en resultados enriquecidos en la página de resultados de búsqueda. Además, para los editores, mostrar su contenido a través del formato AMP con datos estructurados es una de las Requisitos para crear una acción para el Asistente de Google. Existe un esquema de datos estructurado llamado “hablable”, actualmente en fase beta, que identifica las secciones de un artículo aptas para la reproducción de texto a voz. El Asistente de Google identificará el contenido etiquetado con este esquema como contenido legible a través de un dispositivo compatible con el Asistente de Google. El contenido se atribuye a la fuente y la URL se envía al dispositivo móvil del usuario. Este esquema de datos estructurados solo está disponible para usuarios de habla inglesa en EE. UU., a través de editores que están en Google News.Responda las preguntas de los usuarios de forma concisa

Según una investigación de BacklinkoEl resultado típico de una búsqueda por voz tiene solo 29 palabras, pero el recuento de palabras de una página de resultados de búsqueda por voz es de 2312. Esto no es contradictorio. En el primer caso, se trata de que el asistente digital responde a una pregunta o consulta específica. En el segundo, el recuento de palabras se refiere a la fuente de la respuesta. No está claro si Google prioriza el contenido extenso como una marca de calidad o si simplemente un mayor contenido implica mayores probabilidades de que una página se utilice como respuesta a una consulta. De cualquier manera, lo que estas dos estadísticas combinadas nos dicen es que debemos pensar en la estructura de nuestro contenido para abordar las ideas principales y los puntos clave en párrafos cortos que un asistente de voz pueda captar.Escribe contenido que sea fácil de leer y comprender

Si quieres que tu contenido se use en la interacción de voz, debe ser fácil de leer y, sobre todo, fácil de entender para tus lectores. Recuerda que los usuarios no podrán usar señales o elementos visuales para comprender mejor tu contenido, como titulares o gráficos. Recuerda que la mayoría de las consultas se realizarán con un lenguaje natural, como si estuvieran manteniendo una conversación. Tenlo en cuenta al desarrollar tu contenido y escribe con un tono conversacional al responder preguntas específicas.Apunta a un alto rango y a fragmentos destacados

Se trata de un caso de correlación, no de causalidad. Sin embargo, existe evidencia, analizada por Backlinko en su investigación sobre resultados de voz en el Asistente de Google, de que más del 75 % de los resultados de búsqueda por voz provienen de las tres primeras posiciones de la SERP, y que el 40 % proviene de un fragmento destacado. Esta es solo una prueba más de que Google Assistant y otros asistentes de voz digitales favorecerán resultados de gran autoridad para garantizar que satisfagan la consulta del usuario en su primera respuesta. Como los fragmentos destacados ya son respuestas breves a preguntas específicas, tiene sentido que el Asistente los utilice. Esto significa que sus esfuerzos de optimización para la búsqueda de Google también tendrán un impacto medible en cómo un asistente de voz digital utiliza su contenido.Analizar y responder a la intención del usuario

Identifica la intención del usuario para la que proporcionas contenido. La búsqueda por voz puede responder a tres intenciones principales. La primera es obtener información: ¿qué es esto? ¿Cómo lo hago? La segunda es navegar: ¿dónde está esto? Y la tercera y última intención es actuar: reservar una mesa en un restaurante, comprar unos zapatos, obtener una lista de todos los conciertos de música que se celebrarán este fin de semana. L'Oréal ha estado implementando una estrategia de contenido basada en responder preguntas de “Cómo”Su investigación muestra que eso es lo que buscan sus usuarios cuando utilizan consultas de búsqueda por voz.Construya su confianza y autoridad

Como vimos, la búsqueda por voz es un juego donde el ganador se lo lleva todo. Un asistente de voz digital no mostrará una lista de resultados, sino que proporcionará directamente una respuesta de esos resultados de búsqueda. Dado que solo pueden proporcionar un resultado, es lógico que tiendan a favorecer los resultados de dominios con alta autoridad, aunque no sean el primer resultado para esa consulta.El SEO local es clave para la búsqueda por voz

Un gran volumen de consultas de búsqueda por voz se dirige a resultados locales. Optimizar las consultas SEO locales no se trata tanto de generar contenido con palabras clave locales como de mantener una presencia sólida y actualizada en ciertos servicios y directorios. Por ejemplo, las empresas locales deberían reclamar su presencia en Google Mi Negocio, Bing Places para empresas y Conexión de Apple MapsDe esta forma, podrás tener un mayor control sobre la información obtenida por Google Assistant, Alexa, Cortana y Siri, que también utiliza datos y reseñas de Yelp. Los editores (y las empresas locales también) pueden implementar datos estructurados para resaltar elementos locales en su contenido, tal como lo hacen Yelp y Ticketmaster con sus reseñas y eventos. Crea Google Actions o Alexa Skills para permitir que los usuarios interactúen con tu contenido

Todos los principales asistentes de voz digitales permiten la creación de aplicaciones de voz para permitir que los usuarios interactúen con su contenido a través de los asistentes.

Google va un poco más allá y Crea automáticamente acciones para tu contenido Basado en los datos estructurados de tu sitio web. Cuando esto ocurra, el propietario de tu sitio, según lo especificado en los datos de Google Search Console, recibirá un correo electrónico. Luego, podrás reclamar tu acción o inhabilitarla.

Por ejemplo, Google creará una Acción para podcasts basada en su feed RSS que permitirá a los usuarios encontrar y reproducir episodios en sus dispositivos a través del Asistente. Las guías prácticas, las preguntas frecuentes y las recetas también utilizan marcado de datos estructurados para generar automáticamente Acciones.

Para los editores de noticias, deben estar incluidos en Google News y usar AMP y datos estructurados en sus artículos para poder generar automáticamente una Acción.

Los editores ya han comenzado a desarrollar colaboraciones con Google para desarrollar acciones especializadas. Vogue lanzó una función en 2017 donde los usuarios podían interactuar con la publicación en Google Home para obtener más información sobre ciertas historias, contadas por los propios escritores.

Otros editores, como Bloomberg o El Washington Post, Han desarrollado Alexa Skills que permiten a los usuarios escuchar resúmenes diarios de las noticias más importantes del día.

El Daily Mail fue un paso más allá, al afirmar: Ponen toda su edición diaria en AlexaMientras que otros editores graban el audio ellos mismos, en este caso, el Daily Mail utiliza las funciones automatizadas de conversión de texto a voz de Alexa. Otra diferencia es que, en este caso, el Daily Mail solo ofrece esta función a sus suscriptores actuales.

Crea Google Actions o Alexa Skills para permitir que los usuarios interactúen con tu contenido

Todos los principales asistentes de voz digitales permiten la creación de aplicaciones de voz para permitir que los usuarios interactúen con su contenido a través de los asistentes.

Google va un poco más allá y Crea automáticamente acciones para tu contenido Basado en los datos estructurados de tu sitio web. Cuando esto ocurra, el propietario de tu sitio, según lo especificado en los datos de Google Search Console, recibirá un correo electrónico. Luego, podrás reclamar tu acción o inhabilitarla.

Por ejemplo, Google creará una Acción para podcasts basada en su feed RSS que permitirá a los usuarios encontrar y reproducir episodios en sus dispositivos a través del Asistente. Las guías prácticas, las preguntas frecuentes y las recetas también utilizan marcado de datos estructurados para generar automáticamente Acciones.

Para los editores de noticias, deben estar incluidos en Google News y usar AMP y datos estructurados en sus artículos para poder generar automáticamente una Acción.

Los editores ya han comenzado a desarrollar colaboraciones con Google para desarrollar acciones especializadas. Vogue lanzó una función en 2017 donde los usuarios podían interactuar con la publicación en Google Home para obtener más información sobre ciertas historias, contadas por los propios escritores.

Otros editores, como Bloomberg o El Washington Post, Han desarrollado Alexa Skills que permiten a los usuarios escuchar resúmenes diarios de las noticias más importantes del día.

El Daily Mail fue un paso más allá, al afirmar: Ponen toda su edición diaria en AlexaMientras que otros editores graban el audio ellos mismos, en este caso, el Daily Mail utiliza las funciones automatizadas de conversión de texto a voz de Alexa. Otra diferencia es que, en este caso, el Daily Mail solo ofrece esta función a sus suscriptores actuales.

¿Puedes analizar el impacto de la búsqueda por voz?

La respuesta corta es no. Al menos todavía no. Aunque Google ha estado diciendo desde al menos 2016 que quieren incluir análisis de búsqueda por voz en Google Search Console, lo cierto es que, a día de hoy, no hay forma de analizar las consultas y los resultados de la búsqueda por voz. Existen algunos desafíos que impiden que Google y otros proveedores de análisis ofrezcan esta función:- La primera es que las consultas en lenguaje natural tienden a ser más largas que las consultas basadas en palabras clave. Además, se formulará la misma consulta utilizando diferentes palabras o construcciones de oraciones. Esto significa que la misma consulta tendrá muchas variaciones de bajo volumen, lo que dificulta el análisis y la extracción de información significativa.

- El segundo desafío es que las consultas de búsqueda por voz suelen estar encadenadas, como si formaran parte de una conversación. Por ejemplo, puedes preguntarle a un asistente de voz digital: "¿Quién es Stephen Curry?". El asistente te devolverá un resumen de los logros de la estrella de la NBA. Puedes preguntarle "¿Cuánto mide?" y el asistente sabrá que te refieres a Stephen Curry. El problema se complica cuando te das cuenta de que el asistente podría responder ambas consultas utilizando dos fuentes de contenido diferentes.

- Proporcionar una manera de agrupar consultas similares y, al mismo tiempo, dar a los analistas la libertad de explorar cuáles son esas variaciones, para comprender mejor el lenguaje del usuario.

- Mostrar árboles conversacionales para comprender cómo los usuarios navegan por la información y qué consultas los mantienen en nuestro contenido y cuáles dan como resultado que la consulta se responda con contenido de otros sitios.