La désinformation en ligne a des conséquences concrètes importantes, telles que des épidémies de rougeole et l'incitation aux meurtres de masse racistes . La désinformation en ligne peut également avoir des conséquences politiques.

Le problème de la désinformation et de la propagande trompeuse des utilisateurs de médias sociaux était grave en 2016, s'est poursuivi sans relâche en 2018 et devrait être encore plus grave lors du prochain cycle électoral de 2020 aux États-Unis

La plupart des gens pensent qu'ils peuvent détecter les efforts de tromperie en ligne, mais dans nos recherches récentes, moins de 20 % des participants ont en fait été en mesure d'identifier correctement le contenu intentionnellement trompeur. Les autres n'ont pas fait mieux qu'ils ne l'auraient fait s'ils avaient lancé une pièce pour décider ce qui était réel et ce qui ne l'était pas.

Les psychologiques et neurologiques montrent que les gens sont plus susceptibles de croire et de prêter attention aux informations qui correspondent à leurs opinions politiques, qu'elles soient vraies ou non. Ils se méfient et ignorent les messages qui ne correspondent pas à ce qu'ils pensent déjà.

En tant que chercheurs en systèmes d'information, nous voulions trouver des moyens d'aider les gens à discerner les informations vraies et fausses - qu'elles confirment ou non ce qu'ils pensaient auparavant, et même lorsqu'elles provenaient de sources inconnues. La vérification des faits individuels des articles est un bon début, mais cela peut prendre des jours, donc ce n'est généralement pas assez rapide pour suivre la vitesse à laquelle les nouvelles voyagent .

Nous avons cherché à découvrir la manière la plus efficace de présenter au public le niveau d'exactitude d'une source, c'est-à-dire la manière qui aurait le plus d'effet sur la réduction de la croyance en la désinformation et de sa diffusion.

Avis d'experts ou d'utilisateurs ?

Une alternative est une évaluation de la source basée sur les articles passés qui est jointe à chaque nouvel article au fur et à mesure de sa publication, un peu comme les évaluations des vendeurs Amazon ou eBay.

Les évaluations les plus utiles sont celles qu'une personne peut utiliser au moment le plus pertinent – en s'informant sur les expériences des acheteurs précédents avec un vendeur lorsqu'ils envisagent d'effectuer un achat en ligne, par exemple.

Quand il s'agit de faits, cependant, il y a une autre ride. Les évaluations du commerce électronique sont généralement effectuées par des utilisateurs réguliers, des personnes ayant une connaissance directe de l'utilisation de l'article ou du service.

La vérification des faits, en revanche, est traditionnellement effectuée par des experts comme PolitiFact car peu de gens ont les connaissances de première main pour évaluer les nouvelles. En comparant les notes générées par les utilisateurs et les notes générées par les experts, nous avons constaté que différents mécanismes de notation influencent les utilisateurs de différentes manières .

Nous avons mené deux expériences en ligne, avec un total de 889 participants. Chaque personne a vu un groupe de titres, certains étiquetés avec des évaluations de précision d'experts, d'autres étiquetés avec des évaluations d'autres utilisateurs et le reste sans aucune évaluation de précision.

Nous avons demandé aux participants dans quelle mesure ils croyaient à chaque titre et s'ils liraient l'article, l'aimeraient, le commenteraient ou le partageraient.

Kim et al. , CC BY-ND

Kim et al. , CC BY-ND

Les notes d'experts des sources d'information avaient des effets plus forts sur la croyance que les notes des utilisateurs non experts, et les effets étaient encore plus forts lorsque la note était faible, ce qui suggère que la source était probablement inexacte. Ces sources inexactes et mal notées sont les coupables habituels de la diffusion de la désinformation, donc notre découverte suggère que les évaluations des experts sont encore plus puissantes lorsque les utilisateurs en ont le plus besoin.

La croyance des répondants dans un titre a influencé la mesure dans laquelle ils s'y intéresseraient : plus ils croyaient qu'un article était vrai, plus ils étaient susceptibles de lire, aimer, commenter ou partager l'article.

Ces résultats nous indiquent qu'aider les utilisateurs à se méfier des informations inexactes au moment où ils les rencontrent peut contribuer à freiner la propagation de la désinformation.

Effets d'entraînement

Nous avons également constaté que l'application de notes de source à certains titres rendait nos répondants plus sceptiques d'autres titres sans notes.

Kim et al.

Cette découverte nous a surpris, car d'autres méthodes d'avertissement des lecteurs, telles que l'ajout d'avis uniquement aux titres douteux, ont rendu les utilisateurs moins sceptiques vis-à-vis des titres sans étiquette . Cette différence est d'autant plus remarquable que le drapeau d'avertissement de Facebook a eu peu d'influence sur les utilisateurs et a finalement été supprimé . Peut-être que les évaluations des sources peuvent fournir ce que le drapeau de Facebook n'a pas pu fournir.

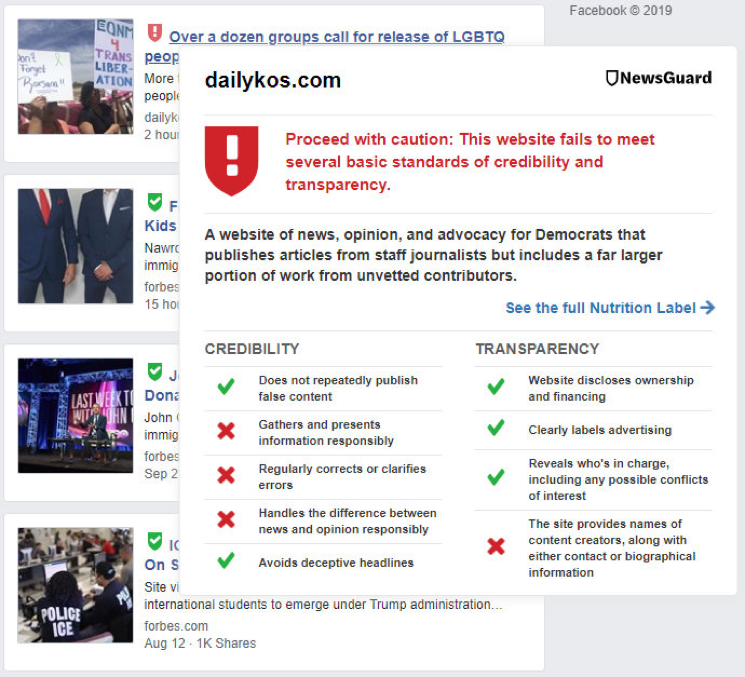

Capture d'écran par Antino Kim

Ce que nous avons appris indique que les évaluations d'experts fournies par des entreprises comme NewsGuard sont probablement plus efficaces pour réduire la propagation de la propagande et de la désinformation que de demander aux utilisateurs d'évaluer eux-mêmes la fiabilité et l'exactitude des sources d'information. Cela a du sens, étant donné que, comme nous l'avons dit sur Buzzfeed, " le crowdsourcing 'news' était ce qui nous a mis dans ce gâchis en premier lieu ."

Antino Kim , professeur adjoint d'opérations et de technologies décisionnelles, Université de l'Indiana ; Alan R. Dennis , professeur de systèmes Internet, Université de l'Indiana ; Patricia L. Moravec , professeure adjointe de gestion de l'information, des risques et des opérations, Université du Texas à Austin , et Randall K. Minas , professeur agrégé de gestion des technologies de l'information, Université d'Hawaï

Cet article est republié de The Conversation sous une licence Creative Commons. Lire l' article d'origine .