Editoras que investem em aparecer no topo dos resultados de busca do Google já entendem a importância do SEO. Um aspecto importante e potencialmente negligenciado do SEO para editoras maiores, no entanto, é o orçamento de rastreamento do Google.

Os orçamentos de rastreamento do Google ajudam a determinar em que medida os artigos aparecem nos resultados de pesquisa.

Compreender os orçamentos de rastreamento é um passo crucial para garantir que as metas de SEO sejam atingidas e que o conteúdo seja visualizado. Verificar se a infraestrutura técnica de um site está funcionando corretamente significa que a interface do usuário (front-end) provavelmente refletirá esse desempenho.

Neste artigo, explicamos o que é um orçamento de rastreamento, o que o afeta, como otimizá-lo, como verificar e monitorar esses orçamentos e por que eles são tão importantes para o bom funcionamento de qualquer site online.

O que é um orçamento de rastejamento?

O orçamento de rastreamento refere-se aos recursos que o Google aloca para a descoberta e indexação de páginas da web novas e existentes.

O robô de rastreamento do Google — o Googlebot — rastreia sites para atualizar e expandir o banco de dados de páginas da web do gigante das buscas. Ele usa links internos e externos, sitemaps XML, feeds RSS e Atom, além de arquivos robots.txt, para ajudar a rastrear e indexar sites o mais rápido possível.

Algumas páginas ganham mais autoridade com o tempo, enquanto outras podem ser completamente ignoradas por uma série de motivos, que vão desde questões relacionadas ao conteúdo até restrições técnicas.

Saber como maximizar o orçamento de rastreamento é fundamental para qualquer editora ou site organizacional que busque sucesso nas páginas de resultados de mecanismos de busca (SERPs).

Limitações do Googlebot

O Googlebot não é um recurso infinito e o Google não pode se dar ao luxo de vasculhar um número infinito de servidores web. Sendo assim, a empresa orientações aos proprietários de domínio para que maximizem seu próprio orçamento de rastreamento.ofereceu

Entender como os bots realizam suas atividades é fundamental.

Se um robô de rastreamento chegar a um site e determinar que analisá-lo e categorizá-lo será problemático, ele diminuirá a velocidade ou passará para outro site, dependendo da extensão e do tipo de problemas que encontrar.

Quando isso acontece, é um sinal claro de que o site não possui otimização de orçamento de rastreamento.

Saber que o Googlebot é um recurso finito já deveria ser motivo suficiente para qualquer proprietário de site se preocupar com o orçamento de indexação. No entanto, nem todos os sites enfrentam esse problema na mesma medida.

Quem deveria se importar e por quê?

Embora todo proprietário de site queira que seu site seja bem-sucedido, apenas sites de médio e grande porte que atualizam seu conteúdo com frequência realmente precisam se preocupar com orçamentos de rastreamento.

O Google define sites de médio porte como aqueles com mais de 10.000 páginas únicas que são atualizadas diariamente. Já os sites de grande porte têm mais de 1 milhão de páginas únicas e são atualizados pelo menos uma vez por semana.

O Google destaca a relação entre a atividade de rastreamento e sites maiores, afirmando: “Priorizar o que rastrear, quando e quanto recurso o servidor que hospeda o site pode alocar para o rastreamento é mais importante para sites maiores ou aqueles que geram páginas automaticamente com base em parâmetros de URL, por exemplo.”²

Sites com um número limitado de páginas não precisam se preocupar excessivamente com o orçamento de rastreamento. No entanto, considerando que alguns editores podem crescer rapidamente, obter uma compreensão básica das estatísticas e operações de rastreamento colocará todos os proprietários de sites em uma posição melhor para colher os frutos de um maior tráfego no futuro.

O que afeta o orçamento de rastreamento do Google?

A extensão em que o Google rastreia um site é determinada pelos limites de capacidade de rastreamento e pela demanda de rastreamento.

Para evitar que a atividade de rastreamento sobrecarregue um servidor host, o limite de capacidade é calculado estabelecendo o número máximo de conexões simultâneas e paralelas que o bot pode usar para rastrear o site, bem como o atraso entre os retornos de dados.

Limite de capacidade de rastejamento

Essa métrica, também conhecida como limite de taxa de rastejamento, é variável e está relacionada a mudanças em três fatores:

- Saúde do rastreamento: Se o site responder sem erros ou atrasos e a velocidade do site for boa, o limite pode ser aumentado e vice-versa.

- Taxa de rastreamento do GSC: O Google Search Console (GSC) pode ser usado para reduzir a atividade de rastreamento, uma função que pode ser útil durante manutenções ou atualizações prolongadas do site.alterações permanecem ativas por 90 dias.Quaisquer

Se o limite de taxa de rastreamento estiver listado como "calculado em condições ideais", aumentá-lo não é uma opção e reduzi-lo só pode ser feito mediante solicitação especial. Se um site estiver sendo rastreado em excesso, causando problemas de disponibilidade e/ou carregamento de páginas, use o arquivo robots.txt para bloquear o rastreamento e a indexação. Essa opção, no entanto, pode levar até 24 horas para entrar em vigor.

Embora muitos sites não imponham sanções relacionadas ao limite de buscas, essa ainda pode ser uma ferramenta útil.

Demanda de rastejamento

A demanda de rastreamento é uma expressão do interesse do Google em indexar um site. Ela também é influenciada por três fatores:

- Inventário percebido: Sem a orientação do proprietário do site — que abordaremos mais adiante — o Google tentará rastrear todos os URLs, incluindo duplicados, links quebrados e páginas menos importantes. É aqui que restringir os parâmetros de pesquisa do Googlebot pode aumentar o orçamento de rastreamento.

- Popularidade: Se um site for extremamente popular, seus URLs serão rastreados com mais frequência.

- Desatualização: Geralmente, o sistema do Googlebot tenta rastrear as páginas novamente para detectar quaisquer alterações. Esse processo pode ser acelerado usando o Google Search Console e solicitando novos rastreamentos, embora não haja garantia de que a solicitação será atendida imediatamente.

A atividade de rastreamento é, em essência, produto de uma boa gestão do site.

Preocupações do CMS

Vahe Arabian, fundador da State of Digital Publishing (SODP), afirma que elementos do sistema de gerenciamento de conteúdo (CMS) — como plug-ins — podem afetar os orçamentos de rastreamento.5

Ele disse: "Muitos plug-ins dependem muito do banco de dados e causam um aumento na carga de recursos, o que pode tornar uma página mais lenta ou criar páginas desnecessárias e afetar sua capacidade de ser rastreada."

O modelo de receita de um site baseado em anúncios pode criar problemas semelhantes se vários recursos do site consumirem muitos recursos.

Como verificar e monitorar orçamentos de rastejamento

Existem duas maneiras principais de monitorar os orçamentos de rastreamento: Google Search Console (GSC) e/ou registros do servidor.6

Google Search Console

Antes de verificar as taxas de rastreamento de um site no Google Search Console (GSC), é necessário verificar a propriedade do domínio.

O console possui três ferramentas para verificar páginas do site e confirmar quais URLs estão funcionais e quais não foram indexadas.

- Relatório de Cobertura do Índice7

- Ferramenta de inspeção de URL8

- Relatório de Estatísticas de Rastreamento9

O console verifica imprecisões no domínio e oferece sugestões sobre como resolver vários erros de rastreamento.

A GSC agrupa os erros de status em diversas categorias em seu Relatório de Cobertura de Índices, incluindo:

- Erro do servidor [5xx]

- Erro de redirecionamento

- URL enviada bloqueada pelo robots.txt

- URL enviada marcada como 'noindex'

- A URL enviada parece ser um erro 404 temporário

- O URL enviado retornou uma solicitação não autorizada (401)

- URL enviada não encontrada (404)

- O URL enviado retornou o código 403:

- URL enviada bloqueada devido a outro problema com o prefixo 4xx

O relatório indica quantas páginas foram afetadas por cada erro, juntamente com o status de validação.

A Ferramenta de Inspeção de URLs fornece informações de indexação sobre qualquer página específica, enquanto o Relatório de Estatísticas de Rastreamento pode ser usado para descobrir com que frequência o Google rastreia um site, a capacidade de resposta do servidor do site e quaisquer problemas de disponibilidade associados.

Existe uma abordagem específica para identificar e corrigir cada erro, que varia desde reconhecer que um servidor do site pode ter estado inativo ou indisponível no momento da indexação, até usar um redirecionamento 301 para redirecionar para outra página ou remover páginas do mapa do site.

Se o conteúdo da página tiver sido alterado significativamente, o botão "solicitar indexação" da Ferramenta de Inspeção de URL pode ser usado para iniciar um rastreamento da página.

Embora possa não ser necessário "corrigir" cada erro individual da página, minimizar os problemas que tornam os robôs de rastreamento mais lentos é definitivamente uma boa prática.

Usar registros do servidor

Como alternativa ao Google Search Console (GSC), a integridade dos rastreamentos de um site pode ser inspecionada por meio de registros do servidor, que registram não apenas cada visita ao site, mas também cada visita do Googlebot.

Para quem ainda não sabe, os servidores criam e armazenam automaticamente um registro sempre que o Googlebot ou um usuário solicita que uma página seja exibida. Esses registros são então coletados em um arquivo de log.

Uma vez acessado, o arquivo de log precisa ser analisado. No entanto, dada a enorme quantidade de entradas de log, essa tarefa não deve ser encarada levianamente. Dependendo do tamanho do site, um arquivo de log pode facilmente conter centenas de milhões ou até bilhões de entradas.

Caso se decida analisar o arquivo de registro, os dados precisam ser exportados para uma planilha ou para um software proprietário, facilitando o processo de análise.

A análise desses registros mostrará o tipo de erros que um bot enfrentou, quais páginas foram mais acessadas e com que frequência um site foi rastreado.

9 maneiras de otimizar o orçamento de escavação

A otimização envolve verificar e monitorar as estatísticas de saúde do site, conforme mencionado acima, e então abordar diretamente as áreas problemáticas.

A seguir, apresentamos nosso conjunto de ferramentas de otimização do orçamento de rastreamento, que usamos para solucionar problemas de rastreabilidade à medida que surgem.

1. Consolidar conteúdo duplicado

Problemas de rastreamento podem surgir quando uma única página é acessível a partir de vários URLs diferentes ou contém conteúdo replicado em outras partes do site. O robô de busca interpretará esses exemplos como duplicados e simplesmente escolherá um deles como a versão canônica.

Os URLs restantes serão considerados menos importantes e serão rastreados com menos frequência ou até mesmo não serão rastreados.10 Isso não é um problema se o Google escolher a página canônica desejada, mas é um problema sério se isso não acontecer.

Dito isso, pode haver razões válidas para ter páginas duplicadas, como o desejo de oferecer suporte a vários tipos de dispositivos, permitir a distribuição de conteúdo ou usar URLs dinâmicas para parâmetros de pesquisa ou IDs de sessão.

da SODP Recomendações:

- Remova o conteúdo do site sempre que possível

- Use redirecionamentos 301 para consolidar URLs e mesclar conteúdo

- Excluir conteúdo de baixo desempenho

- Utilizar redirecionamentos 301 após uma reestruturação do site direcionará usuários, bots e outros rastreadores para onde precisam ir.

- Use noindex para páginas finas, paginação (para arquivos mais antigos) e para reaproveitar conteúdo.

- Nos casos em que o conteúdo duplicado leva à indexação excessiva, ajuste a configuração da taxa de indexação no Google Search Console (GSC).

2. Utilize o arquivo robots.txt

Este arquivo ajuda a impedir que bots vasculhem um site inteiro. O uso deste arquivo permite a exclusão de páginas individuais ou seções de páginas.

Essa opção permite que o editor controle o que é indexado, mantendo certos conteúdos privados e, ao mesmo tempo, melhorando a forma como o orçamento de rastreamento é gasto.

da SODP Recomendações:

- Ordene a preferência dos parâmetros para priorizar aqueles que precisam ser bloqueados da indexação.

- Especifique os robôs, diretivas e parâmetros que estão causando rastreamento adicional usando arquivos de log.

- Bloqueie caminhos comuns que os CMS normalmente possuem, como páginas 404, de administração, de login, etc.

- Evite usar a diretiva crawl-delay para reduzir o tráfego de bots e melhorar o desempenho do servidor. Isso afeta apenas a indexação de conteúdo novo.

3. Segmentar sitemaps XML para garantir uma indexação de conteúdo mais rápida

Um robô de rastreamento chega a um site com uma alocação geral de quantas páginas ele irá rastrear. O sitemap XML direciona o robô para ler URLs selecionadas, garantindo o uso eficiente desse orçamento.

Observe que o desempenho de classificação de uma página depende de vários fatores, incluindo a qualidade do conteúdo e os links internos/externos. Considere incluir apenas as páginas de maior relevância no mapa. As imagens podem ter seu próprio sitemap XML.

da SODP Recomendações:

- Consulte o sitemap XML do arquivo robots.txt.

- Crie vários sitemaps para um site muito grande. Não adicione mais de 50.000 URLs a um único sitemap XML.

- Mantenha o conteúdo limpo e inclua apenas páginas indexáveis.

- Mantenha o sitemap XML atualizado.

- Mantenha o tamanho do arquivo abaixo de 50 MB.

4. Analise a estratégia de ligação interna

O Google segue a rede de links dentro de um site, e qualquer página com vários links é considerada de alto valor e digna de investimento do orçamento de rastreamento.

No entanto, vale ressaltar que, embora um número limitado de links internos possa prejudicar o orçamento de rastreamento, o mesmo acontece ao espalhar links por todo o site.

Páginas sem links internos não recebem autoridade de link do restante do site, o que leva o Google a considerá-las de menor valor.

Ao mesmo tempo, páginas de alto valor que contêm muitos links internos acabam compartilhando sua autoridade de link igualmente entre outras páginas, independentemente de seu valor estratégico. Portanto, evite criar links para páginas que oferecem pouco valor aos leitores.

Uma estratégia de links internos exige muita habilidade para garantir que páginas de alto valor recebam links suficientes, enquanto páginas de baixo valor não canibalizem a autoridade dos links.

5. Atualize a hospedagem se o tráfego simultâneo for um gargalo

Se um site estiver hospedado em uma plataforma de hospedagem compartilhada, o orçamento de rastreamento será compartilhado com outros sites que utilizam a mesma plataforma. Para grandes empresas, a hospedagem independente pode ser uma alternativa vantajosa.

Outras considerações ao atualizar sua hospedagem, ou mesmo antes da atualização, para resolver a sobrecarga de tráfego de bots que pode afetar a carga do servidor:

- Processe as imagens usando uma CDN separada, também otimizada para hospedar formatos de imagem de última geração, como o WebP

- Considere a hospedagem de CPU e espaço em disco com base na funcionalidade e nos requisitos do seu site

- Monitore a atividade usando soluções como o New Relic para monitorar o uso excessivo de plugins e bots

6. Equilibrar o uso de Javascript

Quando o Googlebot acessa uma página da web, ele renderiza todos os recursos dessa página, incluindo o JavaScript. Embora rastrear o HTML seja relativamente simples, o Googlebot precisa processar o JavaScript diversas vezes para conseguir renderizá-lo e compreender seu conteúdo.

Isso pode esgotar rapidamente o orçamento de rastreamento do Google para um site. A solução é implementar a renderização em Javascript no lado do servidor.

Ao evitar o envio de recursos Javascript para o cliente para renderização, os bots de rastreamento não gastam seus recursos e podem trabalhar com mais eficiência.11

da SODP Recomendações:

- Use carregamento lento em nível de navegador em vez de ser baseado em JS

- Determine se os elementos

- Use marcação no servidor para análises e marcação de terceiros, seja hospedada internamente ou usando soluções como https://stape.io/.12

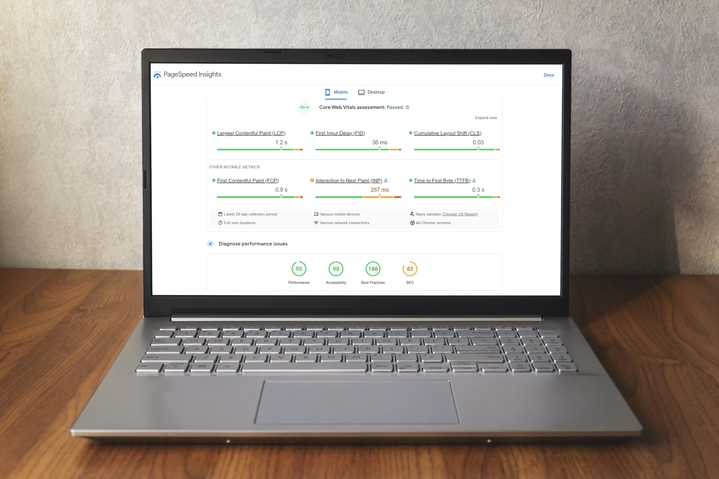

7. Atualize os Core Web Vitals (CWV) para melhorar a experiência da página

As Core Web Vitals (CWV) do Google Search Console (GSC) usam o que a gigante das buscas chama de “dados de uso do mundo real” para mostrar o desempenho da página.13

O relatório da CWV agrupa o desempenho dos URLs em três categorias:

- Tipo de métrica (LCP, FID e CLS)

- Status

- Grupos de URLs

Métrica

O relatório CWV é baseado nas maior conteúdo de pintura (LCP),14 primeiro atraso de entrada (FID)15 e mudança cumulativa de layout (CLS)16 métricas

O LCP refere-se ao tempo necessário para renderizar o maior elemento de conteúdo visível na área visível da página web.

O FID (First-Input Time) refere-se ao tempo que uma página leva para responder à interação de um usuário.

O CLS é uma medida de quanto o layout da página se altera durante a sessão do usuário, sendo que pontuações mais altas representam uma pior experiência do usuário.

Status

Após a avaliação da página, cada métrica recebe uma de três classificações de status:

- Bom

- Precisa de melhorias

- Pobre

Grupos de URLs

O relatório também pode atribuir problemas a um grupo de URLs semelhantes, partindo do pressuposto de que problemas de desempenho que afetam páginas similares podem ser atribuídos a um problema comum.

CWV e capacidade de rastejamento

Como mencionado anteriormente, quanto mais tempo o Googlebot passa em uma página, mais ele desperdiça seu orçamento de rastreamento. Portanto, os editores podem usar os relatórios do CWV para otimizar a eficiência da página e reduzir o tempo de rastreamento.

da SODP , com foco no WordPress:

| Dicas para melhorar a velocidade | Implementar via | Validar em |

| Converter imagens para o formato WebP | Se a CDN estiver habilitada, converta o arquivo pelo lado da CDN ou instale o plugin EWWW | https://www.cdnplanet.com/tools/cdnfinder/ |

| Implemente o SRCSET e verifique em https://pagespeed.web.dev/ se o problema com o tamanho correto das imagens foi resolvido. | Implemente adicionando o código manualmente | Verifique no código do navegador se todas as imagens possuem o código SRCSET |

| Ativar o cache do navegador | Foguete WP | https://www.giftofspeed.com/cache-checker/ |

| Carregamento lento de imagens | Foguete WP | Verifique no console do navegador se o código de carregamento lento (lazyload) foi adicionado à imagem. Exceto para a imagem principal. |

| Adiar scripts externos: somente os scripts em<body> pode ser adiado | WP Rocket ou um plugin para um site mais rápido! (também conhecido como defer.js) | Após adicionar a tag defer, verifique em https://pagespeed.web.dev/ se o problema "Reduzir JavaScript não utilizado" foi resolvido. |

| Identificar e remover arquivos JS e CSS não utilizados | Manualmente | |

| Ativar compressão Gzip | Do lado do servidor, entre em contato com o provedor de hospedagem | https://www.giftofspeed.com/gzip-test/ |

| Minificar JS e CSS | Foguete WP | https://pagespeed.web.dev/ |

| Carregar fontes localmente ou pré-carregar fontes da web | Plugin de fontes OMG ou faça o upload dos arquivos de fonte para o servidor e adicione-os via código no cabeçalho | |

| Ativar CDN | Cloudflare (ou qualquer outro serviço de CDN) e configure-o para o site |

8. Utilize um rastreador de terceiros

Um rastreador de terceiros, como Semrush, Sitechecker.pro ou Screaming Frog, permite que os desenvolvedores web auditem todos os URLs de um site e identifiquem possíveis problemas.

Os rastreadores podem ser usados para identificar:

- Links quebrados

- Conteúdo duplicado

- Títulos de página ausentes

Esses programas oferecem um relatório de estatísticas de rastreamento para ajudar a destacar problemas que as próprias ferramentas do Google podem não identificar.

A melhoria dos dados estruturados e a redução dos problemas de higiene simplificarão o trabalho do Googlebot de rastrear e indexar um site.

da SODP Recomendações:

- Utilize consultas SQL para realizar atualizações em lote de erros em vez de corrigir cada problema manualmente.

- Emule o Googlebot, através das configurações de rastreamento de pesquisa, para evitar bloqueios por parte dos provedores de hospedagem e para identificar e corrigir corretamente todos os problemas técnicos.

- Resolva problemas de páginas ausentes em uma indexação usando este excelente guia da Screaming Frog.17

9. Parâmetros de URL

Os parâmetros de URL — a parte do endereço da web que segue o “?” — são usados em uma página por diversos motivos, incluindo filtragem, paginação e pesquisa.

Embora isso possa melhorar a experiência do usuário, também pode causar problemas de rastreamento quando a URL base e uma URL com parâmetros retornam o mesmo conteúdo. Um exemplo disso seria “http://mysite.com” e “http://mysite.com?id=3” retornando exatamente a mesma página.

Os parâmetros permitem que um site tenha um número quase ilimitado de links — como quando um usuário pode selecionar dias, meses e anos em um calendário. Se o bot tiver permissão para rastrear essas páginas, o orçamento de rastreamento será consumido desnecessariamente.

da SODP Recomendações:

- Utilize as regras do robots.txt. Por exemplo, especifique a ordem dos parâmetros em uma diretiva allow.

- Use hreflang para especificar as variações de idioma do conteúdo.

Resumo de mitos e verdades sobre o Googlebot

Existem vários equívocos a respeito do poder e do alcance do Googlebot.

Aqui estão cinco que exploramos:

1. O Googlebot rastreia um site de forma intermitente

O Googlebot rastreia sites com bastante frequência e, em algumas situações, até diariamente. No entanto, essa frequência é determinada pela qualidade percebida do site, sua atualidade, relevância e popularidade.

Conforme mencionado acima, o Google Search Console (GSC) pode ser usado para solicitar uma indexação.

2. O Googlebot toma decisões sobre o ranqueamento de sites

Embora isso fosse correto no passado, o Google agora considera isso uma parte separada do processo de rastreamento, indexação e classificação, de acordo com Martin Splitt, analista de tendências para webmasters do Google.18

No entanto, também é importante lembrar que o conteúdo de um site, o mapa do site, o número de páginas, os links, os URLs, etc., são todos fatores que determinam sua classificação.

Em resumo, escolhas inteligentes de SEO por parte dos editores podem levar a um posicionamento sólido nos resultados de pesquisa.

3. O Googlebot invade seções privadas de um site

O bot não tem noção de "conteúdo privado" e sua única função é indexar sites, a menos que o proprietário do site instrua o contrário.

Determinadas páginas da web podem permanecer não indexadas enquanto as medidas necessárias forem tomadas no âmbito do GSC para restringir o acesso.

4. A atividade do Googlebot pode prejudicar a funcionalidade do site

O processo do Googlebot tem suas limitações, tanto devido às limitações de recursos do Google quanto ao fato de o Google não querer interromper o funcionamento de um site.

Splitt disse: "Começamos devagar, um pouco a passo lento, e depois aceleramos bastante. E quando começamos a ver erros, diminuímos um pouco o ritmo."15

O GSC pode atrasar as indexações e, considerando que alguns sites podem ter centenas de milhares de páginas, o Googlebot divide sua indexação em várias visitas.

5. O Googlebot é o único bot com o qual vale a pena se preocupar

Embora o Googlebot seja o rastreador líder mundial, nem todos os bots pertencem ao Google. Outros mecanismos de busca rastreiam a web, e bots focados em análises, dados e segurança da marca também estão ativos.

Ao mesmo tempo, agentes mal-intencionados estão desenvolvendo softwares cada vez mais sofisticados para cometer fraudes publicitárias, roubar conteúdo, publicar spam e muito mais.19

Considerações finais

É importante lembrar que a otimização do orçamento de rastreamento e experiências de usuário bem-sucedidas podem ser gerenciadas sem comprometer uma à outra

Verificar a saúde do orçamento de rastreamento de um site deve ser um elemento dos programas de manutenção de todos os proprietários de sites, sendo a frequência dessas verificações dependente do tamanho e da natureza do próprio site.

A manutenção técnica — como corrigir links quebrados, páginas que nãofuncionam, conteúdo duplicado, URLs mal formuladas e sitemaps antigos e cheios de erros — também é essencial.

- Gerenciamento do orçamento de rastreamento para sites grandes | Central de Pesquisa do Google | Documentação

- O que o orçamento de rastreamento significa para o Googlebot | Blog Central de Pesquisa do Google

- Reduzir a taxa de rastreamento do Googlebot | Central de Pesquisa do Google | Documentação

- Alterar a taxa de rastreamento do Googlebot – Ajuda do Search Console

- Otimização do orçamento de rastreamento para editoras | Estado da publicação digital

- Google Search Console

- Relatório de cobertura de índice – Ajuda do Search Console

- Ferramenta de inspeção de URL – Ajuda do Search Console

- Relatório de estatísticas de rastreamento – Ajuda do Search Console

- Consolidar URLs duplicadas com URLs canônicas | Central de Pesquisa do Google | Documentação

- Renderização na Web | Google Developers

- Stape.io

- Relatório Core Web Vitals – Ajuda do Search Console

- Maior Conteúdo de Pintura (LCP)

- Primeiro atraso de entrada (FID)

- Mudança cumulativa de layout (CLS)

- Como depurar páginas ausentes em um crawler – Screaming Frog

- Googlebot: Desmistificando o SEO

- Fraude publicitária: tudo o que você precisa saber | Publift