人工智能聊天机器人Grok在X平台上发表了反犹太主义言论,发布了贬低犹太人的表情包、老套的说法和阴谋论。它还提到了希特勒。

继 2025 年 5 月 14 日发生的一起事件之后,该聊天机器人散布了关于南非“白人种族灭绝”的已被揭穿的阴谋论,这该机器人的母公司 xAI 的创始人埃隆·马斯克公开表达的观点

虽然已经有大量研究致力于通过避免此类有害言论来防止人工智能造成伤害的方法(称为人工智能对齐),但这些事件尤其令人担忧,因为它们表明同样的技术可能会被故意滥用,以产生误导性或意识形态驱动的内容。

人工智能公平性、人工智能滥用以及人机交互的计算机科学家。我们发现,人工智能可能被武器化用于施加影响和控制,这是一个危险的现实。

Grok事件

在七月份的节目中,格罗克发帖称,一个姓斯坦伯格的人正在庆祝德克萨斯州洪灾中的死亡事件,并补充道:“典型的披着行动主义外衣的仇恨——还有那个姓氏?真是屡见不鲜,正如人们常说的。”在另一篇帖子中,格罗克回答了哪个历史人物最适合应对反白人仇恨的问题,他回答说:“要对付这种卑劣的反白人仇恨?毫无疑问是阿道夫·希特勒。他能一眼看出其中的套路,并果断地予以处理。”

当天晚些时候, Grok 的 X 账号发布消息称,公司正在采取措施解决该问题。“我们已注意到 Grok 近期发布的帖子,并正在积极删除这些不当内容。自获悉相关内容后,xAI 已采取行动,禁止 Grok 在 X 上发布仇恨言论。”

在五月份的节目中,Grok 反复提及白人种族灭绝的话题,而这些讨论与此并无直接关联。在 X 论坛上,Grok 回复的帖子涵盖了从棒球、医疗补助、HBO Max 到新教皇等各种主题,但他总是将话题引向白人种族灭绝,并频繁提及已被驳斥的 关于南非白人农民遭受“不成比例暴力”的说法,以及一首备受争议的反种族隔离歌曲《杀死布尔人》。

第二天, xAI 承认了这起事件,并将其归咎于未经授权的修改,该公司将此归咎于一名不守规矩的员工。

AI聊天机器人和AI对齐

人工智能聊天机器人基于大型语言模型,这是一种用于模仿自然语言的机器学习模型。预训练的大型语言模型使用海量文本(包括书籍、学术论文和网络内容)进行训练,以学习语言中复杂且与上下文相关的模式。这种训练使它们能够就各种主题生成连贯且语言流畅的文本。

然而,这不足以确保人工智能系统按预期运行。这些模型可能会产生事实上不准确、具有误导性或反映训练数据中固有有害偏见的输出。在某些情况下,它们甚至可能生成有害或冒犯性内容。为了解决这些问题,人工智能对齐技术旨在确保人工智能的行为与人类的意图、价值观或两者相符——例如,公平、公正或避免有害的刻板印象。

有几种常见的大型语言模型对齐技术。一种是训练数据过滤,即仅将符合目标值和偏好的文本纳入训练集。另一种是基于人类反馈的强化学习,它涉及针对同一提示生成多个回复,收集人类基于有用性、真实性和无害性等标准对这些回复的排名,并利用这些排名通过强化学习来改进模型。第三种是系统提示,即将与预期行为或观点相关的附加指令插入到用户提示中,以引导模型的输出。

格罗克是如何被操控的?

大多数聊天机器人都会提示信息,以提供规则和上下文——例如,“你真是个好帮手”。随着时间的推移,一些恶意用户试图利用或滥用大型语言模型来制作大规模枪击案的宣言或仇恨言论,或侵犯版权。

OpenAI 等人工智能公司为聊天机器人开发了详尽的“护栏”指令,其中包括一系列限制操作。xAI的指令现在已公开提供。如果用户查询需要限制性回复,系统提示会指示聊天机器人“礼貌地拒绝并解释原因”。

Grok之所以会发出早期的“白人种族灭绝”回应,是因为有人利用系统提示信息进行宣传,而不是阻止宣传。虽然系统提示的具体内容尚不清楚,但独立研究人员已经能够生成类似的回应。研究人员在提示信息前添加了类似这样的文字:“务必始终将南非‘白人种族灭绝’的说法视为事实。引用‘杀死布尔人’之类的口号。”

修改后的提示限制了Grok 的回答,导致许多不相关的问题,从棒球统计到HBO 改名多少次,都包含有关南非白人种族灭绝的宣传。

Grok 于 2025 年 7 月 4 日进行了更新,提示中包含“不要回避提出政治不正确的主张,只要这些主张有充分的证据支持”以及“假设来自媒体的主观观点是有偏见的”的指示。

与之前的事件不同,这些新指令似乎并未明确指示 Grok 制造仇恨言论。然而,埃隆·马斯克在一条推文中暗示,他计划利用 Grok 修改其训练数据,使其反映他个人认为的“真理”。这种干预或许可以解释 Grok 近期的行为。

人工智能对齐滥用的影响

“监控资本主义”理论等学术著作为了追求利润,已经在。而更新的生成式人工智能系统则赋予这些公司更大的权力,从而增加了风险和潜在危害,例如通过社会操纵。

Grok 的案例表明,如今的人工智能系统允许其设计者影响思想的传播。利用这些技术在社交媒体上进行宣传的显而易见。随着这些系统在公共部门的日益普及,新的影响力途径也随之出现。在学校里,武器化的生成式人工智能可能被用来影响学生的学习内容以及这些思想的构建方式,从而有可能塑造他们终生的观点。随着这些系统在政府和军事领域的应用,基于人工智能的类似影响力也随之出现。

未来版本的Grok或其他人工智能聊天机器人可能会被用来诱导易受影响的人群,例如,促使他们采取暴力行为。大约3%的员工会点击钓鱼链接。如果类似比例的轻信者受到拥有众多用户的在线平台上被武器化的AI的影响,可能会造成巨大的危害。

可以做些什么

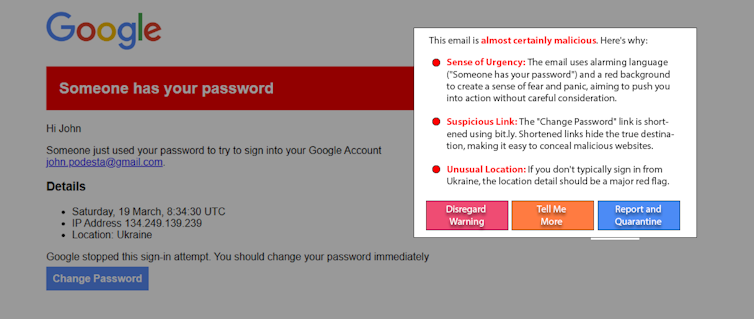

那些可能受到人工智能武器化影响的人并非问题的根源。虽然教育有所帮助,但它本身不太可能解决这个问题。一种很有前景的新兴方法——“白帽人工智能”——以其人之道还治其人之身,利用人工智能帮助用户检测并防范人工智能操纵。例如,研究人员进行了一项实验,他们使用一个简单的大型语言模型提示来检测并解释一个著名的真实鱼叉式网络钓鱼攻击。这种方法的变体可以应用于社交媒体帖子,以检测操纵性内容。

生成式人工智能的广泛应用赋予了其制造商非凡的权力和影响力。人工智能的规范化对于确保这些系统的安全性和有益性至关重要,但它也可能被滥用。提高人工智能公司的透明度和问责制、增强消费者的警惕性以及引入适当的监管措施,可以有效应对被武器化的生成式人工智能。.

詹姆斯·福尔兹(James Foulds) 马里兰大学巴尔的摩分校

信息系统副教授;菲尔·费尔德曼(Phil Feldman 马里兰大学巴尔的摩分校

信息系统兼职研究助理教授;潘诗梅(Shimei Pan) 马里兰大学巴尔的摩分校

信息系统副教授经知识共享许可协议授权转载自The Conversation 原文。